在撰寫本文時,OpenAI 正處於一個相當大的法律戰。加利福尼亞州的一家公司聲稱 OpenAI 在訓練其聊天機器人 ChatGPT 時侵犯了其用戶的隱私。由於這一說法,以及該公司為其聊天機器人收集的數據量,這可能會對 OpenAI 和其他人工智能公司產生一些重大影響。問題是:在這種情況下,OpenAI 是否錯了?

這個案例是關於什麼的?

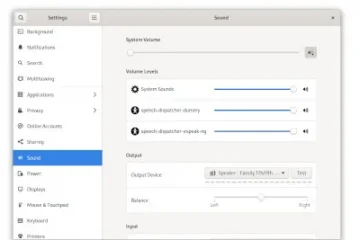

一旦你了解了這個案例的內容,就很容易掌握這個案例的內容了。情況的嚴重性。現在,人工智能就像人腦一樣;它需要接受培訓。它需要被教導。公司將大量數據輸入到他們的法學碩士(大型語言模型)中,以便他們可以學習。法學碩士知道的越多,他們的幫助就越大。谷歌是領先的人工智能公司之一,因為它可以通過谷歌搜索、Android等訪問價值10億噸的數據。

就ChatGPT而言,它還使用了需要接受培訓的LLM ;該公司使用大量數據對其進行訓練。問題出在它獲取此信息的某些地方。該公司使用了大量來自互聯網的數據。這包括人們未經同意 AI 聊天機器人使用而上傳的大量數據。

我們談論的是文章、博客文章、短篇故事、劇本、詩歌、社交媒體帖子等。這樣的例子不勝枚舉。由於 ChatGPT 的知識可以追溯到很久以前,因此無法得知有多少人的數據被用來訓練 ChatGPT。訴訟稱這些信息是在未經原發布者同意的情況下獲得的。

這就是 OpenAI 陷入困境的原因。 OpenAI 向 ChatGPT 提供的信息規模非常巨大。如果法院認定該公司有過錯,那麼這對整個人工智能來說可能意味著壞消息。

那麼,OpenAI 錯了嗎?

這就是狂野的西部。對於人工智能,立法者仍在研究如何對其進行監管。當他們與人工智能的合法性作鬥爭時,普通人正在處理人工智能的道德問題。 OpenAI 使用如此多的數據來訓練 ChatGPT 是否有錯?

有人可能會說是的。

這一論點的很大一部分來自於人工智能生成藝術的爭議。人們對這項技術的抗議持續不斷,因為它讓人們能夠只用文字立即創建圖像。就像 ChatGPT 一樣,人工智能圖像生成器需要輸入人類藝術家的藝術圖像。許多人類藝術家不希望他們的藝術被用來訓練這些圖像機器人。

好吧,想想人們用他們的書面內容來訓練 ChatGPT。就像圖像生成器可以讓藝術家破產一樣,聊天機器人也可以讓作家破產。聊天機器人可以在幾秒鐘內生成文章、短篇故事、腳本、博客文章等。當您可以生成自己的內容時,為什麼要雇用並支付一位人類作家的費用呢?可以理解的是,花費數年時間開發自己的手藝的人類作家不希望他們的內容被用來訓練可能讓他們失業的機器。

這些人需要把他們的工作放在那裡謀生。記者在公共網站上發布文章,作家在公司的公共網站上發表博客文章等。他們這樣做是為了與讀者分享他們的手藝,並希望激勵其他作家。他們沒有同意讓他們的工作被抓取並用於訓練人工智能聊天機器人。

其他人可以反駁

這個論點有兩個方面。當藝術家、作家和音樂家在網上發布他們的作品時,他們面臨著作品被用於其他目的的風險。這與你的內容被盜和剽竊沒有太大區別。創作者發布他們的內容時,都知道這些內容可能會被盜取並用於其他目的。

如果內容不受版權保護,對話就會變得更加棘手。如果您的內容可以在互聯網上免費提供給任何人獲取,那麼 OpenAI 就有權使用它來訓練 ChatGPT。

如果 OpenAI 敗訴,這可能是一件好事

那些使用 ChatGPT 來撰寫論文的人很可能會支持 OpenAI 贏得這場官司。然而,如果公司敗訴,那可能還不是最糟糕的事情。當然,OpenAI 將面臨財務損失,這對公司來說並不是一件好事。然而,如果法院勝訴,可能有助於推動人工智能監管的發展。

如前所述,人工智能監管就像狂野的西部。立法者正在努力控制人工智能的發展,並確保它不會產生任何負面影響。隨著人工智能圖像生成器和人工智能聊天機器人的出現,人們對其內容的權利從未像現在這樣受到威脅。來自互聯網各地的內容正在被大量湧入這些 LLM,而且沒有辦法阻止它。

如果 OpenAI 輸掉了這個官司,那麼它將把這個問題帶到最前沿。這會讓人們談論這些法學碩士如何獲取他們的信息。此時此刻,人們迫切希望對人工智能進行監管。它導致人們失業。獨立創作者正在被那些生成內容並營銷內容的無能人士所超越。有人可以輕鬆創作一首人工智能生成的“歌曲”並在 Spotify 上進行營銷。想像一下在一天或一周內推出整張專輯並從中獲得收入。

人工智能“藝術家”和人工智能“作者”也是如此。對於大多數人來說可能已經太晚了。我們才剛剛了解生成式人工智能技術的潛力;這包括潛在的不良後果。

只有時間才能證明一切

目前,我們仍在等待案件的結果,因此很難判斷會發生什麼。我們需要等待,看看這個案例如何發展才能了解該技術的未來。像這樣的案例肯定會對人工智能產生一些重大影響。