Mientras que Apple introdujo nuevas funciones de RA para iOS 15 y Object Capture para Reality Kit 2 durante el Nota clave de la WWDC 2021, las actualizaciones de ARKit curiosamente estuvieron ausentes en la presentación oficial.

Eso no significa que no haya nada nuevo en el kit de herramientas de Apple para aplicaciones móviles de RA, y la próxima actualización ayuda a evolucionar las experiencias de RA a través de ARKit hacia el sueño de ciencia ficción del Metaverso, también conocido como AR cloud .

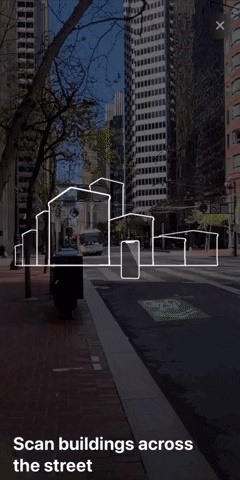

La característica principal de ARKit 5 es Location Anchors, una expansión de f la funcionalidad de contenido persistente introducida en ARKit 2 , que permite que las aplicaciones ejecuten experiencias de realidad aumentada en ubicaciones precisas en ubicaciones del mundo real, desde lugares famosos hasta vecindarios amigables, según las coordenadas de latitud, longitud y altitud.

Sin embargo, Location Anchors se limitará a Londres, Nueva York y otras ciudades selectas de EE. UU. En el momento del lanzamiento. También necesitará un iPhone X S , iPhone X S Max, iPhone X R o dispositivos más nuevos para experimentar los anclajes de ubicación.

Actualización: una sesión bajo demanda que explora ARKit 5 publicado el jueves revela que el modo de navegación AR que viene a Apple Maps usa Location Anchors. El modo AR se lanzará en Londres, Los Ángeles, Nueva York, Filadelfia, San Diego, el área de la Bahía de San Francisco y Washington, DC

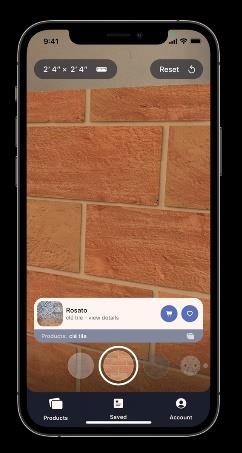

Otra nueva característica que llega a ARKit 5 es App Clip Code, que permite a los desarrolladores anclar contenido de aplicaciones ARKit o App Clips en un marcador impreso o digital

Además, ARKit 5 incluirá mejoras para Motion Tracking y agregará soporte para Face Tracking a la cámara ultra gran angular del iPad Pro de quinta generación y las cámaras frontales para dispositivos con al menos el A12 Bionic chip (iPhone SE y posterior). Los dispositivos con la cámara frontal TrueDepth también podrán rastrear hasta tres caras a la vez.

Pero los anclajes de ubicación son el gran problema aquí, ya que representa Apple avanza en la dirección de experiencias de AR compartidas y persistentes que son el sello distintivo de la nube de AR.

Google ha comenzado a abordar el concepto a través de Cloud Anchors para ARCore , pero actúa más como un estado de guardado del mundo real para el contenido generado por el usuario. Microsoft ofrece una solución similar en Azure Spatial Anchors para iOS, Android y HoloLens .

Una aproximación más cercana a los anclajes de ubicación de Apple es el Landmark AR tecnología para Snapchat , disponible para los creadores a través de plantillas en Lens Studio . Landmark AR utiliza la ubicación y el posicionamiento visual para anclar el contenido de AR a edificios y monumentos.

Más recientemente, Niantic comenzó a aceptar solicitudes para la beta privada de su plataforma Lightship , que eventualmente utilizará un sistema de posicionamiento visual para permitir a los desarrolladores anclar contenido a puntos de referencia del mundo real. Parte de este esfuerzo implica mapeo 3D de colaboración colectiva, que se logra a través de tareas dentro del juego en aplicaciones como Pokémon GO .

Facebook y Epic Games también están desarrollando sus propios sabores del Metaverso, junto con nuevas empresas como Ubiquity6 .

Todo esto para decir que Apple no necesariamente llega tarde a la nube AR, sino más bien a la moda. El segmento es en gran medida una búsqueda orientada al futuro, y las empresas que ya están en la fiesta realmente recién están comenzando. Pero, ahora que Apple está aquí, la diversión realmente puede comenzar.