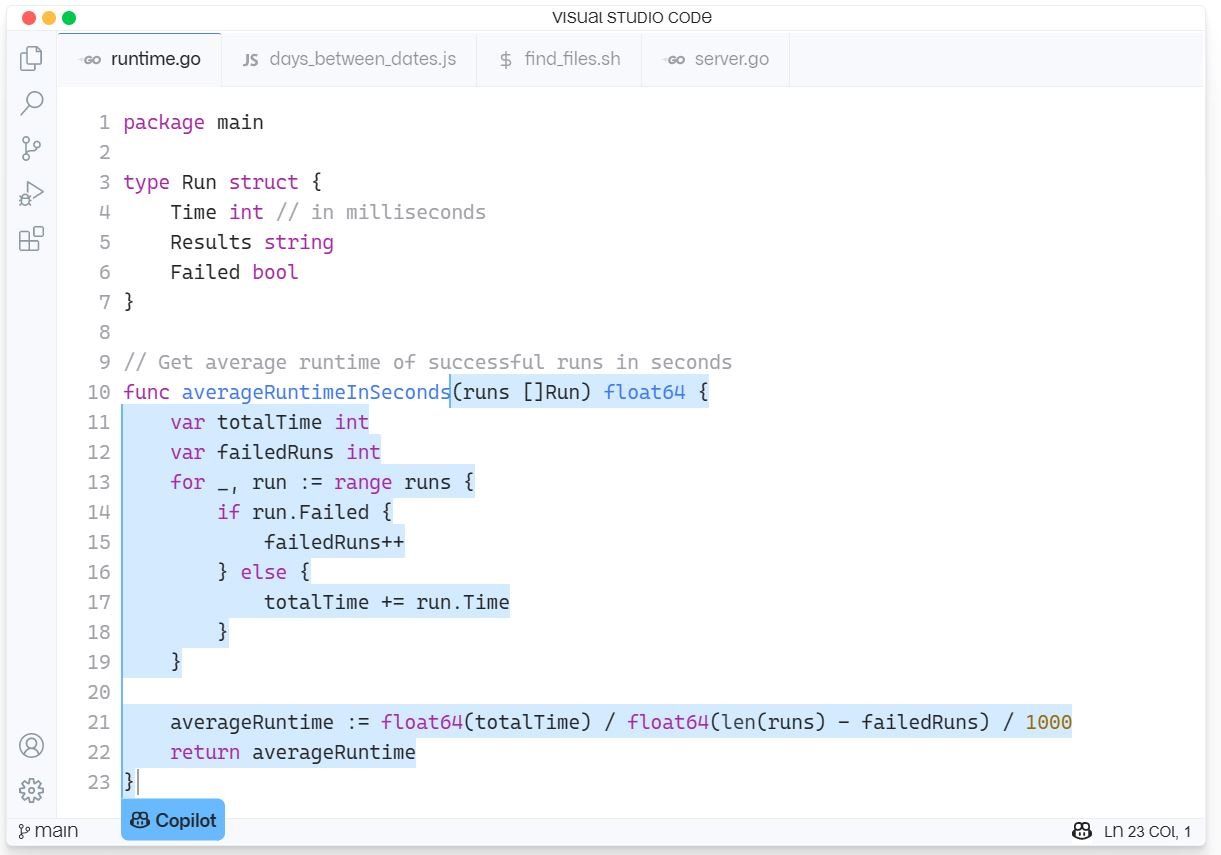

GitHub Copilot es un nuevo servicio de asistencia de IA para el desarrollo de software integrado en Visual Studio Code de Microsoft. GitHub Copilot admite una variedad de lenguajes y marcos y facilita la vida de los desarrolladores al ofrecer sugerencias para líneas completas o funciones completas dentro del IDE. GitHub Copilot funciona con OpenAI Codex y se entrenó en miles de millones de líneas de código de fuente abierta.

El último problema ha provocado que la Free Software Foundation (FSF) tenga una enorme abeja en su capó, llamando la herramienta”inaceptable e injusta, desde nuestra perspectiva”.

El defensor del software de código abierto se queja de que Copilot requiere software de código cerrado como Visual Studio IDE de Microsoft o el editor de código de Visual Studio para ejecutarse y que constituye un”Servicio como sustituto del software”, lo que significa que es una forma de ganar poder sobre la informática de otras personas.

La FSF consideró que había numerosos problemas con Copilot que aún debían probarse en los tribunales.

“Los desarrolladores quieren saber si entrenar una red neuronal en su software puede considerarse uso justo. Otros que quieran usar Copilot se preguntan si los fragmentos de código y otros elementos copiados de los repositorios alojados en GitHub podrían resultar en una infracción de derechos de autor. E incluso si todo pudiera ser legalmente copacetico, los activistas se preguntan si no hay algo fundamentalmente injusto en que una empresa de software propietario construya un servicio a partir de su trabajo ”, escribió la FSF.

La ayuda responde a estas preguntas la FSF ha pedido libros blancos que examinen los siguientes temas:

¿La capacitación de Copilot sobre repositorios públicos infringe los derechos de autor? ¿Uso legítimo? ¿Qué posibilidades hay de que la salida de Copilot genere reclamaciones procesables por violaciones de obras con licencia GPL? ¿Pueden los desarrolladores que utilizan Copilot cumplir con licencias de software libre como la GPL? ¿Cómo pueden los desarrolladores garantizar que el código del que poseen los derechos de autor esté protegido? violaciones generadas por Copilot? Si Copilot genera código que da lugar a una violación de un trabajo con licencia de software libre, ¿cómo puede descubrir esta violación el titular de los derechos de autor? ¿Tiene derechos de autor un modelo de AI/ML capacitado? ¿Quién posee los derechos de autor? ¿Deben las organizaciones como la FSF abogar por un cambio en la ley de derechos de autor relevante a estas preguntas?

La FSF pagará $ 500 por los libros blancos publicados y puede liberar más fondos si se justifica más investigación.

Aquellos que quieran hacer un envío pueden enviarlo a [email protected] antes del 21 de agosto. Leer más sobre el proceso en FSF.org aquí.

Microsoft ha respondido al próximo desafío diciendo:”Este es un nuevo espacio, y estamos ansiosos por participar en una discusión con desarrolladores en estos temas y liderar la industria en el establecimiento de estándares apropiados para entrenar modelos de IA ”.

Dado que Copilot a veces roba funciones completas de otras aplicaciones de código abierto, ¿nuestros lectores están de acuerdo con la FSF, o la FSF está siendo hipócrita simplemente porque es una IA en lugar de un código de reutilización humana? Háganos saber su opinión en los comentarios a continuación.

a través de infoworld