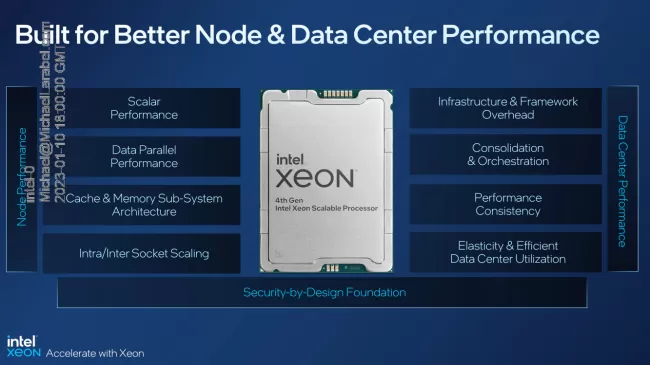

Con los procesadores escalables Xeon de 4.ª generación, Intel promueve una mejora informática de uso general del 53 % con respecto a los procesadores”Ice Lake”escalables Xeon anteriores, hasta 10 veces mejor rendimiento de inferencia de IA, hasta 3 veces más rendimiento para análisis de datos y hasta 2 veces más rendimiento de compresión de datos para redes y almacenamiento. Gran parte de estas ganancias con Sapphire Rapids provienen de los nuevos aceleradores integrados que se encuentran con estos procesadores. Mientras tanto, en el lado de la serie Xeon CPU Max para los SKU Sapphire Rapids con memoria HBM2e, hay una mejora de hasta 3.7x para las cargas de trabajo vinculadas a la memoria.

Sapphire Rapids presenta Intel Data Streaming Accelerator (DSA) que he estado cubriendo desde el punto de vista de Linux desde 2019. Hacer uso de Data Streaming Accelerator puede descargar algunas tareas de movimiento de datos a través de la CPU, la memoria y las cachés junto con los dispositivos de memoria/almacenamiento/red conectados.

Sapphire Rapids también tiene In-Memory Analytics Accelerator (IAA) para ayudar a acelerar las cargas de trabajo de análisis y bases de datos al tiempo que proporciona una mayor eficiencia energética. Los nuevos procesadores también cuentan con tecnología QuickAssist (QAT), que ha estado disponible en conjuntos de chips anteriores seleccionados para ayudar con las tareas de cifrado/descifrado/compresión.

Zafiro Las CPU de Rapids tienen soporte para Trust Domain Extension (TDX) como una característica que he cubierto desde el lado del soporte de Linux por un tiempo. Curiosamente, con Sapphire Rapids, este soporte TDX solo está disponible para proveedores de nube seleccionados para ayudar a mejorar la seguridad/confidencialidad de la máquina virtual. Para las CPU escalables Xeon de próxima generación es cuando parece que Intel hará que TDX esté más ampliamente disponible.

Pero antes de profundizar demasiado en las funciones de Sapphire Rapids, lo que probablemente más le interese a la mayoría de ustedes es en última instancia, la tabla de SKU.

El procesador insignia escalable Intel Xeon de 4.ª generación es el Xeon Platinum 8490H, que tiene 60 núcleos/120 subprocesos con un reloj base de 1,9 GHz, 2,9 GHz en total. reloj turbo de núcleo y reloj turbo máximo de 3,5 GHz. El Xeon Platinum 8490H tiene un TDP de 350 vatios, 112,5 MB de caché y tiene un precio recomendado para el cliente de $17 000 USD.

El Xeon Platinum 8490H competirá contra el procesador EPYC 9654 de AMD, que como recordatorio tiene 96 núcleos/192 subprocesos, reloj base de 2,4 GHz, refuerzo de todos los núcleos hasta 3,55 GHz y un reloj de impulso máximo de 3,7 GHz. El EPYC 9654 tiene un TDP predeterminado de 360 vatios. Cuando se trata de la cantidad de núcleos/hilos y las velocidades de reloj nominales, el procesador insignia AMD EPYC 9654 supera fácilmente al Xeon Platinum 8490H… AMD EPYC Genoa también es compatible con DDR5-4800 de 12 canales en comparación con DDR5-4800 de 8 canales. con Sapphire Rapids. Pero con el Xeon Scalable”Sapphire Rapids”, donde Intel pretende competir es en cargas de trabajo que pueden ser explotadas por sus diversos aceleradores integrados. Intel se está centrando mucho en la historia del acelerador para Sapphire Rapids.

Generacionalmente, el buque insignia Xeon Platinum 8490H es un gran impulso con respecto al buque insignia de Ice Lake de la generación anterior con el Xeon Platinum 8380. Del 8380 al 8490H es 40 núcleos/80 subprocesos a 60 núcleos/1280 subprocesos, de 60 MB a 112,5 MB de tamaño de caché, DDR4-3200 de 8 canales se reemplaza por DDR5-4800 de 8 canales, y la frecuencia turbo máxima aumentó de 3,4 GHz a 3,5 GHz. Además, Sapphire Rapids tiene los nuevos aceleradores, AMX y otras ventajas, como se indicó. Pero pasar del Xeon Platinum 8380 al 8490H es en realidad una frecuencia base más baja ahora a 1,9 GHz en comparación con los 2,3 GHz con Ice Lake y el TDP aumentó de 270 vatios a 350 vatios, pero al menos hay un 50 % más de núcleos y otros adiciones O como otro punto de comparación, está el Xeon Platinum 8380H existente como 28 núcleos/56 subprocesos con una frecuencia base de 2,9 GHz y una frecuencia turbo máxima de 4,3 GHz con un caché de 38,5 MB y un TDP de 250 vatios.

Sobre el tema de aceleradores, mirando la tabla SKU, también notará que alrededor de los aceleradores hay una mención”Predeterminada”para la cantidad de dispositivos DSA/QAT/DLB/IAA… Esa mención predeterminada y las columnas”Intel On Demand Capable”finalmente van juntas. Como se informó anteriormente, Intel On Demand (también conocido anteriormente como Software Defined Silicon) se vinculará con la disponibilidad del acelerador/número de dispositivos aceleradores en SKU seleccionados. En el caso de los modelos Xeon Platinum 8490H/8480H, todos los dispositivos están habilitados, pero a medida que avanza en la pila, hay menos dispositivos aceleradores disponibles hasta que finalmente no hay aceleradores, a menos que use Intel On Demand para comprar una actualización:-más allá de los precios recomendados para el cliente.

Será interesante ver cómo se desarrolla el modelo On Demand de Intel, especialmente cuando estos aceleradores son aún más importantes para poder competir de manera efectiva con AMD EPYC Genoa. y Ampere Altra. Intel dice que buscaron On Demand de clientes que querían cambiar algunos gastos de capex a gastos opex y permitirles a los clientes la capacidad de actualizarse con el tiempo.

En la tabla de SKU también está el Xeon CPU Max Series con el modelo insignia Xeon Platinum 9480 con 56 núcleos pero con la memoria HBM2e en el paquete. Desafortunadamente, no tengo en mis manos ninguna serie Xeon CPU Max en este momento para lo que sería una evaluación comparativa muy interesante con esa memoria HBM2e integrada.

De todos modos, esa es una descripción general rápida de la tabla de SKU bastante compleja que representa procesadores Xeon Scalable Sapphire Rapids actuales.

El gráfico anterior de Intel desglosa aún más algunas de las diferencias entre las series Sapphire Rapids Xeon Platinum, Xeon Gold y Xeon Silver.

Similar a los procesadores EPYC de 4.ª generación de AMD, Sapphire Rapids admite memoria de sistema DDR5, conectividad PCIe 5.0 y CXL 1.1. Aunque para el beneficio de Genoa, hay soporte DDR5-4800 de 12 canales en comparación con Sapphire Rapids que maneja 8 canales de memoria en DDR5-4800 o velocidades de memoria más bajas con los SKU más bajos y Genoa presenta 128 carriles de PCIe 5.0 en comparación con 80 carriles con Sapphire Rapids.

Los nuevos motores aceleradores con DSA, IAA, DLB y QAT en el chip es la forma en que pretenden competir mejor/superar a la competencia AMD EPYC. Aunque los motores aceleradores dependen del soporte de software adecuado y, como se mencionó, los motores aceleradores no están disponibles universalmente para 4th Gen Xeon Scalable, pero dependen del SKU y, además, del modelo de actualización Intel On Demand. Más detalles sobre el soporte de software más adelante en el artículo.

El soporte AMX es muy emocionante como parte de las nuevas ofertas de aceleración con Sapphire Rapids. Afortunadamente, Intel ha estado trabajando en el kernel de Linux y la compatibilidad con la cadena de herramientas del compilador en AMX ISA durante un tiempo. Con los entornos Linux modernos, el soporte de AMX debería estar en buena forma para ayudar a acelerar la inferencia/capacitación de IA.

Fue bastante interesante durante la rueda de prensa/analista de Intel que estaban tomando tiros en los puntos de referencia SPEC con Sapphire Rapids. Argumentan que las cargas de trabajo de los clientes han variado mucho de lo que los puntos de referencia de CPU SPEC tienden a representar. Oye, estoy de acuerdo con ellos… Es por eso que durante más de una década he estado impulsando el enfoque de la carga de trabajo del mundo real para la evaluación comparativa y también la prueba en docenas o, en algunos casos, cientos de cargas de trabajo diferentes. Las necesidades de los clientes continúan siendo más diversas y no están bien representadas por solo uno, dos o incluso un puñado de puntos de referencia. (Por supuesto, los puntos de referencia de SPEC no se benefician de la nueva IP del acelerador con SPR…)

Para cargas de trabajo y software capaces de aprovechar la IP de Sapphire Rapids, Intel está promoviendo grandes ganancias con 4th Gen Xeon Scalable. Intel ha estado poniendo en forma todos los bits necesarios del kernel de Linux (como el controlador del kernel IDXD para los Aceleradores de transmisión de datos), la nueva cobertura ISA en los compiladores y más. Esa base se ha establecido para el lanzamiento de Sapphire Rapids con pilas modernas de Linux. Pero también se necesitan componentes de software de Intel en el espacio del usuario y luego también las diversas aplicaciones/software relevantes en sentido ascendente para hacer uso de estas nuevas características. Ahí es donde, en muchos casos, pasará más tiempo antes de que la estrategia de aceleración de Intel realmente pueda dar sus frutos y sea sólida.

El comentario no oficial de varios ingenieros de Intel ha sido que probablemente será al menos un cuarto o dos antes de ver más versiones anteriores de software de código abierto que comiencen a ver la integración del código para soportar los nuevos aceleradores. Por supuesto, para un soporte más generalizado en más proyectos de nicho depende de que más desarrolladores tengan en sus manos Sapphire Rapids, ya sea físicamente o disponible a través de nubes públicas.

Intel también proporcionó una diapositiva con su análisis de Sapphire Rapids frente a las CPU Genoa de AMD. Está muy centrado en el acelerador y muestra las áreas en las que las CPU Intel Xeon han proporcionado funciones mucho antes que AMD, como con la ventaja inicial de siete años en AVX-512.

Debido a la necesidad más tiempo para que el ecosistema de software aproveche los aceleradores, las ventajas completas de Sapphire Rapids no se realizarán en el lanzamiento. Sin embargo, será muy interesante a medida que más software de código abierto ascendente comience a utilizar la nueva IP y a evaluar comparativamente los beneficios de rendimiento.

Intel también ha ha contribuido mucho al kernel de Linux en torno a la compatibilidad con TDX, por lo que fue una sorpresa que sea”limitada”en esta generación, pero al menos la compatibilidad con el kernel en sentido ascendente está ahí para cuando haya una disponibilidad más amplia de TDX y pueda ser utilizada hoy por la nube se asocia con el acceso TDX.

Además de las perspectivas de aceleración con Sapphire Rapids, la serie Intel Xeon CPU Max para Sapphire Rapids es igualmente emocionante. con 64 GB de memoria HBM2e integrada. Estos SKU de HBM de Sapphire Rapids pueden funcionar únicamente con la memoria de alto ancho de banda, en un modo plano junto con la memoria del sistema DDR5 convencional, o como un modo de almacenamiento en caché de HBM que combina los modos de operación solo HBM y plano.

Desafortunadamente, actualmente no tengo en mis manos ninguna CPU de la serie Xeon CPU Max para probar el rendimiento, pero debería ser interesante especialmente para la amplia gama de cargas de trabajo que analizo, así como del Milan-X anterior. las pruebas con la gran cantidad de beneficios observados en esos puntos de referencia, con 64 GB de memoria HBM2e deberían ser ganancias aún más dramáticas.

A diferencia de la necesidad de realizar cambios de software para aprovechar los aceleradores, con la serie Xeon CPU Max allí ¿No es ese requisito y, por lo tanto, mucho rendimiento inmediato para cargas de trabajo optimizadas de ancho de banda de memoria?

Desde el comienzo, es probable que haya una mejor disponibilidad de procesadores y servidores/plataformas escalables Xeon de 4.ª generación que lo que hemos visto en EPYC de 4.ª generación. Dos meses después de que se introdujera el EPYC”Genoa”de cuarta generación, todavía es difícil encontrar los nuevos procesadores EPYC 9004 disponibles en los principales minoristas de Internet; es probable que sea una mejor historia dentro de las grandes organizaciones, pero para las personas y las pequeñas organizaciones puede ser difícil. poner tus manos en Génova ahora mismo. Ha habido algunas listas más de CPU de Génova en las últimas semanas, pero aún parece ser limitada. Además, las placas base de la serie EPYC 9004 y las plataformas de servidor todavía son raras de ver en la lista para comprarlas fácilmente en línea en cantidades individuales.

Los socios de placas base de servidor de Intel han estado listos durante algún tiempo con su Sapphire Las ofertas de Rapids, pero el revés por los retrasos en el lanzamiento de la CPU, por lo que parece que Intel puede tener la ventaja de una disponibilidad más sólida, mientras que veremos cómo se desarrolla eso en las próximas semanas y los próximos meses. También será interesante ver cómo se comparan los precios de la placa base y el servidor entre Génova y Sapphire Rapids, así como qué tan cerca se encuentra el precio de la CPU de los precios sugeridos para el cliente.

Ese es el resumen de los anuncios de hoy sobre Intel 4th Gen Xeon Scalable”Sapphire Rapids”y la serie Xeon CPU Max. Sapphire Rapids es muy interesante desde la perspectiva del hardware, pero lo bien que puede competir a corto plazo puede ser más desafiante, ya que con Sapphire Rapids se trata de aceleradores, aceleradores y aceleradores. Si bien el soporte de Linux ascendente para estos nuevos bloques aceleradores está en su lugar, tomará tiempo para que más software ascendente comience a hacer uso del nuevo potencial del acelerador, los dolores de cabeza iniciales de implementación/configuración, etc., por lo que es posible que no se alcance todo el potencial para algunos. tiempo, al igual que llevó un tiempo la adopción inicial de AVX-512 y la superación de esos obstáculos iniciales. También será interesante ver cómo se desarrolla la estrategia On Demand de Intel, nuevamente, debido a que el uso del acelerador es tan importante para que Sapphire Rapids compita y realmente esté a la altura de las afirmaciones de rendimiento en las que se enfoca Intel, mientras que muchos de los SKU de nivel inferior son funcionando con un número reducido de motores de aceleradores o incluso ninguno de forma predeterminada.

Debido a los problemas de adopción temprana en torno al software que utiliza los aceleradores, la serie Intel Xeon CPU Max se encuentra en una situación muy posición interesante. Con los 64 GB de memoria HBM2e y la capacidad de incluso ejecutar servidores solo con esa memoria HBM2e, existen perspectivas muy interesantes para un rendimiento excepcional en aplicaciones vinculadas con uso intensivo de memoria sin tener que preocuparse por los requisitos de software u otros cambios de código. Los únicos aceleradores con la serie Xeon CPU Max son el Acelerador de transmisión de datos. El modelo Xeon CPU Max Series 9480 también se vende al por menor por $ 12,890 en comparación con el buque insignia Xeon Platinum 8490H a $ 17,000. Dada la gran mejora que he informado de AMD Milan-X de una amplia variedad de software del mundo real, la serie Xeon CPU Max debería ser un verdadero placer para el espacio HPC y otras cargas de trabajo intensivas de ancho de banda de memoria, especialmente si sus requisitos de RAM lo permiten. le permite ejecutar todo el servidor en modo de memoria solo HBM2e.

Continúe leyendo con el próximo artículo que analiza la revisión y los puntos de referencia de Intel Xeon Platinum 8490H.