In occasione dell’evento WWDC trasmesso in streaming il 7 giugno, Apple ha parlato di una nuova funzionalità in arrivo quest’anno su iPhone, iPad e Mac.

La funzione in questione è

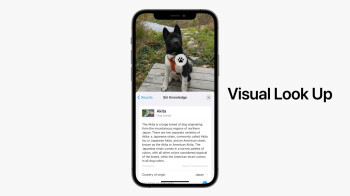

Visual Look Up, che Apple ha annunciato utilizzerà il software di intelligenza artificiale per riconoscere e classificare gli oggetti trovati nelle foto. Non ha ricevuto molta attenzione durante il livestream ed è apparso quasi come un ripensamento, dopo l’introduzione dettagliata di Apple di

Testo live (che è un’altra caratteristica interessante, tra l’altro).

Tuttavia, ha sicuramente attirato la nostra attenzione, e probabilmente l’attenzione di chiunque abbia familiarità con

Google Lens. In effetti, sembra che stia copiando esattamente ciò che fa Lens, anche se sta arrivando un po’tardi nel gioco.

Ciò che Visual Look Up farà presto è riconoscere un varietà di elementi tridimensionali catturati nelle tue foto, e ti permettono di cercare informazioni su di essi premendo il piccolo pop-up interattivo che apparirà in alto. Secondo Apple, ti aiuterà facilmente a classificare cose come la razza di un cane, il genere del fiore, il nome e la posizione geografica di un particolare punto di riferimento e così via.

La copertura di Visual Look Up sul comunicato stampa di Apple, dopo il WWDC, è un breve riassunto come segue:

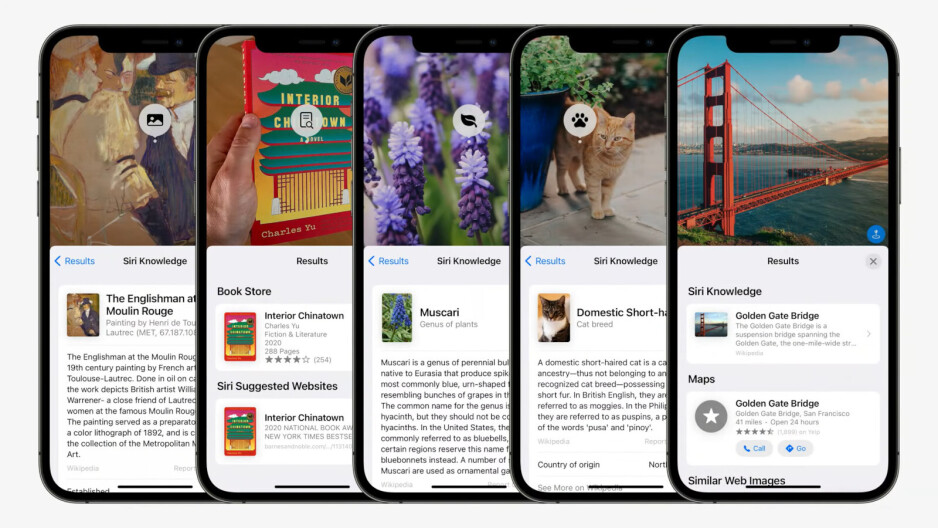

Con Visual Look Up, gli utenti possono saperne di più sull’arte popolare e sui monumenti di tutto il mondo, sulle piante e sui fiori presenti in natura, sulle razze di animali domestici e persino sui libri.

Il livestream ha mostrato più o meno la stessa cosa, con una singola riga di screenshot che mostra esattamente ciò che è elencato.

Come sarà il confronto con Google Lens?

Con tutto ciò preso in considerazione, Apple’s Visual Look Up non è in una fase di sviluppo così impressionante o versatile come Google Lens, uscito nel 2017 e da allora notevolmente migliorato.

Google Lens identifica anche le razze canine, le piante e i punti di riferimento, ma questo è solo l’inizio delle sue capacità. Google ha sviluppato Lens in modo che possa scansionare e riconoscere forme tridimensionali attraverso l’obiettivo della fotocamera e cercare quasi tutti i prodotti o oggetti cercando foto simili sul web, dicendoti dove puoi acquistarlo e per quanto.

Oltre a ciò, Google Lens può estrarre parole dalle foto e convertirle in formato testo, copiandole direttamente per incollarle dove vuoi. Mentre tutte queste funzioni si trovano sotto l’ampio ombrello di Google Lens, anche Apple ha appena adottato questa funzione di testo fotografico e la sta lanciando separatamente con iOS 15, chiamandola

Live Text.

Google Lens e Live Text ti consentono entrambi di focalizzare la fotocamera del tuo telefono sul testo contenente le informazioni di contatto, come un biglietto da visita, e sarà immediatamente analizzarlo e sollecitare azioni pertinenti. Ad esempio, puoi chiamare o inviare istantaneamente un messaggio a un numero di telefono visibile nel riquadro o inviare un’e-mail all’indirizzo di posta elettronica.

Con Google Lens puoi anche tradurre il testo in tempo reale, sovrapposto allo schermo in realtà aumentata mentre esegui la scansione dell’ambiente circostante. Anche il Live Text di Apple supporterà la traduzione, ma congela l’immagine e la sovrappone lì, piuttosto che lo stile AR di Lens.

Apple è stata, ovviamente, accusata di copiare

Google nell’area dell’IA-powered

Visual Look Up, ma la tecnologia di analisi fotografica intelligente era destinata a raggiungere i suoi dispositivi prima o poi. Questo non può essere giustamente chiamato plagio, ma più come seguire le orme di un inevitabile progresso.

Google Lens era una funzione originariamente pianificata solo per

Pixel line, ma è rapidamente cresciuto e si è diffuso oltre. D’altra parte, dubitiamo fortemente che

Visual Look Up sarà mai disponibile per Android. Ma c’è da aspettarselo, poiché Apple ha sempre puntato alla creazione di un ecosistema chiuso i cui componenti funzionano meglio solo tra loro.

Prevediamo che Apple farà qualcosa di speciale con Visual Look Up in futuro, anche se ha ancora solo un set limitato di funzioni.