วันนี้เราจะเข้าร่วมโดยวิศวกรหลักของ Intel Karthik Vaidyanathan และพูดคุยเกี่ยวกับเทคโนโลยี Supersampling ระบบประสาทของ Intel ที่กำลังจะมีขึ้นอย่าง XeSS และการสาธิตที่น่าประทับใจมาก Karthik เป็นเครื่องมือสำคัญในการพัฒนา XeSS และจะตอบคำถามของชุมชนเกี่ยวกับเทคโนโลยีการอัปสเกล กำหนดการของการสัมภาษณ์จะเริ่มต้นด้วยพื้นฐานพื้นฐานบางประการเกี่ยวกับการจำแนกเทคโนโลยีการอัปสเกลแล้วไปยังคำถามที่ตรงประเด็นมากขึ้น

ในขณะที่คุณอาจถูกล่อลวงให้ข้ามไปยังส่วนที่สนุกกว่าของการสัมภาษณ์ เราจะทำ สนับสนุนให้ทุกคนอ่านทั้งหมด เพราะมีนักเก็ตของข้อมูลเชิงลึกในทุกข้อความที่ Karthik ตอบสนองด้วย (และเราชอบตัวอย่างมากเป็นพิเศษที่จะช่วยให้นักเล่นเกมเข้าใจเพียงสิ่งที่เกิดขึ้นเบื้องหลัง)

ภาพหน้าจอจากการสาธิต XeSS ของ Intel ที่แสดงการอัปสเกลที่น่าประทับใจ เทคโนโลยีในที่ทำงาน

Karthik ยังสามารถเปิดเผยรายละเอียดที่น่าตื่นเต้นอย่างแท้จริงเกี่ยวกับ XeSS (ฉันจะไม่สปอยล์) และเราแทบรอไม่ไหวที่จะบอกคุณเกี่ยวกับเรื่องนี้ บทความนี้จะใช้เวลาอ่าน 36 นาทีสำหรับผู้อ่านทั่วไป ดังนั้นโปรดดื่มกาแฟสักแก้ว ของว่าง และสนุกกับการสัมภาษณ์!

Nicolas Mijuskovic [Intel Moderator]: บางทีคุณอาจต้องการถอดมันออก Karthik? ฉันหมายความว่านี่อาจเป็นการสนทนาที่ยอดเยี่ยม แต่ในแง่ของการให้ข้อมูลพื้นฐานเล็กน้อยเกี่ยวกับการลดอัตราการสุ่มสัญญาณโดยทั่วไป วิธีการทำงานและวิธีการที่แตกต่างกัน จากนั้นเราสามารถเจาะลึกลงไปได้ ฉันแน่ใจว่า Usman จะมีจำนวนมาก คำถามเมื่อเราเริ่มไปถึงส่วนประสาทและความท้าทายของเราและวิธีการของเรา

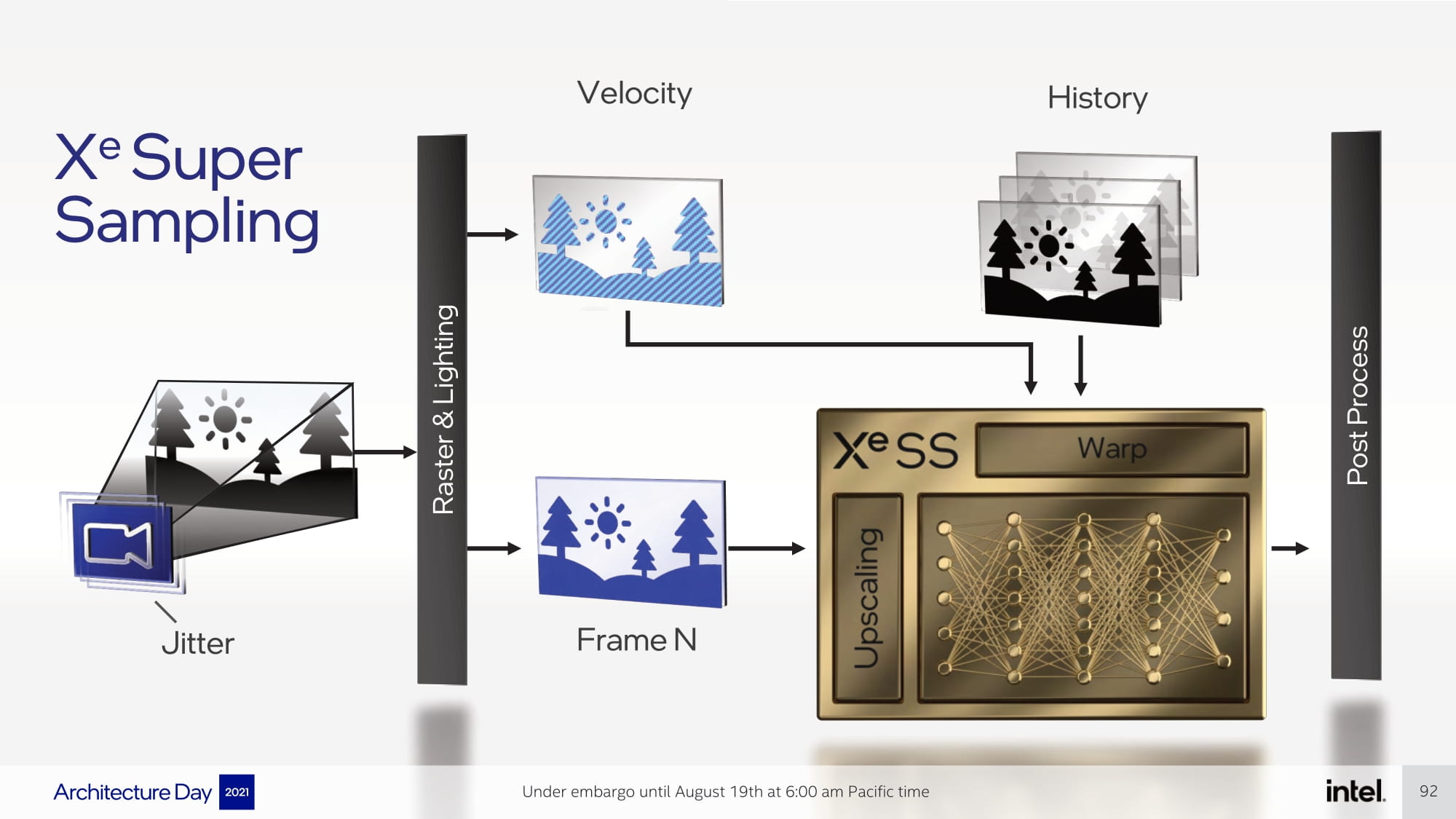

Karthik: ดีมาก เป้าหมายสูงสุดสำหรับเราด้วยเทคโนโลยีอย่าง XeSS คือการสร้างการเรนเดอร์คุณภาพสูงสุดด้วยแสงที่แม่นยำที่สุดซึ่งมีเงาและการสะท้อนที่มีรายละเอียดมากที่สุด และแนะนำสิ่งนี้ด้วยอัตราเฟรมที่ราบรื่น การมีคุณภาพสูงและการเรนเดอร์ที่แม่นยำนั้นมีความซับซ้อน และอาจเป็นเรื่องยากที่จะสร้างพิกเซลทั้งหมดที่คุณต้องการโดยเฉพาะสำหรับจอแสดงผล 4K ที่อัตราเฟรมที่ราบรื่น และนั่นคือที่มาของเทคโนโลยีทั้งหมด แนวคิดที่ว่าเราสามารถแสดงชุดพิกเซลที่เล็กลงทุกเฟรม แล้วใช้ข้อมูลนั้นเพื่อสร้างพิกเซลทั้งหมดที่คุณต้องการสำหรับการแสดงผลเป้าหมายของคุณ ซึ่งอาจเป็นจอแสดงผลที่มีความละเอียดสูงมาก แต่สิ่งสำคัญคือต้องสามารถทำเช่นนี้ได้โดยไม่สูญเสียความดีใดๆ ที่คุณมีในการเรนเดอร์คุณภาพสูงสุดโดยไม่สูญเสียรายละเอียดทั้งหมด เพราะนั่นทำให้จุดประสงค์ของการเรนเดอร์คุณภาพสูงนั้นเสียไปตั้งแต่แรก คุณไม่ต้องการให้ภาพเหมือนจริงทั้งหมดและเพียงแค่ทำให้ภาพเบลอในการแสดงผลสุดท้ายของคุณ [เมื่อใช้เทคโนโลยีการลดอัตราการสุ่มสัญญาณแล้ว] และนั่นนำเราไปสู่เทคโนโลยีประเภทต่างๆ ที่คุณจะได้เห็นและแบ่งออกเป็นสองค่ายใหญ่ๆ

มีการขยายขนาดเชิงพื้นที่ คงจะเคยได้ยินมาบ้างแล้ว พวกเขายังเรียกกันทั่วไปว่าเป็นเทคนิคที่มีความละเอียดสูง ในทางกลับกัน คุณมีเทคนิคการสุ่มตัวอย่างขั้นสูง และเกมสมัยใหม่จำนวนมากใช้เทคนิคการสุ่มตัวอย่างขั้นสูง เช่น การเรนเดอร์กระดานหมากรุก ตอนนี้เจาะลึกลงไปในเทคนิคการเพิ่มสเกลเชิงพื้นที่บางส่วนเหล่านี้ เทคนิคเหล่านี้มักจะง่ายกว่า พวกเขามักจะมีส่วนร่วมหลังจากการต่อต้านนามแฝง ตัวอย่างเช่น หลังจาก TAA พวกเขาดูที่เฟรมเดียวด้วยความละเอียดที่ต่ำกว่า และพวกเขาเพียงแค่ขยายขนาดไปยังความละเอียดเป้าหมาย มีเทคนิคอันชาญฉลาดมากมายที่พวกเขาใช้ในการขยายภาพ แต่เมื่อคุณทำงานกับพิกเซลเล็กๆ ชุดเล็กๆ เช่นนี้ มักจะไม่มีข้อมูลอยู่ที่นั่น และยิ่งกว่านั้น เมื่อคุณทำงานหลังจากลบรอยหยัก คุณสามารถนึกถึงการลบรอยหยักเป็นตัวกรองสัญญาณความถี่ต่ำ ซึ่งจะจบลงด้วยการลบรายละเอียดจำนวนมากในข้อมูลจำนวนมาก

ดังนั้น คุณกำลังทำงานกับชุดข้อมูลเล็กๆ น้อยๆ และจากนั้นคุณเหลือสองทางเลือกในการพยายามสร้างพิกเซลที่ขาดหายไปทั้งหมด และอาจเป็นแบบประมาณหรือแบบภาพหลอน และเทคนิคเรียลไทม์ส่วนใหญ่ที่คุณเห็นคือตัวประมาณ และวิธีการทำงานก็คือ ถ้าคุณมีขอบที่กำหนดไว้อย่างดีหรือคุณสมบัติที่กำหนดไว้อย่างดี คุณสามารถตรวจจับได้ แล้วลับคมหรือสร้างรายละเอียดเหล่านั้นเพราะคุณตรวจพบมันตั้งแต่แรก ตอนนี้คุณสามารถจินตนาการถึงสถานการณ์ที่คุณมีรายละเอียดเล็กๆ น้อยๆ ได้ ส่วนใหญ่มักจะเป็นสายไฟบางๆ แต่ยังมีอีกมาก-ภาพสะท้อนที่ดี ไฮไลท์ สิ่งเหล่านี้ ถ้าคุณดูการแสดงลวดที่มีความละเอียดต่ำ คุณจะ อาจมีหนึ่งพิกเซลตรงนี้ และหนึ่งพิกเซลตรงนั้น และไม่มีทางสรุปได้ว่ามีลวดเชื่อม ดังนั้นจึงเป็นไปไม่ได้ที่จะสร้างรายละเอียดเหล่านั้น และนั่นคือสิ่งที่ค่อนข้างท้าทายสำหรับเทคนิคการเพิ่มสเกลเชิงพื้นที่แบบเฟรมเดียวเหล่านี้เพื่อสร้างรายละเอียดนั้น ขณะนี้มีเทคนิคที่ล้ำสมัย เช่น GAN ที่สามารถทำให้เห็นภาพหลอนได้ แต่สิ่งเหล่านี้ไม่เร็วพอสำหรับโดเมนแบบเรียลไทม์ และยังไม่สามารถสรุปได้ชัดเจนนัก อย่างน้อยก็ยังไม่ได้

การสุ่มตัวอย่างแบบพิเศษเป็นแนวทางที่แตกต่างไปจากเดิมอย่างสิ้นเชิง และเป็นการดีที่จะชี้ให้เห็นถึงความแตกต่างระหว่างสองวิธีนี้ วิธีการทำงานของการสุ่มตัวอย่างแบบพิเศษคืออย่างแรกเลย โดยจะถือว่าการป้องกันรอยหยักและการลดขนาดเป็นปัญหาเดียว สิ่งเหล่านี้ไม่ได้แยกจากกันและทำงานโดยตรงจากพิกเซลที่ไม่มีการกรองที่มาจากการเรนเดอร์ ดังนั้น คุณมีข้อมูลทั้งหมดมาจากการเรนเดอร์ และไม่เพียงเท่านั้น คุณยังดูที่พิกเซลและเฟรมก่อนหน้า และมีข้อมูลมากมายที่นั่น และคุณรวมข้อมูลนั้นเพื่อสร้างพิกเซลทั้งหมดที่คุณต้องการสำหรับความละเอียดเป้าหมายของคุณ อย่างแรกเลย คุณไม่ จำกัด จำนวนข้อมูลที่คุณมีมากเท่ากับปกติ ตัวอย่างเช่น หากคุณมีเส้นลวด ในเฟรมเดียว คุณอาจเห็นเพียงสองพิกเซลบนเส้นลวดนั้น แต่ในกรอบแปดเส้น คุณเริ่มเห็นว่านี่คือสิ่งที่ดูเหมือนเส้นลวด และสิ่งที่น่าสนใจก็คือ Super Sampling มีมาระยะหนึ่งแล้ว การเรนเดอร์กระดานหมากรุกมีอยู่แล้ว เอ็นจิ้นเกมที่ล้ำสมัยใช้เทคนิคประเภทนี้อยู่แล้ว และบ่อยครั้งคุณอาจพบว่าสิ่งเหล่านี้ทำงานได้ดีกว่าการเพิ่มสเกลเชิงพื้นที่

[การสุ่มตัวอย่างแบบพิเศษ] ไม่ใช่ปัญหาที่ง่าย โดยเฉพาะอย่างยิ่งกับการสุ่มตัวอย่างขั้นสูงที่ล้ำสมัยซึ่งมักใช้การวิเคราะห์พฤติกรรม ปัญหาคือมันยากในการค้นหาข้อมูลทั้งหมด พิกเซลทั้งหมดจากเฟรมก่อนหน้าของคุณที่สามารถนำมาใช้เพื่อสร้างเฟรมปัจจุบันของคุณใหม่ได้จริง เพราะมีสถานการณ์มากมายที่อาจเป็นไปไม่ได้ ตัวอย่างเช่น การไม่บดบัง-บางสิ่งอยู่ มองเห็นได้ในเฟรมปัจจุบัน แต่ไม่ปรากฏในเฟรมก่อนหน้า ลองนึกภาพวัตถุขนาดใหญ่บางอย่างในพื้นหน้า ซึ่งมองเห็นได้ในเฟรมก่อนหน้า แต่ในเฟรมปัจจุบัน มันเพิ่งหายไป-มันถูกย้ายออกไป-ดังนั้น คุณจึงไม่สามารถใช้พิกเซลเหล่านั้นได้เนื่องจากไม่ปรากฏให้เห็นในเฟรมปัจจุบัน นั่นคือสถานการณ์หนึ่ง มีหลายสถานการณ์ที่เนื่องจากฉากเป็นไดนามิก สิ่งต่าง ๆ กำลังเคลื่อนไหว คุณไม่สามารถมีการโต้ตอบแบบหนึ่งต่อหนึ่งระหว่างพิกเซลในเฟรมก่อนหน้าและเฟรมปัจจุบันของคุณ

คุณต้องการความฉลาดจริงๆ เพื่อลองตรวจสอบว่าพิกเซลใดใช้งานได้ และในกรณีที่คุณไม่สามารถใช้พิกเซลเหล่านั้นได้ คุณยังต้องการการประมาณที่ดีเช่นเทคนิคเชิงพื้นที่ เกม [เทคนิค] ที่ล้ำสมัยส่วนใหญ่ใช้ฮิวริสติกจำนวนมาก แนวทางที่ออกแบบด้วยมือจำนวนมากเพื่อลองใช้พิกเซลให้ได้มากที่สุดเท่าที่จะทำได้ แต่พยายามทำในลักษณะที่ไม่สิ้นสุด การรวมข้อมูลเท็จหรือข้อมูลที่ไม่ถูกต้องเข้าด้วยกัน แต่ไม่ได้ผลตลอดเวลา ดังนั้น คุณมักจะเห็นสิ่งแปลกปลอม เช่น ภาพซ้อน ภาพเบลอ และสิ่งเหล่านี้เป็นปัญหา ซึ่งมักเกี่ยวข้องกับเทคนิคต่างๆ เช่น TAA การเรนเดอร์กระดานหมากรุก และนั่นคือที่มาของโครงข่ายประสาทเทียม เพราะนี่เกือบจะเป็นปัญหาในอุดมคติของโครงข่ายประสาทเทียม เพราะมันเก่งมากในการตรวจหาคุณลักษณะที่ซับซ้อน และนั่นคือจุดที่เราสามารถใช้พวกมันเพื่อรวมข้อมูลในปริมาณที่เหมาะสม และเมื่อไม่มีข้อมูลนั้น พยายามตรวจหาคุณลักษณะที่ซับซ้อนเหล่านี้และสร้างใหม่ เพื่อเป็นการสรุปเทคโนโลยี

Usman: ขอบคุณสำหรับการทำเช่นนั้น Karthik ดังนั้นปลั๊กเล็กน้อยที่นี่ ในแง่ของคู่แข่ง เรามี FSR, DLSS 1.0, DLSS 2.0 และ Unreal Engine ที่มีการขยายขนาดเวลาของ Unreal Engine ใช่ไหม ฉันเข้าใจว่า XeSS นั้นเหมือนกับ DLSS 1.0 และ 2.0 มากกว่าเพราะมันใช้การสุ่มตัวอย่างแบบซุปเปอร์ประสาทในขณะที่ FSR ไม่ได้ใช้เครือข่ายประสาทเทียม และไม่ใช่แบบ ML หรือ AI และไม่มีการสนับสนุนเวกเตอร์การเคลื่อนไหว ดังนั้นคุณจะจำแนก FSR, DLSS 1 และ 2 และ XeSS อย่างไรเพื่อให้ผู้อ่านสามารถจัดเรียงตำแหน่งของคุณบนแผนที่ในแง่ของเทคนิคการเรนเดอร์

Karthik: ใช่ เทคนิคการสุ่มตัวอย่างขั้นสูงจำเป็นต้องใช้เวกเตอร์การเคลื่อนไหว เนื่องจากคุณกำลังพยายามใช้ข้อมูลจากเฟรมก่อนหน้า และคุณจำเป็นต้องรู้ว่าพวกมันเคลื่อนที่อย่างไรและวัตถุเคลื่อนที่อย่างไร

ดังนั้น FSR จึงเป็นความรู้ของฉัน คือการขยายขนาดเชิงพื้นที่ และเราได้กล่าวถึงการลดอัตราการสุ่มสัญญาณเชิงพื้นที่และข้อจำกัดบางประการแล้ว DLSS 1.0 อีกครั้งฉันไม่ทราบถึง internals ของ DLSS เพราะไม่ได้เปิด แต่จากความเข้าใจของฉัน DLSS 2.0 plus ไม่ได้เป็นแบบทั่วไปในเกม DLSS 2.0 plus เป็นเครือข่ายประสาทเทียมและเป็นภาพรวมได้ดีมาก XeSS ตั้งแต่วันแรก วัตถุประสงค์ของเราต้องเป็นเทคนิคทั่วไป

Usman: ดังนั้นมันจึงเทียบได้กับ DLSS 2.0 มากที่สุด

Karthik: คุณสามารถพูดอย่างนั้นได้ อีกครั้งที่เทคโนโลยีน่าจะแตกต่างกันมาก เท่าที่ใช่มันเป็นโครงข่ายประสาทเทียม ใช่. เป็นเทคนิคการสุ่มตัวอย่างขั้นสูง และใช่ มันเป็นเรื่องทั่วไปในระดับนั้น คล้ายกับระบบอื่น [DLSS 2.0] แต่เทคโนโลยีพื้นฐานน่าจะแตกต่างกันมาก เพราะเมื่อคุณมีกลุ่มอิสระสองกลุ่ม การพยายามแก้ปัญหาในแบบของพวกเขาเอง พวกเขามักจะจบลงด้วยการแก้ปัญหาที่สร้างสรรค์มาก

คุณพูดถึง Unreal Engine 5 และให้คุณภาพสูงสุด ความเที่ยงตรงของแสงเงาทางเรขาคณิต และเมื่อคุณลงทุนอย่างมากในการเรนเดอร์ของคุณ คุณไม่ต้องการที่จะสูญเสียคุณภาพใด ๆ ไปเมื่อคุณปรับขนาดจากจุดนั้น-พิกเซลเหล่านั้นไปยังความละเอียดเป้าหมายของคุณ-และนั่นคือเป้าหมายของเราตั้งแต่วันแรก และคุณไม่ต้องการโซลูชันที่เปราะบางซึ่งต้องได้รับการฝึกฝนสำหรับทุกเกมที่มีคนจัดส่งซึ่งเป็นเป้าหมายของเราตั้งแต่วันแรก

การสาธิต XeSS ที่แสดงโดย Intel ไม่ได้ใช้ในชุดฝึกอบรมของโครงข่ายประสาทเทียม-ทำให้ทุกอย่าง ยิ่งน่าประทับใจมากเท่านั้น

Nicolas: ฉันคิดว่าเราสามารถแบ่งปันในการสาธิตที่แสดง Karthik นั่นไม่ใช่-

Karthik: ใช่ ฉันเดาว่า Usman คุณเคยเห็นการสาธิตแล้ว และฉันสามารถพูดได้ว่า XeSS ไม่เคยเห็นการสาธิตนั้นมาก่อน มันไม่เคยได้รับการฝึกฝนในการสาธิตนั้น เนื้อหาทั้งหมดในฉากนั้นที่คุณเห็นไม่ได้ถูกใช้เป็นส่วนหนึ่งของกระบวนการฝึกอบรมของเรา

Usman: น่าประทับใจมาก ดังนั้น คุณจึงสามารถนำไปใช้กับเกมจำนวนมากได้อย่างรวดเร็ว เพราะคุณไม่จำเป็นต้องฝึกฝนเป็นรายเกม มันเป็นลักษณะทั่วไป

Karthik: อย่างแน่นอน

Usman: และเมื่อวานฉันได้ยินมาว่าพวกคุณวางแผนที่จะสนับสนุน XeSS ในรุ่นเก่าด้วยเช่นกัน ดังนั้นคุณสามารถอธิบายอย่างละเอียดว่ามันทำงานอย่างไร ตามความเข้าใจของฉัน เหตุผลที่ FSR ไม่ได้ใช้แมชชีนเลิร์นนิงเพราะ AMD ต้องการสร้างเครือข่ายที่กว้างขึ้นในรุ่นเก่าเช่นกัน และเรารู้อยู่แล้วว่า DLSS ต้องการความสามารถในการอนุมานบางรูปแบบในฮาร์ดแวร์ แล้วคุณวางแผนจะเปิดตัวสิ่งนี้กับรุ่นเก่าอย่างไร หากคุณวางแผนสำหรับสิ่งเหล่านั้น

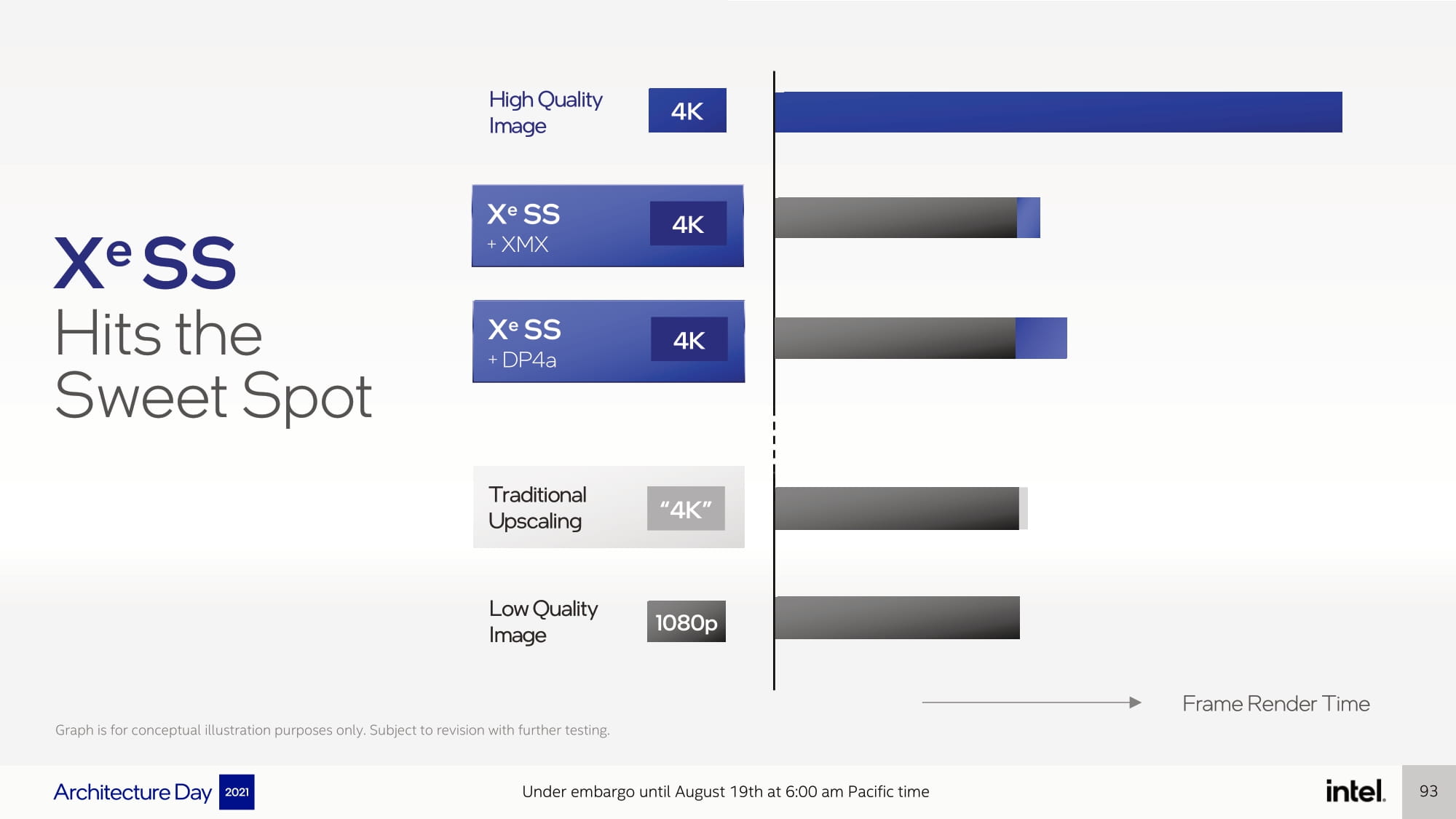

Karthik: ใช่ เราต้องการ ความสามารถในการอนุมาน แต่การเร่งความเร็วเมทริกซ์ไม่ใช่รูปแบบเดียวของความสามารถในการอนุมานที่มีอยู่ใน GPU ถ้าคุณย้อนกลับไป-ฉันคิดว่า Skylake-เรามีการเร่งความเร็วดอทผลิตภัณฑ์ ซึ่งก็คือ DP 4.4 – มีชื่อเรียกต่างๆ มากมาย ฉันคิดว่า Nvidia มีสิ่งนี้เนื่องจากทัวริงและ AMD มีสิ่งนี้บน RDNA2 ดังนั้นแม้ไม่มีการเร่งความเร็วเมทริกซ์ คุณก็สามารถไปได้ไกลทีเดียว อาจไม่เร็วเท่ากับการเร่งความเร็วของเมทริกซ์ แต่ตรงตามวัตถุประสงค์อย่างแน่นอน และอย่างที่ฉันพูดไป จุดประสงค์คือเพื่อรักษาความเที่ยงตรงของการเรนเดอร์ของคุณ และเพื่อให้ได้อัตราเฟรมที่ราบรื่น ดังนั้น เมื่อพูดถึงรุ่นเก่า บน GPU ภายในรุ่นเก่า เรามีการเร่งความเร็วผลิตภัณฑ์ dot (DP4a) มาระยะหนึ่งแล้ว

Microsoft ได้เปิดใช้งานสิ่งนี้ผ่าน Shader Model 6.4 ขึ้นไปและในสิ่งเหล่านี้ แพลตฟอร์ม XeSS จะทำงาน

Usman: เราพบว่าเทคนิคเชิงพื้นที่ประสบปัญหาเมื่อเพิ่มสเกลจากเฟรมอินพุตความละเอียดต่ำ แต่เนื่องจากพวกคุณใช้ neural super เทคนิคการสุ่มตัวอย่าง คุณจะพูดอย่างไรกับค่าโดยสาร XeSS เมื่อเพิ่มสเกลความละเอียดที่ต่ำกว่า คิดว่าเป็น 1080p หรือต่ำกว่า

Karthik: เราควรปรับขนาดให้ดีเพื่อความละเอียดที่ต่ำกว่า และนั่นก็เป็นจุดสำหรับอุปกรณ์แล็ปท็อปของเราเองด้วยใช่ไหม สิ่งเหล่านี้ไม่ได้หมายถึง 4K สิ่งเหล่านี้อาจแสดงผลเป็น 1080p หรือ 720p ดังนั้น กุญแจสำคัญ-โดยเฉพาะอย่างยิ่งเมื่อคุณลดระดับ GPU ที่คุณมี และสำหรับ gpus ระดับกลางและระดับล่าง คุณต้องมีเทคโนโลยีที่ลดขนาดลง และเพิ่มภาระให้กับเทคโนโลยีการอัปสเกลมากขึ้นเนื่องจากมี เพื่อทำงานกับชุดข้อมูลที่มีขนาดเล็กลง และในบางกรณี 8k เป็นปัญหาที่ง่ายเพราะมีความซ้ำซ้อนในการเรนเดอร์ที่คุณสร้างขึ้นได้อยู่แล้ว แต่เมื่อคุณลดระดับลงไปที่ 2k หรือ 1080p มันจะยากขึ้นเรื่อยๆ และคุณอาจเห็นสิ่งนี้ด้วยวิธีการอื่นๆ. แต่เป้าหมายของเราคือพยายามรักษาคุณภาพของภาพนั้นไว้ในขณะที่คุณลดความละเอียดลง

Usman: สถานะปัจจุบันของและ XeSS จัดการกับการเคลื่อนไหวและวัตถุชั่วคราวอื่น ๆ อย่างที่เราเคยเห็นใน DLSS 1.0 อย่างไร – NVIDIA ใดที่ได้รับการแก้ไขด้วย DLSS 2.0 อย่างมาก ผู้ใช้สามารถคาดหวังอะไรได้บ้างในแง่ของสิ่งประดิษฐ์ในวันที่ 1

Karthik: ดังนั้น ฉันคิดว่าปัญหาบางอย่างที่คุณอาจมี เห็นด้วย DLSS 1.0 – และอีกครั้ง ฉันกำลังใช้ข้อมูลนี้ที่เปิดเผยต่อสาธารณะ ทั้งหมดที่ฉันพูดได้คือสิ่งเดียวที่ฉันรู้ ณ จุดนี้คือวิธีการที่ไม่ได้สรุปและเราสามารถอนุมานได้โดยอิงจากสิ่งนั้น. และนี่คือวิธีดูวิธีหนึ่ง: เมื่อพูดถึงโครงข่ายประสาทเทียม กุญแจสำคัญในการสรุป ส่วนหนึ่งคือคุณต้องรู้ ชุดข้อมูลที่แข็งแกร่งและการฝึกอบรมที่แข็งแกร่ง แต่นั่นเป็นเพียงส่วนหนึ่งของปัญหาและฉันขอโต้แย้ง ปัญหาที่ใหญ่กว่าคือการกำหนดปัญหาในวิธีที่ง่ายกว่า เช่น พื้นที่มิติที่ต่ำกว่า ดังนั้นจึงง่ายกว่ามากสำหรับเครือข่ายในการพูดคุยทั่วไป

ฉันสามารถยกตัวอย่างง่ายๆ ให้คุณได้ คุณสามารถให้เครือข่ายพยายามทำนายองค์ประกอบสามสีทั้งหมด R, G และ B หรือคุณอาจมีเครือข่ายที่คาดการณ์เฉพาะตัวกรองที่ใช้กับองค์ประกอบทั้งสามสี ใช่ไหม และนี่คือตัวอย่างง่ายๆ ที่ฉันกำลังคิดขึ้นมาเพื่อถ่ายทอดแนวคิดที่ว่า วิธีที่คุณกำหนดปัญหาจะทำให้คุณมีเส้นทางไปสู่ภาพรวมที่ดีขึ้น และนั่นคือกุญแจสำคัญและทุกประเด็นที่คุณอาจเคยพบใน DLSS 1.0 ที่ซึ่งบางทีก็อาจเบลอไปบ้าง ปัญหาเรื่องการเคลื่อนไหว โดยเนื้อแท้ ก็คือ การกำหนด ปัญหาในลักษณะที่ ง่ายต่อการสรุปและจัดการกับการลบรอยหยักและการขยายขนาดเป็นปัญหาเดียวที่คุณใช้เวกเตอร์การเคลื่อนที่สำหรับปัญหาทั้งสองนี้โดยถือว่าเป็นปัญหาเดียว และนั่นคือกุญแจสำคัญ

Usman: สรุปได้ว่า XeSS สรุปได้ รองรับเวกเตอร์การเคลื่อนไหว และเทียบได้กับความรู้ของคุณกับ DLSS 2.0

Karthik: ใช่

อุสมาน: ดีมาก เรามาพูดถึงแผนงานกันสักหน่อยดีกว่า ดังนั้น Nvidia จึงแบ่งเทคโนโลยี DLSS ออกเป็น DLSS 1.0, DLSS 2.0 พวกคุณจะแยกมันออกเป็นหลายๆ รอบด้วยหรือจะเป็นแค่รุ่นเดียว? และฉันก็ได้ยินมาเช่นกัน ฉันคิดว่า Raja พูดถึงสิ่งนี้ในกิจกรรมก่อนหน้านี้เมื่อวานนี้ว่าพวกคุณวางแผนที่จะเปิดโอเพ่นซอร์สด้วยเช่นกัน

Karthik: มาพูดถึงแผนงานกันก่อน เทคโนโลยีอย่าง XeSS ฉันเชื่อว่ายังมีอะไรอีกมากมายที่เราสามารถทำได้ และฉันคงจะไร้เดียงสาถ้าจะบอกว่าเราแก้ปัญหาทั้งหมดได้ และ XeSS ก็สมบูรณ์แบบ และเราเสร็จแล้ว มันจะดีขึ้นเรื่อยๆ บางทีคุณอาจก้าวร้าวมากขึ้น ขยายขนาด หรือลดความละเอียดลง มีปัญหาที่น่าสนใจมากมายในพื้นที่นี้ ซึ่งเราจะทำการปรับปรุง พัฒนา และเป็นผู้นำต่อไป ใช่. จะมี XeSS 2.0 ในบางจุด XeSS 3.0 ในบางจุด คุณทราบดีว่าในบางจุดกราฟิกอาจเปลี่ยนแปลงไปโดยสิ้นเชิง และมันคือโครงข่ายประสาทเทียมทั้งหมด

และใช่ เราวางแผนที่จะเปิดแหล่งที่มา และมันสำคัญสำหรับเรา เป็นส่วนหนึ่งของวิสัยทัศน์ของเราสำหรับเทคโนโลยีเช่นนี้ อย่างแรกเลย ISV รู้จริง ๆ ว่าพวกเขากำลังผสานรวมอะไรอยู่เมื่อเราแชร์แหล่งที่มา พวกเขาเข้าใจเทคโนโลยี พวกเขาสามารถต่อยอดจากมันได้ เราจึงได้แชร์ความคิดที่ใหญ่ขึ้นเป็นผลให้

เรามีมุมมองที่แน่นอน เกี่ยวกับเรื่องนี้ เรามีนักวิจัยที่เก่งที่สุดในการแก้ปัญหานี้ แต่ฉันคิดว่าการแบ่งปันสิ่งนี้กับชุมชนที่ใหญ่ขึ้นจะช่วยให้เราใช้ประโยชน์จากสิ่งต่างๆ ได้มากขึ้น และยังมีอะไรอีกมากมายที่เราสามารถทำได้ นั่นก็เป็นส่วนหนึ่ง แน่นอนว่ามีบางอย่างที่เป็นผู้ขายข้ามและโอเพ่นซอร์สที่ดีกว่ามาก เพราะมีอุปสรรคต่ำกว่าในการรับเลี้ยงบุตรบุญธรรมใช่ไหม? เพราะถ้าคุณมีเทคโนโลยีที่เป็นโอเพ่นซอร์สและทำงานบนหลายแพลตฟอร์ม เป็นสิ่งที่คุณสามารถรวมเข้ากับเอ็นจิ้นเกมของคุณ และไม่ต้องสร้างความแตกต่างให้กับทุกแพลตฟอร์มที่คุณใช้งานอยู่ ใช่แล้ว เป้าหมายของเราตั้งแต่วันแรกคือต้องมีโซลูชันที่ทำงานบน GPU อื่นๆ เป็นโอเพ่นซอร์ส และสามารถกำหนดเส้นทางหรือกำหนดเส้นทางสู่การยอมรับในวงกว้างทั่วทั้งอุตสาหกรรม

และนั่น เป็นสิ่งที่คุณต้องการสำหรับการประยุกต์ใช้เทคโนโลยีเช่นนี้ในวงกว้าง คุณสามารถคิดค้นเทคโนโลยีที่ก่อกวนที่สุดได้ แต่ถ้าเป็นกล่องดำ ย่อมมีความท้าทายเสมอ

Usman: และสิ่งที่ฉันเข้าใจคือ ว่าในตอนแรกจะถูกปล่อยเป็นโอเพ่นซอร์ส แต่สุดท้ายก็ย้ายไปโอเพ่นซอร์ส ความเข้าใจนี้ถูกต้องหรือไม่

Karthik: ฉันไม่ทราบไทม์ไลน์ที่เกี่ยวข้องอย่างเต็มที่ – แต่ในที่สุดมันจะเป็นโอเพ่นซอร์สที่ฉันสามารถยืนยันได้.

อุสมาน: ยุติธรรมดีแล้ว คุณกำลังทำงานร่วมกับนักพัฒนาเกมรายใหญ่ๆ ในตอนนี้ เพื่อรวม XeSS หรือพันธมิตรด้านระบบนิเวศสำหรับ XeSS โดยเฉพาะ อย่างที่ผมทราบดีว่าพวกคุณกำลังทำงานร่วมกับผู้คนจำนวนมากเท่าที่ Xe HPG ดำเนินไป แต่ XeSS หรือ XeSS นั้นยังทำงานไม่ถึง ในขั้นตอนนั้นคุณจะเป็นพันธมิตรกับพันธมิตรระบบนิเวศหรือผู้พัฒนาเกมรายอื่นๆ หรือไม่

Karthik: มีพันธมิตรหลายรายที่เรากำลังดำเนินการอยู่ กับ. ฉันไม่สามารถแสดงความคิดเห็นเพิ่มเติมในตอนนี้

Usman: แต่นี่เป็นนักพัฒนาเกมหรือพันธมิตรรายอื่น ๆ

Karthik: รวมถึงผู้พัฒนาเกม ฉันหวังว่าฉันจะสามารถแบ่งปันมากขึ้นฮ่าฮ่า

Bioshock Infinite and Half Life เป็นเกมโปรดของ Karthik

Usman: พักหายใจและพูดคุยเกี่ยวกับสิ่งที่เบากว่านี้สักครู่. คุณอยู่ที่นี่มา 10 ปีแล้วใช่ไหม คุณจะพูดว่าอะไรคือเกมโปรดของคุณ

Karthik: อาจจะ 11 ฉันนับไม่ถ้วนในบางจุด โอ้ เป็นคำถามที่น่าสนใจมาก เกมเดียวที่นึกถึงคือ BioShock Infinite ฮ่าๆๆ ฉันคิดว่านั่นเป็นสิ่งที่ติดอยู่กับฉันมาระยะหนึ่งแล้ว คุณก็รู้ เมื่อย้อนกลับไปสมัยเรียนมหาวิทยาลัยของฉัน มี Half-Life แน่นอน ทุกคนกำลังรอ Half Life 3 และคุณสามารถรวมฉันไว้ในรายการนั้นได้ มันอาจจะไม่เกิดขึ้นในชีวิตของฉัน ฮ่า

แต่ใช่ BioShock Infinite น่าจะเป็นเกมสุดท้ายที่ฉันจำได้อย่างชัดเจนด้วยเหตุผลหนึ่งข้อ สำหรับฉัน ส่วนตัวแล้ว ฉันสนใจเรื่องนี้มากกว่า ในแง่ของการบอกเล่า สำหรับฉันแล้ว เกมเป็นอีกรูปแบบหนึ่งของการแสดงออกทางศิลปะ บางอย่างที่คล้ายกับภาพยนตร์ แต่มีระดับความเป็นอิสระและศักยภาพที่มากขึ้น ดังนั้นฉันจึงมักจะลำเอียงต่อเกมที่มีลักษณะการเล่าเรื่องที่แข็งแกร่งมาก ถูกต้อง? ฉันไม่ค่อยชอบเล่นเกมแบบผู้เล่นหลายคน เพราะสำหรับฉัน นั่นไม่ใช่สิ่งที่ฉันสนใจมาตลอด มันเกี่ยวกับการมีประสบการณ์ที่ดื่มด่ำและเพียงแค่ชื่นชมภาพ การป้อนข้อมูลที่สร้างสรรค์ เพียงแง่มุมทางศิลปะของมัน และนั่นคือสิ่งที่ดึงฉันมาสู่วงการนี้ เทคโนโลยีนี้ และใช่ ฉันเดา BioShock Infinite เป็นหนึ่งในเกมที่มีโครงเรื่องที่แข็งแกร่งมากในความคิดของฉัน

Usman: ฟังดูดีและฉันรู้ว่านี่อาจเป็นคำถาม ที่ดูจะลำเอียง แต่ถ้าออกจากระบบนิเวศ Xe HPG ทั้งหมด คุณชอบฟีเจอร์อะไรมากที่สุด? จึงจะเป็นอะไรก็ได้ เรย์ เทรซิ่ง, XeSS. ดังนั้น อย่าลังเลที่จะให้สิ่งที่คุณต้องการ

Karthik: ฉันยังทำงานเกี่ยวกับ raytracing ดังนั้นฉันจะวาง ray tracing และ XeSS ในระดับเดียวกัน. ทั้งสองเป็นเทคโนโลยีที่ก่อกวนและมองไปข้างหน้าซึ่งกำลังกำหนดแนวโน้มสำหรับกราฟิกยุคหน้า

Usman: ดังนั้นหากคุณจะเล่นเกม คุณจะเล่นมันโดยเปิด raytracing อย่างแน่นอน

Karthik: ตราบใดที่ฉันทำได้ 60 FPS ฉันต้องยอมรับ ฉันเล่น Cyberpunk โดยปิด raytracing เพราะมันไม่สามารถแตะ 60 FPS บน NVIDIA RTX 2070 ของฉันได้ แต่ใช่ อัตราเฟรมที่ราบรื่นนั้นสำคัญมาก และนั่นคือปัญหาที่คุณต้องแก้ มันค่อนข้างจะย้อนกลับไปที่สิ่งที่ฉันพูดในตอนแรก คุณต้องการมีพิกเซลคุณภาพสูงที่สุด ฉันต้องการมีประสบการณ์ที่ดื่มด่ำนี้ คุณรู้ไหม เพียงแค่มีความเที่ยงตรงสูงสุดตั้งแต่การป้อนข้อมูลที่สร้างสรรค์ของศิลปินไปจนถึงประสบการณ์การรับชมใช่ไหม และไม่สูญเสียข้อมูลใดๆ ระหว่างทาง และนั่นคือสิ่งที่ทำให้เราตื่นเต้น ใช่ และฉันต้องการเล่น Cyberpunk โดยเปิด Ray Tracing เราต้องการทำงานกับเทคโนโลยีที่ปลดล็อกการเรนเดอร์รุ่นต่อไป มีความเหมือนจริงมากขึ้น และไม่ต้องจ่ายเฟรมใดๆ สำหรับมัน

Usman: และที่จริงแล้ว ที่ทำให้ฉันนึกถึงการติดตามผลเล็กน้อย ดังนั้นเทคโนโลยีการเรนเดอร์อื่น ๆ เช่น DLSS และ FSR จึงมีโหมดประสิทธิภาพและโหมดคุณภาพ พวกคุณพยายามทำอะไรแบบนั้นด้วยเหรอ? หรือมันจะเป็นแค่ XeSS มาตรฐาน ? ผู้ใช้ควรคาดหวังอะไรในแง่ของกลไก? เหมือนมันจะเลื่อน? จะเป็นโหมดประสิทธิภาพในโหมดคุณภาพหรือแค่ปิด XeSS

Karthik: เราจะมีโหมดคุณภาพเป็น FSR ทั้งคู่ และ DLSS ก็มีอยู่ ณ จุดนี้ คุณก็รู้ เราจะสนับสนุนเช่นเดียวกันเมื่อผู้ใช้คุ้นเคยกับมัน ดังนั้นเราจะสนับสนุนสิ่งนั้น แต่ฉันยังต้องการชี้ให้เห็นว่าสิ่งหนึ่งที่สูญหายไปในโหมดต่างๆ เหล่านี้ ประสิทธิภาพ คุณภาพ คุณภาพพิเศษ คือสิ่งที่คุณต้องการจริงๆ ก็คือบางอย่างเช่น โหมดประสิทธิภาพ ให้คุณภาพของภาพที่ใกล้เคียงกันมาก คุณภาพพิเศษที่ไม่ต้องเสียไปจากประสบการณ์การรับชม

และวิธีที่การตั้งค่าเหล่านี้ทำงานในทุกเกม ใน FSR นั้น DLSS เป็นเพียงการควบคุมความละเอียดอินพุตของคุณ ดังนั้นคุณภาพพิเศษจึงรันอินพุตด้วยความละเอียดสูงขึ้น – คุณกำลังสร้างพิกเซลมากขึ้น คุณภาพสร้างพิกเซลน้อยลงเล็กน้อย สมดุลสร้างพิกเซลน้อยลง ประสิทธิภาพสร้างจำนวนพิกเซลที่น้อยที่สุด และในบางแง่มุมที่สะท้อนถึงความสามารถของเทคโนโลยีการลดอัตราการสุ่มสัญญาณของคุณ เมื่อคุณวิ่งด้วยคุณภาพหรือคุณภาพพิเศษ เทคนิคการเพิ่มสเกลนั้นไม่มีอะไรต้องทำมากนัก คุณรู้อยู่แล้วว่าพิกเซลส่วนใหญ่และคุณอาจหลีกเลี่ยงเทคนิคการลดอัตราการสุ่มสัญญาณที่ถูกกว่าได้ เมื่อคุณเริ่มลดประสิทธิภาพลง ซึ่งเป็นประเภทที่ปลดล็อก 60 เฟรมต่อวินาทีด้วยการเรนเดอร์คุณภาพสูงสุด นั่นคือสิ่งที่คุณรู้ ความสามารถของเทคโนโลยีการลดอัตราการสุ่มสัญญาณเริ่มออกมาแล้วจริงๆ

Usman: สำหรับการพัฒนา XeSS Intel วัดคุณภาพในเชิงปริมาณของกราฟิกที่เพิ่มสเกลอย่างไร หรือมันเป็นเรื่องส่วนตัวทั้งหมด

Karthik: เราทำทั้งสองอย่าง เราทำการทดสอบโดยผู้ใช้ และเรามีชุดเมตริกเชิงคุณภาพที่เราใช้ ยังมีเมตริกเชิงปริมาณอีกหลายตัวที่เราสามารถใช้ได้ และอย่างน้อยที่สุด คุณมีสิ่งต่างๆ เช่น PSNR (อัตราส่วนสัญญาณภาพต่อสัญญาณรบกวน) แต่มีเมตริกขั้นสูงอื่นๆ ที่เราสามารถใช้ได้ในขณะนี้ ซึ่งเราใช้สำหรับการวิเคราะห์เชิงปริมาณ แต่ ที่ไม่เพียงพอ ไม่มีเมตริกใดที่สมบูรณ์แบบเมื่อพูดถึงการรับรู้ของผู้ใช้ โดยเฉพาะอย่างยิ่งกับการเล่นเกม ดังนั้น เราจึงต้องพึ่งพาการทดสอบผู้ใช้ในปริมาณที่พอเหมาะเสมอ เราทำทุกอย่างเท่าที่ทำได้เพื่อทดสอบสิ่งนี้และรับการตรวจสอบคุณภาพของภาพในอีกระดับหนึ่ง คุณมีเมตริกพื้นฐานอย่าง PSNR อยู่แล้ว แต่นั่นเป็นเพียงการเกาผิวเผินเท่านั้นเมื่อพูดถึงการประเมินคุณภาพของภาพ มีเมตริกขั้นสูงอื่นๆ ที่เราสามารถใช้ได้ในปัจจุบัน เช่น เมตริกการรับรู้

Usman: XeSS จะพร้อมใช้งานในชื่อ/เอนจิ้นเกมหรือไม่ 1 เมื่อ ARC Alchemist GPU ของ Intel เปิดตัวหรือจะวางจำหน่ายในภายหลังหรือไม่

Karthik: เรายังไม่ได้ให้รายละเอียดว่า แสดงความคิดเห็นเกี่ยวกับเรื่องนี้

Usman: การใช้งาน XeSS XMX ใช้ประโยชน์จากฮาร์ดแวร์ของคู่แข่งอย่าง Tensor Cores (NVIDIA) หรือไม่

คาร์ทิค: อ่า ไม่ จนกว่าจะมีการกำหนดมาตรฐานเกี่ยวกับการเร่งความเร็วของเมทริกซ์ที่เป็นข้ามแพลตฟอร์ม ไม่ใช่เรื่องง่ายที่เราจะสร้างสิ่งที่ทำงานบนฮาร์ดแวร์การเร่งความเร็วเมทริกซ์ทุกประเภท DP4a ได้มาถึงขั้นที่คุณรู้แล้วว่ารองรับสิ่งนี้ในทุกแพลตฟอร์ม แน่นอนบนแพลตฟอร์มที่ทันสมัยทั้งหมด ที่ทำให้เราง่ายขึ้นมาก แต่การเร่งความเร็วของเมทริกซ์ไม่ได้อยู่ที่ระยะเดียวกันนั้น ดังนั้นการนำเมทริกซ์ของเราไปใช้ที่กำหนดเป้าหมาย XMX จึงเป็นข้อมูลเฉพาะของ Intel

Usman: XeSS ทำงานบนฮาร์ดแวร์ที่ไม่มี XMX หรือ DP4a รองรับกับ FP16 หรือ FP32 หรือไม่ ทางเลือก?

Karthik: ไม่ ไม่ใช่ในขณะนี้ เราจะตรวจสอบมัน แต่ฉันไม่สามารถผูกมัดกับสิ่งใดได้ในตอนนี้ แม้ว่าคุณจะสามารถทำได้ แต่ก็มีคำถามใหญ่เกี่ยวกับประสิทธิภาพและพิจารณาว่าสมควรหรือไม่

Usman: ความละเอียดคืออะไร โมเดล XeSS ได้รับการฝึกฝนที่ สำหรับบริบท NVIDIA DLSS ได้รับการฝึกฝนที่ 16k.

Karthik: นั่นเป็นคำถามที่น่าสนใจมาก ขอผมพูดให้แตกต่างออกไป เราฝึกด้วย 64 ตัวอย่างต่อภาพอ้างอิงพิกเซล และผมคิดว่ามันสมเหตุสมผลกว่า เพราะสิ่งที่เราพยายามจะจับคู่ คุณภาพที่เราพยายามฝึกเครือข่ายด้วยคือ 64x SSAA นั่นคือสิ่งที่เราใช้ฝึกเครือข่าย และอีกวิธีหนึ่งในการดูก็คือจำนวนตัวอย่างที่เครือข่ายทั้งหมดกลายเป็นตัวอย่าง ดังนั้น เมื่อ NVIDIA พูดถึงภาพ 16k ฉันคิดว่ามันจะแปลเป็นจำนวนตัวอย่างที่มีอยู่ในพิกเซล

จากจุดยืนของเรา นั่นคือสิ่งที่ฉันสามารถพูดถึงได้ เราฝึกด้วยภาพอ้างอิงที่มี 64 ตัวอย่างต่อพิกเซล

ตอนนี้ ถ้าคุณต้องการวาดความละเอียดจากจุดนั้น คุณสามารถคำนวณได้ 64 จะเป็น 8 ตัวอย่างใน X และ Y คุณคงรู้ได้ว่านั่นคือ 32k นั่นคือสิ่งที่มันจะเป็น โอเค แต่ฉันจะไม่เรียกมันว่า 32k เพราะสิ่งที่เรากำลังทำอยู่นั้นมีประสิทธิภาพ ตัวอย่างทั้งหมดนั้นมีส่วนทำให้เกิดพิกเซลเดียวกัน ฉันคิดว่า 64 ตัวอย่างทั้งหมดมีส่วนทำให้พิกเซลเดียวกัน แต่ใช่แล้ว พิกเซล 32k ที่มีประสิทธิภาพคือสิ่งที่เราใช้ฝึก – คือสิ่งที่เราใช้สร้างข้อมูลอ้างอิงสำหรับภาพเดียว

Usman: Will XeSS ทำงานบนความละเอียดสูงกว่า 4k? พูด 8k?

Karthik: นั่นอยู่ในแผนงานของเราอย่างแน่นอน

Usman: DP4a ทำงานโดยตรงบน DX12 ด้วย SM6.4 หรือไม่ และเวอร์ชัน XMX ถูกเปิดเผยบน DirectML ด้วย Metacommands อย่างไร

Karthik:

แข็งแกร่ง> นั่นเป็นคำถามที่น่าสนใจ ก่อนอื่น ฉันต้องการชี้ให้เห็นว่าทั้งเวอร์ชัน DP4a และเวอร์ชัน XMX นั้นถูกเปิดเผยผ่าน API เดียวกัน ในแง่ของการรวมเข้าด้วยกัน อันที่จริงมันก็เหมือนกัน มันเหมือนกัน สิ่งที่เอ็นจิ้นเกมเห็นคืออินเทอร์เฟซเดียวกันและภายใต้อินเทอร์เฟซนั้น คุณสามารถเลือกเวอร์ชัน DP4a หรือ XMX และขึ้นอยู่กับแพลตฟอร์ม ดังนั้นฉันจึงต้องการชี้แจงว่า ไม่ใช่สองอินเทอร์เฟซที่แตกต่างกัน มันเป็นอินเทอร์เฟซเดียวกันและไลบรารีเดียวกันกับที่รวมเข้ากับสองเส้นทางที่แตกต่างกันภายใน ซึ่งทำให้นักพัฒนาเกมง่ายขึ้นมาก

มาถึงคำถามของคุณแล้ว ดังนั้นสำหรับ DP4a ใช่ SM 6.4 และเกิน SM 6.6 เช่น รองรับ DP4a และ SM 6.6 ยังรองรับการบรรจุภายในเหล่านี้สำหรับการดึงข้อมูล 8 บิตและการบรรจุข้อมูล 8 บิต เราจึงแนะนำ SM 6.6

เราไม่ใช้ DirectML ดูประสิทธิภาพแบบที่คุณกำลังมองหาในแบบเรียลไทม์ แม้แต่ 100 ไมโครวินาทีก็มีความสำคัญมาก ดังนั้นสำหรับการนำไปใช้จริง เราจำเป็นต้องผลักดันขอบเขตของการนำไปใช้และการเพิ่มประสิทธิภาพ และเราต้องการความสามารถที่กำหนดเองจำนวนมาก เลเยอร์ที่กำหนดเอง การฟิวชั่นแบบกำหนดเอง สิ่งต่างๆ เช่นนั้นเพื่อแยกระดับของประสิทธิภาพนั้น และในรูปแบบปัจจุบันคือ DirectML doesn’t meet those requirements, but we are certainly looking forward to the evolution of the standards around Matrix acceleration and we’re definitely keeping an eye on it and we hope that our approach to XeSS sets the stage for the standardization effort around real-time neural networks.

Usman: This should be an easy one, when did the work on XeSS start?

Karthik: From the point at which we started working on our research, it’s been more than a couple of years. Let’s just say that. So certainly not something we put together in the last year or the last couple of months, it has been going on for a while.

Usman: When can we expect the software development toolkit to go live?

Nicolas: It will be later this month for ISVs (XMX) and later this year for the DP4a but it will not be a public release. And that as XeSS matures, we’ll open up to tools and SDK for everyone.

Usman: Will XeSS be applied at the driver level in all games or need to be implemented natively in game engines? We are hearing of a tool which allows FSR to be implemented on pretty much all steam games?

Karthik: Just like DLSS, it would have to be integrated into the game engine. It’s not something that can be hidden from the game engine, and that’s why we need to work with ISVs to get this into the game and are trying our best to make it as easy as possible integrate this.

It requires developer support but having said that, generally, super sampling technologies that are implemented at the tail end of the pipeline, closer to the display, will always have more challenges. I can give you a clear example. Let’s say you had film grain noise that was introduced as a post process-trying to apply an upscaling or super sampling solution after that fact becomes very challenging.

So even if one were to implement something like this as an upscaling solution, for example, just close to the display, there’s always going to be scenarios like this when you know the game engine does some kind of post processing that just breaks it. So being closer to the render gives you, as we discussed the last time, the highest fidelity information with the amount of controllability that you need to be able to produce the best result.

Usman: How hard will XeSS be to implement compared to DLSS?

Karthik: It should be similar and there’s another way to look at it. So for a game that implements TAA already, integrating something like XeSS should only be a small amount of effort because you already have all the pieces that we need with any TAA Implementation. Like you have the motion vectors, you have the jitter. So you have all the pieces for any kind of super sampling technique to be integrated if the game already has a TAA implementation. So that’s a pretty large set of games right now. TAA has almost become like a de facto, you know, standard for antialiasing. So for any game that already has TAA, it already has the pieces that you would need to integrate XeSS or any super sampling technique with a few modifications, of course, but those are small modifications.

Usman: Thank you so much Karthik and Nicolos. This is a wrap from my side.

Special shout out to Patrick Moorehead (@PatrickMoorhead), Sebastian Moore (@Sebasti90655465), Locuza (@Locuza_), MeoldoicWarrior (@MelodicWarrior1), Albert Thomas (@ultrawide219), and WildCracks (@wild_cracks) for contributing to the interview questions.