Kurz nachdem Samsung neue Barrierefreiheitsfunktionen für die Galaxy Buds 2 Pro angekündigt hatte, kündigte Apple einige Barrierefreiheitsfunktionen für iPhones an. Kurz vor dem Global Accessibility Awareness Day (18. Mai 2023) kündigte Apple Funktionen zur Verbesserung der Barrierefreiheit auf iPhones an, und es sieht so aus, als ob diese Funktionen von den Funktionen von Samsung inspiriert wurden.

Apples Assistive Access ähnelt dem Easy Mode von Samsung, während Live Speech Bixby Text Call ähnelt

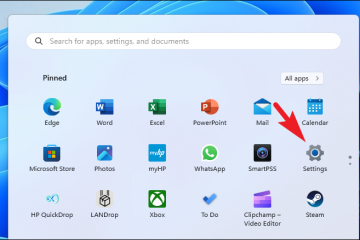

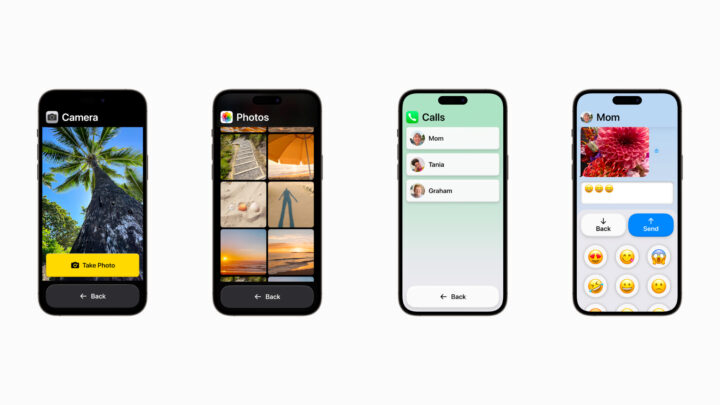

Apple enthüllt Assistiver Zugriff, Live-Sprache und persönliche Stimme. Assistive Access richtet sich an Menschen mit kognitiven Behinderungen und bietet größere UI-Elemente und-Layouts, damit Menschen problemlos auf die wesentlichen Funktionen zugreifen können. Diese Funktion ähnelt dem Easy Mode von Samsung, der die Benutzeroberfläche für einen einfacheren Zugriff optimiert, was älteren Menschen oder Menschen mit kognitiven Beeinträchtigungen hilft. Die Funktion von Apple funktioniert auf iPhones und iPads mit wichtigen Apps wie Anrufen, Kamera, Nachrichten, Musik und Fotos und bietet größere Touch-Ziele und UI-Elemente. Diese Funktion wird später in diesem Jahr als Teil des iOS 17-Updates eingeführt.

Mit Live Speech können Benutzer während eines Sprachanrufs eingeben, was sie zu sagen haben. Ein iPhone, iPad oder Mac wandelt diesen Text dann in Sprache um und leitet ihn an die andere Seite des Anrufs weiter. Benutzer können auch schnelle Phrasen speichern, um sie während eines Anrufs zu verwenden. Diese Funktion ähnelt der Bixby Text Call-Funktion von Samsung, die bei Anrufen Stimmen in Text umwandelt und umgekehrt.

Apples Personal Voice-Funktion ähnelt dem Bixby Custom Voice Creator von Samsung.

Apples Personal Voice-Barrierefreiheitsfunktion ist für Benutzer konzipiert, bei denen das Risiko besteht, dass sie ihre Stimme verlieren. Sie können eine Stimme erzeugen, die wie sie klingt, indem sie eine zufällige Reihe von Textansagen vorlesen und so 15 Minuten Audio auf einem iPhone oder iPad aufnehmen. Diese Funktion scheint vom Bixby Custom Voice Creator inspiriert zu sein, den Samsung Anfang des Jahres auf den Markt brachte.

Neben all diesen Funktionen hat Apple auch den Erkennungsmodus in der Lupe angekündigt, mit dem iPhone-Nutzer mit Sehbehinderung Text von Objekten lesen können. Benutzer können die Kamera des iPhones einfach auf ein Objekt oder einen Text richten, den sie gerade betrachten, und der Erkennungsmodus liest diesen Text und sagt ihn laut vor. Dies ähnelt Samsungs Bixby Vision-Funktionen: Farbdetektor, Objektidentifizierung, Szenenbeschreibung und Textleser.

Zu den weiteren neuen Funktionen gehören die „Made for iPhone Hearing Devices“-Zertifizierung für Hörgeräte, Verbesserungen der Sprachsteuerung, mehr Textgrößenoptionen in wichtigen Mac-Apps, das Anhalten von Bildern mit beweglichen Elementen (für diejenigen, die empfindlich auf schnelle Animationen reagieren), und natürlichere Stimmen für Voice Over.