Seit der Einführung von GPT-4 sind etwas mehr als zwei Monate vergangen, aber die Benutzer haben begonnen, die Veröffentlichung von GPT-5 zu erwarten. Wie leistungsfähig und leistungsfähig GPT-4 ist, haben wir bereits in verschiedenen Tests und qualitativen Bewertungen gesehen. Mit vielen neuen Funktionen wie ChatGPT-Plugins und der Möglichkeit zum Surfen im Internet ist es noch besser geworden. Jetzt warten Benutzer darauf, mehr über das kommende OpenAI-Modell, GPT-5, die Möglichkeit von AGI und mehr zu erfahren. Um detaillierte Informationen zum Veröffentlichungsdatum von GPT-5 und anderen erwarteten Funktionen zu erhalten, folgen Sie unserer Erklärung unten.

Inhaltsverzeichnis

GPT-5-Veröffentlichungsdatum

Als GPT-4 im März 2023 veröffentlicht wurde, wurde erwartet, dass OpenAI sein Modell der nächsten Generation bis Dezember 2023 veröffentlichen würde. Siqi Chen , twitterte der CEO von Runway ebenfalls und sagte, dass „gpt5 das Training voraussichtlich im Dezember abschließen wird.“ Allerdings sagte OpenAI-CEO Sam Altman bei einer MIT-Veranstaltung im April: „Wir werden es nicht tun und werden es auch für einige Zeit nicht tun“, als er gefragt wurde, ob OpenAI GPT-5 trainiert. Das Gerücht, dass GPT-5 Ende 2023 veröffentlicht werden soll, ist also bereits widerlegt.

Dennoch gehen Experten davon aus, dass OpenAI genau wie GPT-3.5 bis Oktober 2023 GPT-4.5 herausbringen könnte, eine Zwischenversion zwischen GPT-4 und GPT-5. Es wird gesagt, dass GPT-4.5 endlich die multimodale Fähigkeit bringen wird, also die Fähigkeit, sowohl Bilder als auch Texte zu analysieren. OpenAI hat den multimodalen Ansatz von GPT-4 bereits angekündigt und demonstriert Funktionen während des GPT-4-Entwickler-Livestreams im März 2023.

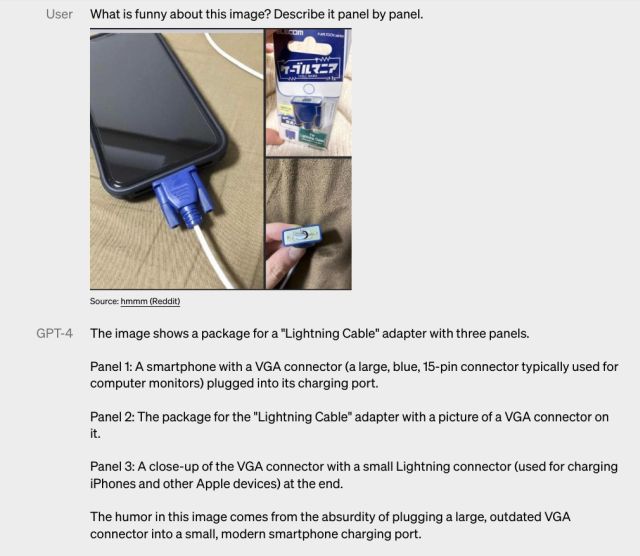

Multimodale GPT-4-Fähigkeit

Multimodale GPT-4-Fähigkeit

Abgesehen davon hat OpenAI derzeit viel zu tun, um am GPT-4 zu arbeiten. 4-Modell, bevor es mit GPT-5 zu arbeiten beginnt. Derzeit ist die Inferenzzeit von GPT-4 sehr hoch und die Ausführung recht teuer. Der Zugriff auf die GPT-4-API ist immer noch schwer zu bekommen. Darüber hinaus hat OpenAI erst kürzlich den Zugriff auf ChatGPT-Plugins und Internet-Browsing-Funktionen eröffnet, die sich noch in der Betaphase befinden. Code Interpreter steht noch nicht allen zahlenden Benutzern zur Verfügung und befindet sich erneut in der Alpha-Phase.

Obwohl GPT-4 sehr leistungsstark ist, denke ich, dass OpenAI erkennt, dass Recheneffizienz eines der Schlüsselelemente für die nachhaltige Ausführung eines Modells ist. Und nun, wenn Sie dem Mix neue Funktionen und Fähigkeiten hinzufügen, haben Sie eine größere Infrastruktur, mit der Sie umgehen müssen, und stellen gleichzeitig sicher, dass alle Kontrollpunkte zuverlässig funktionieren. Um also eine Vermutung zu wagen, wird GPT-5 voraussichtlich im Jahr 2024 herauskommen, ungefähr um die Veröffentlichung von Google Gemini, sofern wir davon ausgehen, dass Regierungsbehörden keine regulatorischen Hürden setzen.

GPT-5-Funktionen und-Funktionen ( Erwartet)

Reduzierte Halluzination

Das heiße Gerede in der Branche ist, dass GPT-5 AGI (künstliche allgemeine Intelligenz) erreichen wird, aber wir werden dazu kommen das später im Detail. Darüber hinaus soll GPT-5 die Inferenzzeit verkürzen, die Effizienz steigern, weitere Halluzinationen reduzieren und vieles mehr. Beginnen wir mit der Halluzination, die einer der Hauptgründe dafür ist, dass die meisten Benutzer nicht ohne weiteres an KI-Modelle glauben.

GPT-4-Genauigkeitstest

Laut OpenAI erzielte GPT-4 in allen neun Kategorien 40 % bessere Ergebnisse als GPT-3.5 in internen kontradiktorisch konzipierten Faktenbewertungen. Jetzt ist die Wahrscheinlichkeit, dass GPT-4 auf ungenaue und unzulässige Inhalte reagiert, um 82 % geringer. Bei Genauigkeitstests in allen Kategorien liegt es nahe daran, die 80-Prozent-Marke zu erreichen. Das ist ein großer Fortschritt im Kampf gegen Halluzinationen.

Nun wird erwartet, dass OpenAI die Halluzination in GPT-5 auf weniger als 10 % reduzieren würde, was für die Vertrauenswürdigkeit von LLM-Modellen enorm wäre. Ich habe das GPT-4-Modell in letzter Zeit für viele Aufgaben verwendet und es hat bisher nur sachliche Antworten geliefert. Daher ist es sehr wahrscheinlich, dass GPT-5 noch weniger halluziniert als GPT-4.

Recheneffizientes Modell

Als nächstes wissen wir bereits, dass die Ausführung von GPT-4 teuer ist (0,03 $ pro 1.000 Token) und die Inferenzzeit auch höher ist. Das ältere GPT-3.5-Turbo-Modell hingegen ist 15-mal günstiger (0,002 USD pro 1K-Token) als GPT-4. Das liegt daran, dass GPT-4 auf einer riesigen Menge von 1 Billion Parametern trainiert wird, was eine kostspielige Recheninfrastruktur erfordert. In unserer aktuellen Erklärung zum PaLM 2-Modell von Google haben wir herausgefunden, dass PaLM 2 deutlich kleiner ist und dies zu einer schnellen Leistung führt.

Eine aktuelle Bericht von CNBC bestätigte, dass PaLM 2 auf 340 Milliarden Parameter trainiert wird, was weit weniger ist als die große Parametergröße von GPT-4. Google sagte sogar weiter, dass größer nicht immer besser sei und Forschungskreativität der Schlüssel zur Erstellung großartiger Modelle sei. Wenn OpenAI also seine kommenden Modelle rechenoptimal machen möchte, muss es neue kreative Wege finden, um die Größe des Modells zu reduzieren und gleichzeitig die Ausgabequalität beizubehalten.

Kam zurück zu einem Projekt, an dem ich gearbeitet habe Beim Arbeiten mit der OpenAI GPT-4-API ist mir aufgefallen, dass die API-Antwortzeiten ziemlich langsam waren.

Getestete durchschnittliche Antwort in einem neuen Kontext für „Können Sie mir ein einfaches Scatter-Matplotlib-Beispiel zeigen?“

GPT-3,5: 13,4 Sekunden

GPT-4: 44,7 Sekunden.

⏱️🦥🐢 – Harrison Kinsley (@Sentdex) 10. Mai , 2023

Ein großer Teil der OpenAI-Einnahmen kommt von Unternehmen und Betrieben, also muss GPT-5 nicht nur billiger sein, sondern auch schneller Ergebnisse liefern. Entwickler beschimpfen bereits die Tatsache, dass GPT-4-API-Aufrufe häufig nicht mehr reagieren und sie gezwungen sind, das GPT-3.5-Modell in der Produktion zu verwenden. Es muss auf der Wunschliste von OpenAI stehen, die Leistung im kommenden GPT-5-Modell zu verbessern, insbesondere nach der Einführung von Googles viel schnellerem PaLM 2-Modell, das Sie jetzt ausprobieren können.

Multisensorisches KI-Modell

Obwohl GPT-4 als multimodales KI-Modell angekündigt wurde, verarbeitet es nur zwei Arten von Daten, nämlich Bilder und Texte. Natürlich wurde die Funktion noch nicht zu GPT-4 hinzugefügt, aber OpenAI könnte die Funktion möglicherweise in ein paar Monaten veröffentlichen. Mit GPT-5 könnte OpenAI jedoch einen großen Schritt machen, um es wirklich multimodal zu machen. Es kann auch Text, Audio, Bilder, Videos, Tiefendaten und Temperatur verarbeiten. Es wäre in der Lage, Datenströme verschiedener Modalitäten miteinander zu verknüpfen, um einen Einbettungsraum zu schaffen.

Quelle: Meta

Meta wurde kürzlich veröffentlicht ImageBind, ein KI-Modell, das Daten aus sechs verschiedenen Modalitäten kombiniert und für Forschungszwecke als Open-Source-Lösung bereitstellt. In diesem Bereich hat OpenAI nicht viel verraten, aber das Unternehmen verfügt über einige starke Basismodelle für die Visionsanalyse und Bildgenerierung. OpenAI hat außerdem CLIP (Contrastive Language–Image Pretraining) für die Analyse von Bildern und DALL-E entwickelt, eine beliebte Midjourney-Alternative, die Bilder aus Textbeschreibungen generieren kann.

Es ist ein Bereich der laufenden Forschung und seine Anwendungen sind noch nicht klar. Laut Meta können damit immersive Inhalte für die virtuelle Realität entworfen und erstellt werden. Wir müssen abwarten, was OpenAI in diesem Bereich leistet und ob wir mit der Veröffentlichung von GPT-5 mehr KI-Anwendungen in verschiedenen Multimodalitäten sehen werden.

Langzeitgedächtnis

Mit dem Mit der Veröffentlichung von GPT-4 brachte OpenAI eine maximale Kontextlänge von 32.000 Token mit sich, was 0,06 $ pro 1.000 Token kostete. Wir haben innerhalb weniger Monate den schnellen Wandel von den standardmäßigen 4K-Tokens zu 32K-Tokens erlebt. Vor kurzem hat Anthropic das Kontextfenster in seinem Claude AI-Chatbot von 9.000 auf 100.000 Token erhöht. Es wird erwartet, dass GPT-5 über eine viel größere Kontextlänge Unterstützung für das Langzeitgedächtnis bieten könnte.

Dies kann dabei helfen, KI-Charaktere und Freunde zu schaffen, die sich an Ihre Persönlichkeit und Erinnerungen erinnern, die jahrelang anhalten können. Darüber hinaus können Sie Bibliotheken mit Büchern und Textdokumenten in einem einzigen Kontextfenster laden. Aufgrund der Unterstützung des Langzeitgedächtnisses kann es verschiedene neue KI-Anwendungen geben, und GPT-5 kann dies ermöglichen.

GPT-5-Veröffentlichung: Angst vor AGI?

Im Februar 2023 schrieb Sam Altman einen Blog über AGI und wie es der gesamten Menschheit zugute kommen kann. AGI (Künstliche Allgemeine Intelligenz) ist, wie der Name schon sagt, die nächste Generation von KI-Systemen, die im Allgemeinen intelligenter als Menschen sind. Es wird gesagt, dass das kommende Modell GPT-5 von OpenAI AGI erreichen wird, und es scheint, dass daran etwas Wahres dran ist.

Wir haben bereits mehrere autonome KI-Agenten wie Auto-GPT und BabyAGI basiert auf GPT-4 und kann selbstständig Entscheidungen treffen und vernünftige Schlussfolgerungen ziehen. Es ist durchaus möglich, dass eine Version von AGI mit GPT-5 bereitgestellt wird.

Im Blog sagt Altman: „Wir glauben, dass wir kontinuierlich lernen und uns anpassen müssen, indem wir weniger leistungsstarke Versionen der Technologie einsetzen, um „One Shot to Get It Right“-Szenarien zu minimieren.“ >erkennt „massive Risiken“ beim Navigieren in äußerst leistungsstarken Systemen wie AGI an. Vor der jüngsten Anhörung im Senat Sam Altman forderte außerdem den US-Gesetzgeber auf, Vorschriften für neuere KI-Systeme einzuführen.

In der Anhörung sagte Altman: „Ich denke, wenn diese Technologie schief geht, kann sie ziemlich schief gehen. Und dazu wollen wir uns lautstark äußern.“ Darüber hinaus fügte er hinzu: „Wir wollen mit der Regierung zusammenarbeiten, um das zu verhindern.“ Seit einiger Zeit äußert sich OpenAI lautstark zu Vorschriften für neuere KI-Systeme, die äußerst leistungsfähig und intelligent sein sollen. Beachten Sie, dass Altman Sicherheitsvorschriften für unglaublich leistungsstarke KI-Systeme anstrebt und nicht für Open-Source-Modelle oder KI-Modelle, die von kleinen Startups entwickelt wurden.

Regulierung sollte oberhalb einer Fähigkeitsschwelle wirksam werden.

AGI-Sicherheit ist wirklich wichtig, und Grenzmodelle sollten reguliert werden.

Regulierungserfassung ist schlecht , und wir sollten uns nicht mit Modellen unterhalb der Schwelle anlegen. Offensichtlich sind Open-Source-Modelle und kleine Startups wichtig. https://t.co/qdWHHFjX4s – Sam Altman (@sama) 18. Mai 2023

Es sollte erwähnenswert sein, dass Elon Musk und andere prominente Persönlichkeiten, darunter Steve Wozniak, Andrew Yang, Yuval Noah Harari und andere, forderten einen Pause bei riesigen KI-Experimenten, im März 2023. Seitdem gab es großen Widerstand gegen AGI und neuere KI-Systeme – leistungsfähiger als GPT-4.

Wenn OpenAI tatsächlich die AGI-Fähigkeit in GPT-5 einbringen wird, müssen Sie mit einer weiteren Verzögerung bei der öffentlichen Veröffentlichung rechnen. Die Regulierung würde definitiv in Kraft treten und die Arbeiten rund um Sicherheit und Ausrichtung würden gründlich geprüft. Das Gute daran ist, dass OpenAI bereits über ein leistungsstarkes GPT-4-Modell verfügt und kontinuierlich neue Funktionen und Fähigkeiten hinzufügt. Es gibt kein anderes KI-Modell, das dem nahe kommt, nicht einmal das auf PaLM 2 basierende Google Bard.

OpenAI GPT-5: Zukünftige Haltung

Nach der Veröffentlichung von GPT-4 ist OpenAI zunehmend geheimnisvoll mit seinen Aktivitäten umgegangen. Forschungsergebnisse zu Trainingsdatensatz, Architektur, Hardware, Trainingsberechnung und Trainingsmethode werden nicht mehr mit der Open-Source-Community geteilt. Es war ein seltsamer Wendepunkt für ein Unternehmen, das als gemeinnützige Organisation (jetzt mit begrenztem Gewinn) auf der Grundlage der Prinzipien der freien Zusammenarbeit gegründet wurde.

Im März 2023 im Gespräch mit The Verge, Ilya Sutskever, der Chefwissenschaftler von OpenAI, sagte: „Wir haben uns geirrt. Ganz klar, wir haben uns geirrt. Wenn Sie wie wir glauben, dass KI – AGI – irgendwann extrem, unglaublich leistungsfähig sein wird, dann macht es einfach keinen Sinn, Open Source zu veröffentlichen. Das ist eine schlechte Idee … Ich gehe davon aus, dass in ein paar Jahren jedem völlig klar sein wird, dass Open-Sourcing-KI einfach nicht klug ist.“

Jetzt ist klar geworden, dass GPT auch nicht-4 noch das kommende GPT-5 wären Open Source, um im KI-Wettbewerb wettbewerbsfähig zu bleiben. Ein anderes Riesenunternehmen, Meta, geht die KI-Entwicklung jedoch anders an. Meta hat mehrere KI-Modelle unter der CC BY-NC 4.0-Lizenz veröffentlicht (nur für Forschungszwecke, nicht kommerziell) und gewinnt in der Open-Source-Community an Bedeutung.

Angesichts der großen Akzeptanz von Metas LLaMA und anderen KI-Modellen hat OpenAI auch seine Haltung zu Open Source geändert. Laut aktuellen Berichten , OpenAI arbeitet an einem neuen Open-Source-KI-Modell, das bald der Öffentlichkeit zugänglich gemacht wird. Es gibt keine Informationen über seine Fähigkeiten und wie konkurrenzfähig es gegenüber GPT-3.5 oder GPT-4 sein wird, aber es ist in der Tat eine willkommene Abwechslung.

Zusammenfassend lässt sich sagen, dass GPT-5 ein Grenzmodell sein wird, das die Grenzen dessen, was mit KI möglich ist, verschieben wird. Es ist wahrscheinlich, dass mit GPT-5 irgendeine Form von AGI eingeführt wird. Und wenn das der Fall sein sollte, muss sich OpenAI auf eine strenge Regulierung (und mögliche Verbote) auf der ganzen Welt einstellen. Was das Veröffentlichungsdatum von GPT-5 angeht, wäre die sichere Wette irgendwann im Jahr 2024.

Kommentar hinterlassen

Es gibt einige fragwürdige Designentscheidungen in Redfall, einem Mischmasch der unausgegorenen, berühmten Arkane-Formel. Ich liebe Spiele von Arkane Studios, wobei Dishonored zu einem Titel geworden ist, den ich hin und wieder wegen seines einzigartigen, aufstrebenden Gameplays wieder aufrufe. Und […]

Der BenQ PD2706UA-Monitor ist da, und er verfügt über alle Schnickschnack, die Produktivitätsnutzer zu schätzen wissen. 4K-Auflösung, werkseitig kalibrierte Farben, ein 27-Zoll-Panel, ein ergonomischer Standfuß, der sich leicht verstellen lässt und mehr. Es hat viele […]

Minecraft Legends ist ein Spiel, das bei seiner ersten Enthüllung letztes Jahr mein Interesse geweckt hat. Aber ich gebe zu, dass ich das Spiel erst dann aktiv verfolgt habe, als wir seiner offiziellen Veröffentlichung näher kamen. Immerhin meine Liebe […]