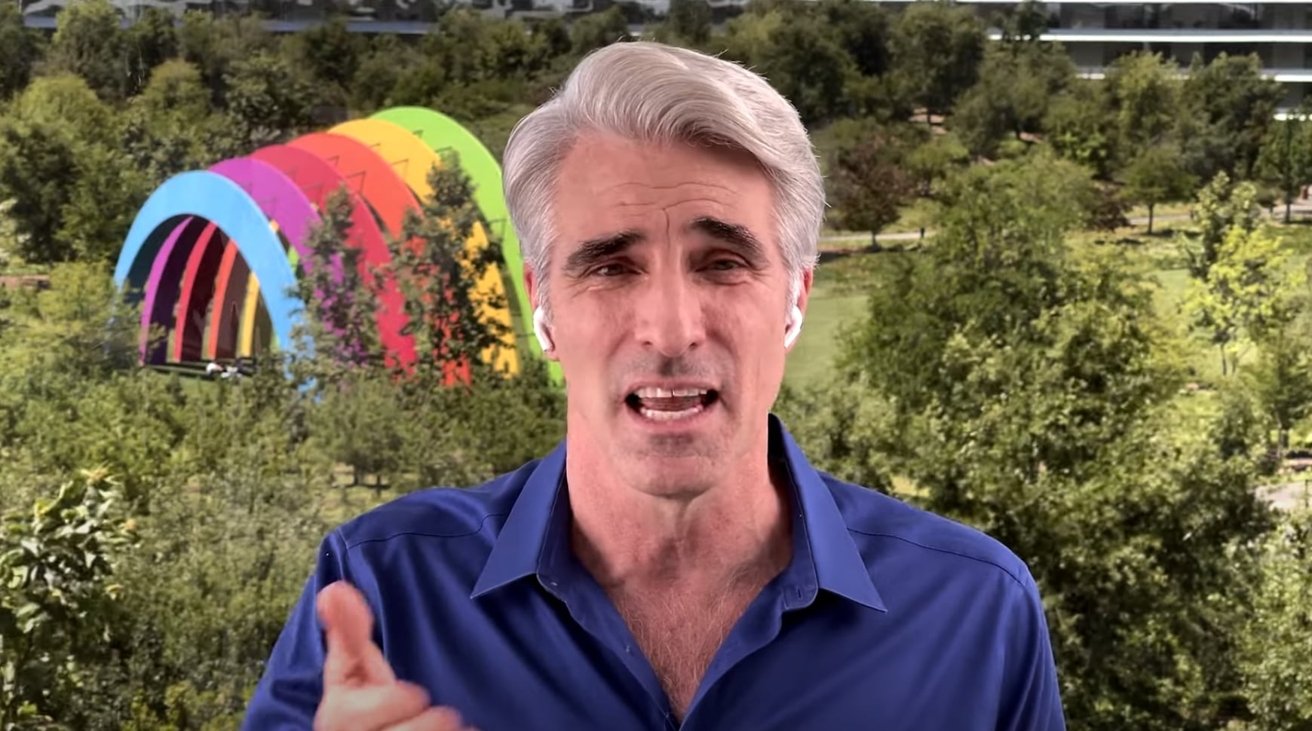

La continua tradición del vicepresidente senior de ingeniería de software de Apple Craig Federighi y el vicepresidente de marketing de productos Greg Joswiak, sentado con John Gruber, continúa en 2021, con discusiones sobre lo que Apple lanzó durante la WWDC 2021, la privacidad, el procesamiento Siri en el dispositivo y la creación de Universal Control.

En una edición especial de”The Talk Show”de Daring Fireball , la conversión se realiza de forma remota, con Federighi y Joswiak ubicados en Apple Park . Si bien otras entrevistas están muy controladas, la larga entrevista con los ejecutivos tiene una estructura considerablemente más flexible y mucho más larga, lo que permite a la pareja entusiasmarse con las características y el desarrollo anunciados.

Subido a YouTube el viernes, el programa de una hora y media tiene a dos ejecutivos que cubren muchos elementos diferentes que se mencionaron durante la conferencia magistral y durante todo el Semana de la WWDC .

Privacidad

El primer tema que se trató fue la privacidad, que es un punto focal importante para el trabajo de Apple. Después de mencionar cómo Apple ha pasado décadas anteponiendo el diseño y demostrando que tiene buenas ventas a los consumidores, mientras que el resto de la industria no tenía el mismo enfoque, Gruber pregunta si el impulso de la privacidad de Apple por delante del resto de la industria es el mismo tipo de cosas.

Según Greg Joswiak al plantear las observaciones sugeridas anteriormente,”[Apple] ha estado diciendo durante bastante tiempo que la privacidad es un derecho humano fundamental, y lo hemos estado incorporando en nuestros productos, lo hemos estado diseñando en nuestras arquitecturas durante mucho tiempo antes de que fuera popular, porque era lo correcto”.

Continuó”Esto no era algo que nosotros, ya sabes, cinta adhesiva lateral. Esto está profundamente entretejido en nuestros sistemas y arquitecturas, y ahora que la privacidad resulta ser más importante para los clientes, bueno, eso es genial. Quiero decir, alentamos eso. Los clientes deben preocuparse por su privacidad, pero esto es algo para nosotros que es mucho más grande que tratando de ser popular”.

Siri en el dispositivo

Realizar el procesamiento de Siri en el dispositivo es más que una función de privacidad, ya que el asistente digital de Apple que utiliza el procesamiento integrado proporciona velocidad y otros beneficios sobre sistemas de procesamiento existentes.

“La velocidad es asombrosa”, comienza Federighi.”Todos vivimos de ello, obviamente, y es extraordinario. Sí, no solo no tiene que preocuparse si está en la red para ese tipo de solicitudes, sino que la capacidad de respuesta es una gran victoria”.

“Y eso es generalmente cierto con el aprendizaje automático en el dispositivo”, agrega Federighi.”No quieres lidiar con mi red defectuosa, cómo está mi conexión en este momento, quieres que funcione donde sea. Estos son dispositivos móviles, ¿verdad? Quieres que funcionen bien donde sea que estés, y conseguir que Siri sea local de esta manera es fantástico para la experiencia del usuario”.

Federighi menciona cómo en los últimos dos años”si escuchas el texto neuronal de Siri para hablar como este, increíblemente alto voz de calidad. Hace un par de años me sentí como en la luna hacer eso localmente. No tener que enviar lo que querías decir a un servidor para sintetizarlo a ese nivel de calidad”.

Pasar al uso del procesamiento en el dispositivo para manejar el front-end de una solicitud ha”sido solo una avance increíble en el último año. Por lo tanto, es realmente emocionante adónde vamos con el aprendizaje en el dispositivo”.

Control universal

En discusiones sobre iPadOS 15 , la característica destacada de Se planteó Universal Control , que permite que el teclado y el mouse de una Mac controlen un iPad cercano y manejen el movimiento de archivos entre dispositivos de la manera más fluida posible.

Sobre el tema de la duración de su desarrollo, Federighi comienza ofreciendo”Creo que es uno de esos cosas en las que, hasta cierto punto, hemos estado trabajando en ello durante 10 años, porque los cimientos que hemos estado construyendo, sobre los que está construido, todas esas piezas, muchos hilos se unieron para luego finalmente realizar esa experiencia”.

Federighi continuó”Con todas las experiencias de Continuity, el hecho de que nuestros dispositivos generalmente inician sesión en su cuenta, sabe el uno del otro, que a través de Bluetooth de baja energía pueden comunicarse entre sí. El hecho de que con el Wi-Fi de igual a igual podemos establecer rápidamente un enlace de Wi-Fi de alta velocidad entre sus dispositivos. Ya sabe, este es algo que hicimos para AirDrop hace años, y lo teníamos como base”.

“Pero entonces necesitas que el iPad, por supuesto, sea compatible con un trackpad para que esto sea significativo , correcto, eso preparó el escenario. Una vez que tuvimos todas esas piezas, sabíamos que queríamos que fuera una experiencia de configuración cero, correcto, que si ibas a hacer algo como esto, si había esta fricción donde déjame abrir las Preferencias del sistema y exponer mis cosas’ya sabes, entonces probablemente no lo vas a hacer la mayor parte del tiempo”.

Apple evaluó”muchas ideas locas”sobre el uso de ultrasonidos para localizar dónde estaban los dispositivos, pero fue un”salto intuitivo”según el SVP para darse cuenta de que el usuario sabe dónde están los otros dispositivos entre sí.”Vas a mover el cursor hacia el iPad. Nos estás diciendo algo cuando haces eso. ¿Podemos aprovechar eso e ir de acuerdo? Y luego darte esta indicación que dice que creemos que podrías estar intentando hacer ¿Este eres tu?’y aproveche el lenguaje visual que construimos en iPad para reflejar eso y hacer una forma realmente natural de decir, como, pruébelo.

Para Federighi, esto resulta en algo que parece”la forma más natural de realizar la operación en la primera lugar.”