Apple ha rilasciato una serie di nuove funzionalità di accessibilità per iOS e iPadOS. Il gigante di Cupertino sta raddoppiando il suo impegno per rendere la”tecnologia accessibile a tutti”con questo aggiornamento. I nuovi miglioramenti dell’accessibilità, tra cui l’accessibilità cognitiva, Live Speech e altro ancora, trarranno vantaggio dall’hardware integrato dei dispositivi e dalle capacità di apprendimento automatico. Continua a leggere qui sotto per saperne di più.

Nuove funzionalità di accessibilità per iPhone e iPad

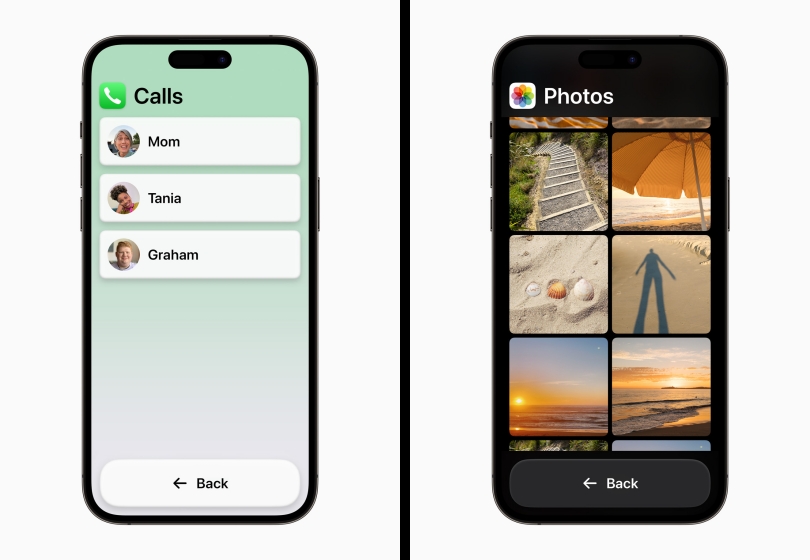

Una delle funzionalità recentemente annunciate è Assistive Access for Cognitive Disability. Come si evince dal nome, gli utenti con complicazioni come l’autismo, l’Alzheimer e così via di solito hanno difficoltà a navigare tra gli elementi sui loro smartphone. Questa funzione declasserà le app e gli elementi del sistema operativo per mantenere intatte solo le funzionalità principali.

Questa funzione funzionerà con il telefono, FaceTime, la fotocamera e altre app di guida quotidiane. Con questa funzione attivata, gli utenti potranno interagire con testo ingrandito e pulsanti ad alto contrasto e solo con le funzionalità che contano. Questo si basa sui dati e sul feedback raccolti da sostenitori fidati e persone con disturbi cognitivi.

Funzione di accessibilità assistita

Funzione di accessibilità assistita

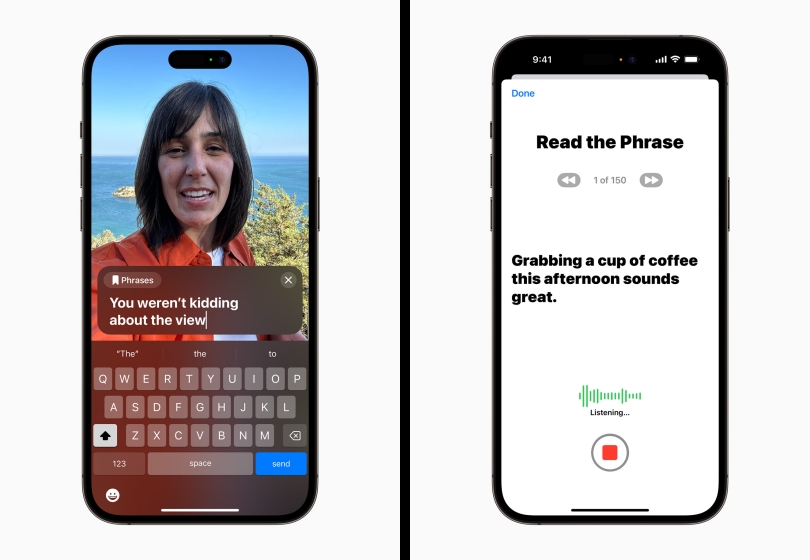

Un’altra nuova funzione è Live Speech and Personal Voice, che ha lo scopo di rendere la tecnologia accessibile a persone con problemi di voce come la SLA. La funzione Live Speech consentirà agli utenti di digitare le loro parole e quindi lasciare che il loro iPhone o iPad le dica ad alta voce. Questa funzione sarà utile sia durante le conversazioni di persona che durante le conversazioni virtuali.

D’altra parte, la funzione Voce personale è una tacca sopra la funzione Parlato dal vivo. Consente agli utenti con problemi vocali precoci di registrare un’impronta audio della propria voce. Ciò significa che ogni volta che vuoi comunicare con qualcuno e digiti la tua risposta, suonerà con la tua stessa voce piuttosto che con una generica voce robotica. La funzionalità utilizza l’apprendimento automatico sul dispositivo e una serie di prompt predefiniti per creare la tua impronta vocale in modo sicuro e protetto.

Conversazione dal vivo e voce personale

Conversazione dal vivo e voce personale

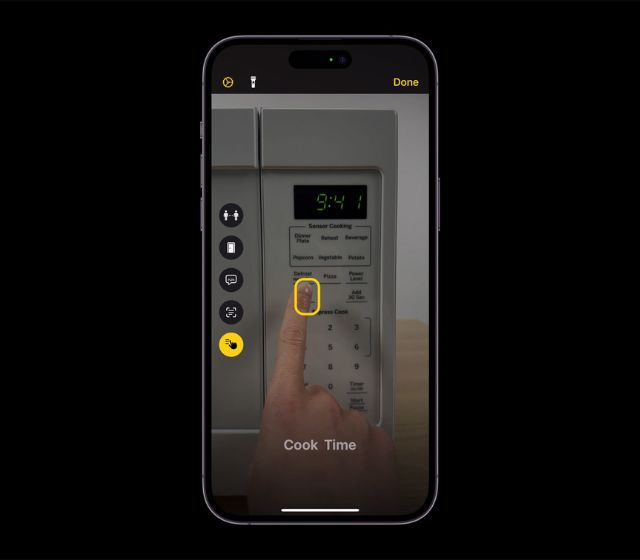

Per gli utenti ipovedenti o che stanno perdendo la capacità di vedi, Apple ha introdotto una funzione di accessibilità denominata Indica e parla per la modalità di rilevamento in Magnifier. Questa funzione consentirà agli utenti di ricevere messaggi audio per elementi con testo al loro interno. Ad esempio, se stai digitando sulla tastiera, a ogni battitura sarà associato un messaggio vocale. Apple è in grado di raggiungere questa impresa combinando il sensore LiDAR sul dispositivo, l’app della fotocamera e le capacità di apprendimento automatico. Utilizzando la funzione di ingrandimento, gli utenti possono ricevere messaggi vocali per qualsiasi elemento di testo selezionato dall’app della fotocamera.

Indica e parla per la modalità di rilevamento nella lente d’ingrandimento

Indica e parla per la modalità di rilevamento nella lente d’ingrandimento

Alcuni degli altri annunci includono apparecchi acustici Made for iPhone per utenti con problemi uditivi, guide al controllo vocale per gli utenti per imparare trucchi e suggerimenti sulle funzioni del controllo vocale e molto altro Di più. Apple inizierà a implementare queste funzionalità di accessibilità per gli utenti di iPhone e iPad entro la fine di quest’anno. Quindi, cosa ne pensi di questi nuovi miglioramenti dell’accessibilità? Pensi che queste funzionalità ti avvantaggeranno in qualche modo? Commenta i tuoi pensieri qui sotto.

FONTE Apple Lascia un commento