Apple heeft deze week een voorproefje gegeven van nieuwe iPhone-, iPad-en Mac-toegankelijkheidsfuncties die later dit jaar beschikbaar komen. Een functie die in het bijzonder veel aandacht heeft gekregen, is Personal Voice, waarmee degenen die het risico lopen hun spraakvermogen te verliezen,”een stem kunnen creëren die klinkt zoals zij”voor communicatie met familie, vrienden en anderen.

>

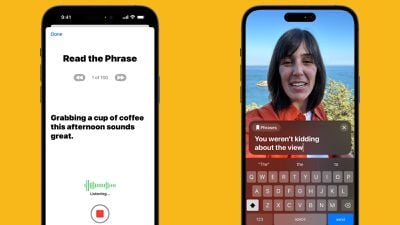

Degenen met een iPhone, iPad of nieuwere Mac kunnen een persoonlijke stem maken door een willekeurige reeks tekstprompts hardop voor te lezen totdat er 15 minuten audio is opgenomen op het apparaat. Apple zei dat de functie bij de lancering alleen in het Engels beschikbaar zal zijn en machine learning op het apparaat gebruikt om privacy en veiligheid te waarborgen.

Personal Voice zal worden geïntegreerd met een andere nieuwe toegankelijkheidsfunctie genaamd Live Speech, waarmee iPhone-, iPad-en Mac-gebruikers typen wat ze willen zeggen, zodat het hardop wordt uitgesproken tijdens telefoongesprekken, FaceTime-gesprekken en persoonlijke gesprekken.

Apple zei dat Personal Voice ontworpen voor gebruikers die het risico lopen hun spraakvermogen te verliezen, zoals gebruikers met een recente diagnose van ALS (amyotrofische laterale sclerose) of andere aandoeningen die het spreekvermogen progressief kunnen beïnvloeden. Net als andere toegankelijkheidsfuncties zal Personal Voice echter beschikbaar zijn voor alle gebruikers. De functie zal waarschijnlijk worden toegevoegd aan de iPhone met iOS 17, die volgende maand wordt onthuld en in september wordt uitgebracht.

“Uiteindelijk is het belangrijkste dat je kunt communiceren met vrienden en familie,”zei Philip Green, die in 2018 de diagnose ALS kreeg en lid is van de ALS-belangenbehartigingsorganisatie Team Gleason.”Als je ze kunt vertellen dat je van ze houdt, met een stem die klinkt zoals jij, maakt dat een heel verschil in de wereld-en het is buitengewoon om in slechts 15 minuten je synthetische stem op je iPhone te kunnen creëren.”