Obecnie na rynku jest wielu graczy AI, w tym ChatGPT, Google Bard, Bing AI Chat i wiele innych. Jednak wszystkie z nich wymagają połączenia z Internetem w celu interakcji z AI. Co zrobić, jeśli chcesz zainstalować podobny model dużego języka (LLM) na swoim komputerze i używać go lokalnie? Chatbot AI, którego możesz używać prywatnie i bez połączenia z Internetem. Cóż, z nowym modelem Alpaca wydanym przez Stanford możesz się do tego zbliżyć do tej rzeczywistości. Tak, możesz uruchomić model językowy podobny do ChatGPT na swoim komputerze w trybie offline. Więc w tej notatce, chodźmy dalej i nauczmy się, jak korzystać z LLM lokalnie bez Internetu.

Uruchom LLM podobny do ChatGPT lokalnie bez Internetu (prywatny i bezpieczny)

W tym artykule wspomniałem wszystko o tym, jak uruchomić LLM podobny do ChatGPT na lokalnym komputerze bez Internet. Możesz rozwinąć poniższą tabelę i zapoznać się ze szczegółowymi krokami.

Spis treści

Co to jest Alpaka i LLaMA?

Alpaka to mały model języka sztucznej inteligencji opracowany przez grupę informatyków z Uniwersytetu Stanforda. Wyjątkową cechą Alpaca jest to, że jest mała i opłacalna. Z zaledwie 7 miliardami parametrów Alpaca jest tak dobra, jak model text-davinci-003 OpenAI. I możesz uruchomić go na komputerze lokalnym bez konieczności połączenia z Internetem. To całkiem fajne, prawda?

Obraz: Stanford.edu

Obraz: Stanford.edu

Ale jak to było szkolone? Co zaskakujące, Alpaca jest dopracowana pod kątem LLaMa, dużego modelu językowego Meta, który ostatnio wyciekł do sieci. Aby wytrenować ten model językowy, naukowcy wykorzystali model „text-davinci-003” OpenAI do wygenerowania 52 000 wysokiej jakości danych do samodzielnej nauki. Dzięki temu zbiorowi danych dopracowali model LLaMA za pomocą ram szkoleniowych HuggingFace i wypuścili Alpaca 7B. Możesz także użyć modelu LLaMA Meta, ale w moich testach Alpaca LLM Stanforda działała znacznie lepiej i jest również dość szybka.

Jaki sprzęt jest potrzebny do uruchomienia Alpaca?

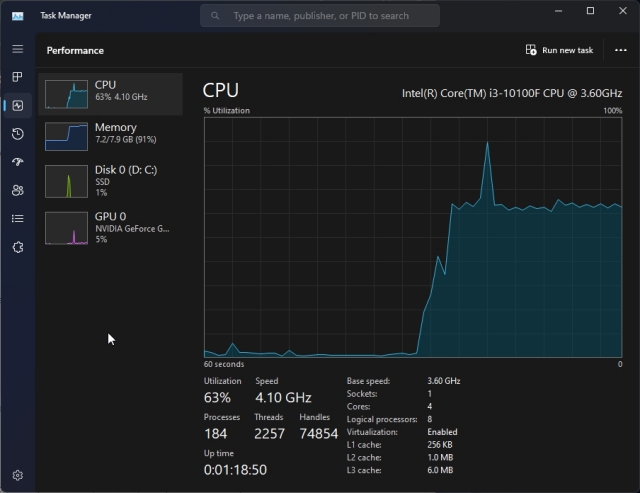

Możesz używać Alpaca 7B na dowolnej przyzwoitej maszynie. Zainstalowałem Alpaca 7B na moim podstawowym komputerze i działało całkiem dobrze. Aby dać ci pojęcie, mój komputer jest wyposażony w procesor Intel i3 10. generacji z 256 GB dysku SSD i 8 GB pamięci RAM. Jeśli chodzi o GPU, używam podstawowej karty graficznej GeForce GT 730 firmy Nvidia z 2 GB pamięci VRAM.

alpaca-lora (7b) を Raspberry pi cm4 で 動かし て み まし た ^^)/とても ゆっくり です が 、 この 小さな 筐体 で 話し て くれる の は 、 とても 可愛い 可愛い ね ね😍 #LLM #IoT pic.twitter.com/SyP3HZhMYX — Mitsunori SATOMI@VR 30. rocznica (@gravitino) marzec 20 lutego 2023 r.

Nawet bez dedykowanego procesora graficznego możesz uruchomić Alpaca lokalnie. Czas reakcji będzie jednak długi. Poza tym są użytkownicy, którym udało się uruchomić Alpaca nawet na małym komputerze, takim jak Raspberry Pi 4. Można więc wywnioskować, że model języka Alpaca może równie dobrze działać na komputerach klasy podstawowej.

Skonfiguruj środowisko oprogramowania do uruchamiania Alpaca i LLaMA

Windows

W systemie Windows musisz zainstalować Pythona, Node.js i C++, aby rozpocząć z użyciem dużego modelu językowego w trybie offline na komputerze. Oto jak się do tego zabrać.

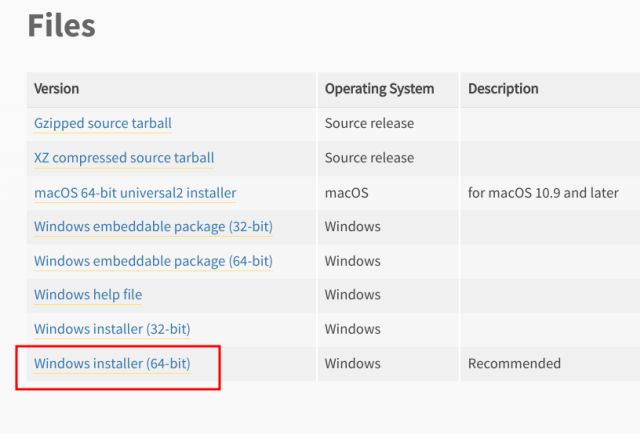

1. Najpierw pobierz Python 3.10 (lub starszy) z tutaj. Przewiń w dół i kliknij „Instalator Windows (64-bitowy)”, aby pobrać plik instalacyjny.

2. Uruchom plik instalacyjny i zaznacz pole wyboru obok „Dodaj Python.exe do PATH”. Teraz zainstaluj Pythona ze wszystkimi ustawieniami domyślnymi.

3. Następnie zainstaluj Node.js w wersji 18.0 (lub nowszej) z tutaj. Zachowaj ustawienia domyślne podczas instalacji programu.

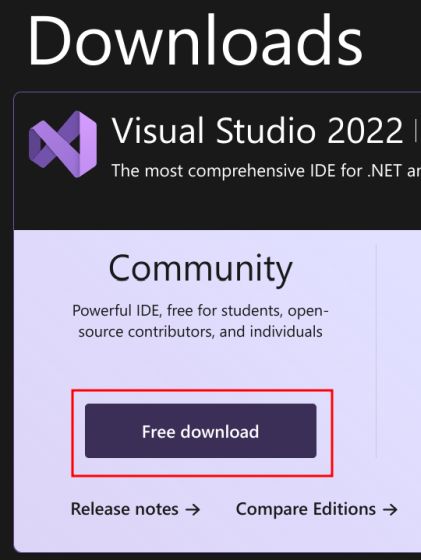

4. Na koniec pobierz bezpłatnie wersję Visual Studio „Community” z tego łącza.

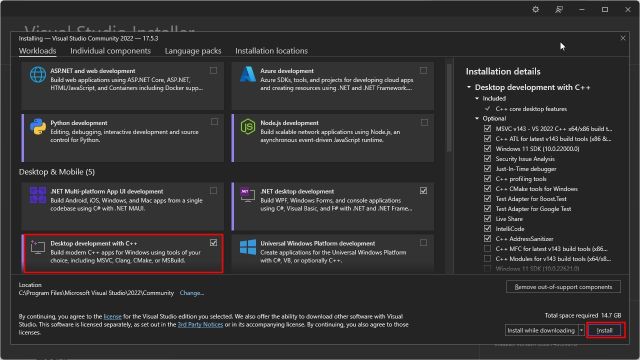

5. Uruchom plik instalacyjny programu Visual Studio 2022, który początkowo pobierze niektóre pliki. Następnie uruchomi się nowe okno. Tutaj upewnij się, że opcja „Desktop development with C++” jest włączona.

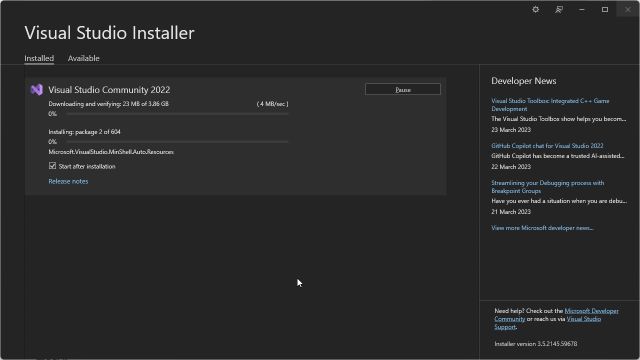

6. Na koniec kliknij „Zainstaluj” i poczekaj, aż instalacja się zakończy.

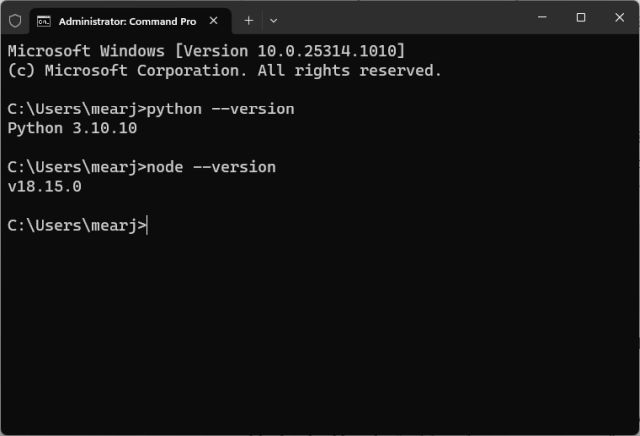

7. Zalecam ponowne uruchomienie komputera po zainstalowaniu wszystkiego. Następnie otwórz „Wiersz polecenia” i uruchom poniższe polecenia, aby sprawdzić, czy Python i Node.js zostały pomyślnie zainstalowane. Oba powinny zwrócić numer wersji. Możesz już zaczynać.

python–version node–version

Apple macOS

Python jest zazwyczaj preinstalowany w systemie macOS, więc wystarczy zainstalować Node.js (wersja 18.0 lub nowsza). Oto jak możesz to zrobić:

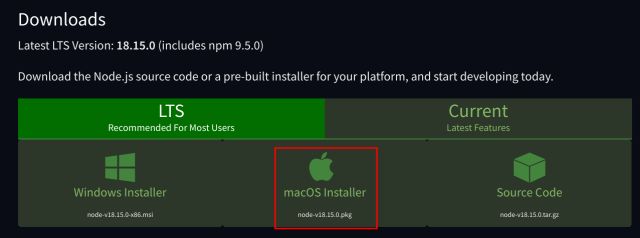

1. Pobierz instalator Node.js macOS (wersja 18.0 lub nowsza) z linku tutaj.

2. Następnie otwórz Terminal i uruchom poniższe polecenie, aby sprawdzić, czy Node.js jest poprawnie zainstalowany. Jeśli w zamian otrzymasz numer wersji, możesz zaczynać.

węzeł–version

3. Następnie sprawdź wersję Pythona, uruchamiając poniższe polecenie. Powinien to być Python 3.10 lub starszy.

python3–wersja

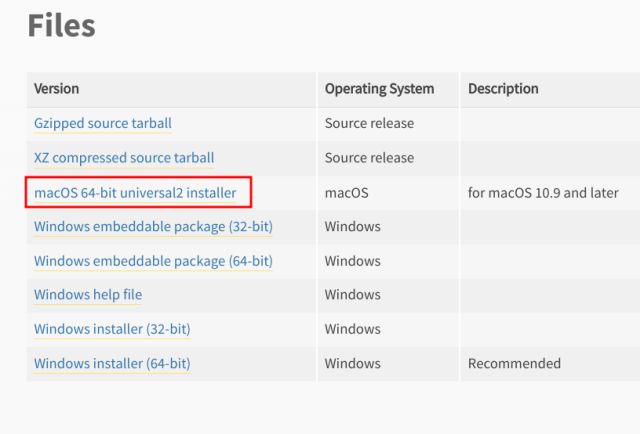

4. Jeśli nie otrzymujesz danych wyjściowych lub masz najnowszą wersję Pythona, pobierz Pythona 3.10 (lub starszego) z tutaj. Przewiń w dół i kliknij „uniwersalny2 instalator 64-bitowego systemu macOS”, aby pobrać Pythona. Teraz zainstaluj ją na komputerze Mac.

Linux i ChromeOS

W systemach Linux i ChromeOS musisz skonfigurować Pythona i Node.js przed uruchomieniem w trybie offline Modele alpaki i LLaMA. Oto kroki, które należy wykonać.

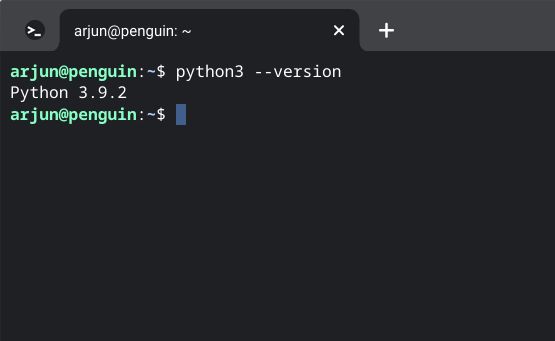

1. Otwórz terminal i uruchom poniższe polecenie, aby sprawdzić wersję Pythona. Jeśli jest to Python 3.10 lub starszy, wszystko gotowe.

python3–version

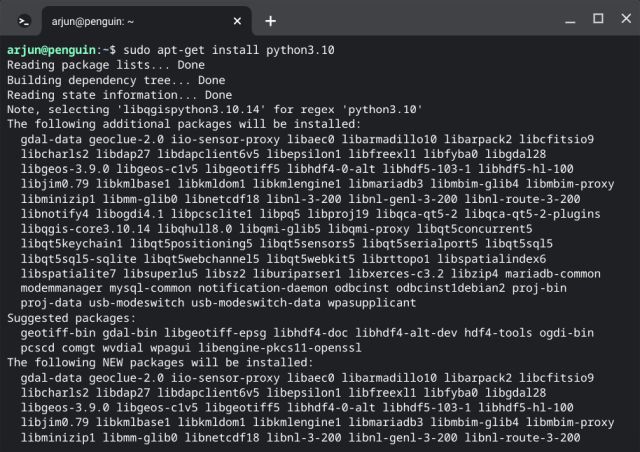

2. Jeśli masz wyższą wersję, możesz użyć poniższych poleceń, aby zainstalować Pythona 3.10 w systemach Linux i Chrome OS.

sudo apt install software-properties-common sudo add-apt-repository ppa:deadsnakes/ppa sudo apt-get update sudo apt-get install python3.10

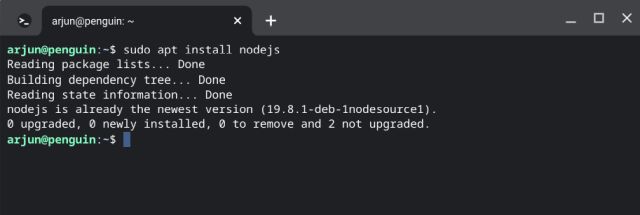

3. Po Pythonie zainstaluj Node.js, uruchamiając poniższe polecenie.

sudo apt install nodejs

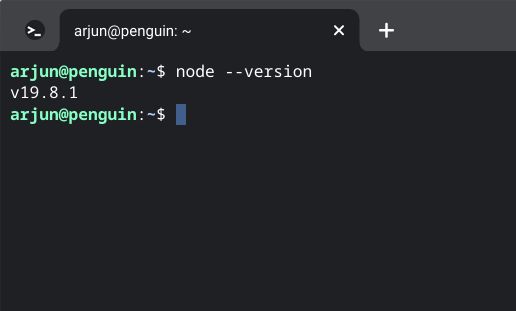

4. Po instalacji uruchom poniższe polecenie, aby sprawdzić wersję Node.js. Powinien mieć wartość 18,0 lub wyższą.

node–version

Zainstaluj modele Alpaca i LLaMA na swoim komputerze

Po skonfigurowaniu Pythona i Node.js, nadszedł czas, aby zainstalować i uruchomić LLM podobny do ChatGPT na swoim komputerze. Zanim przejdziesz dalej, upewnij się, że Terminal wykrywa polecenia Pythona i węzła.

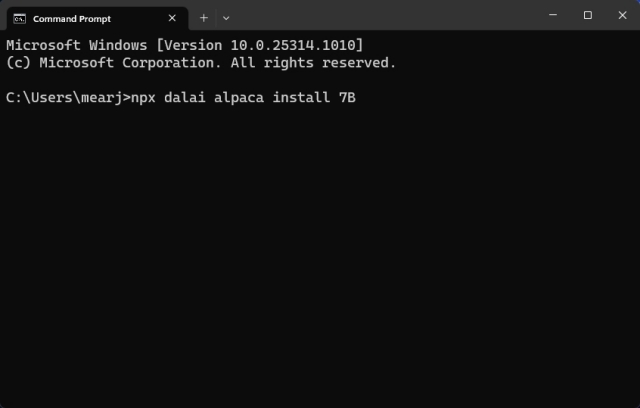

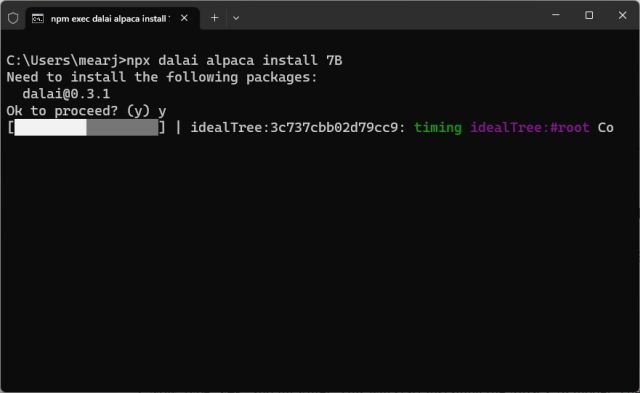

1. Otwórz terminal (w moim przypadku wiersz polecenia) i uruchom poniższe polecenie, aby zainstalować model Alpaca 7B LLM (wymagane około 4,2 GB miejsca na dysku). Jeśli chcesz zainstalować model Alpaca 13B, zamień 7B na 13B. Większy model potrzebuje 8,1 GB miejsca.

npx Dalai alpaca install 7B

2. Teraz wpisz „y” i naciśnij Enter. Spowoduje to rozpoczęcie instalacji modelu Alpaca 7B. Cały proces zajmie od 20 do 30 minut, w zależności od połączenia internetowego i rozmiaru modelu.

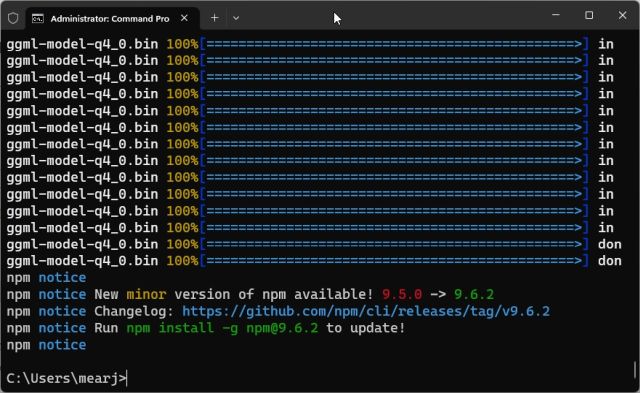

3. Po zakończeniu instalacji zobaczysz ekran podobny do tego.

4. Możesz również zainstalować modele LLaMA lub przejść do następnego kroku, aby natychmiast przetestować model Alpaki. Pamiętaj, że LLaMA jest znacznie większy. Jego model 7B zajmuje do 31 GB miejsca. Aby go zainstalować, uruchom poniższe polecenie. Możesz zamienić 7B na 13B, 30B i 65B. Największy model zajmuje do 432 GB miejsca.

npx dalai lama install 7B

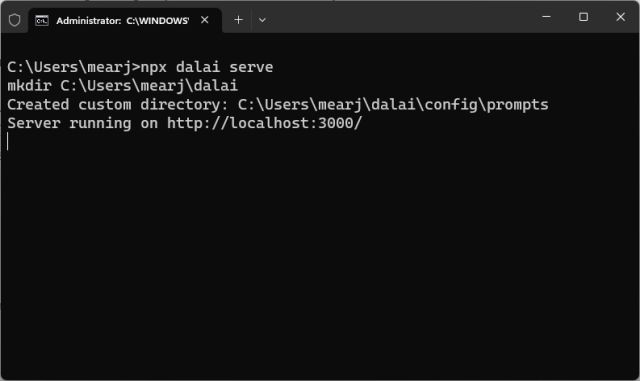

5. Na koniec uruchom poniższe polecenie, które natychmiast uruchomi serwer WWW.

obsługa npx

6. Użyj przeglądarki internetowej na swoim komputerze i otwórz poniższy adres. Spowoduje to przejście do internetowego interfejsu użytkownika, w którym można przetestować modele Alpaca i LLaMA lokalnie i bez Internetu.

http://localhost:3000

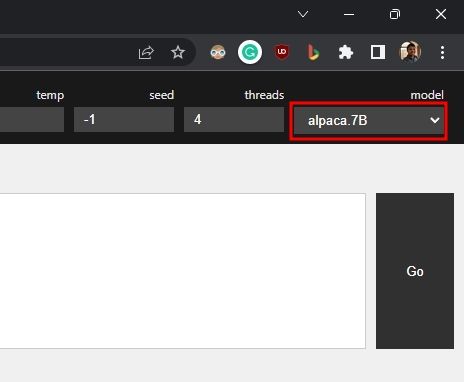

7. Tutaj musisz wybrać model „Alpaca 7B” lub „LLaMA 7B” z rozwijanego menu „model” w prawym górnym rogu. Ponieważ zainstalowałem tylko model Alpaca 7B, jest to mój domyślny.

8. Możesz teraz zacząć używać tego modelu językowego podobnego do ChatGPT na swoim komputerze bez połączenia z Internetem. Zastąp „PROMPT” swoim zapytaniem i kliknij „Go”.

9. Oto jak wygląda wykorzystanie zasobów podczas uruchamiania lokalnego serwera Alpaca LLM na moim komputerze z systemem Windows.

10. Jeśli chcesz usunąć pobrane modele, aby zwolnić miejsce na dysku, otwórz katalog profilu użytkownika. Tutaj folder „dalai” zawiera wszystkie pliki, w tym model. Usunięcie folderu „dalai” natychmiast zwolni miejsce.

Użyj usługa podobna do ChatGPT prywatnie i całkowicie offline

W ten sposób możesz uruchomić LLM podobny do ChatGPT na swoim lokalnym komputerze i uzyskać przyzwoite wyniki. W miarę upływu czasu w przyszłości dostępne będą nowe i wysoce wydajne modele LLM, które można uruchamiać na smartfonach i komputerach typu small-board, takich jak Raspberry Pi. W każdym razie to wszystko od nas. Jeśli chcesz korzystać z ChatGPT 4 za darmo, przejdź do naszego powiązanego artykułu, aby znaleźć niesamowite zasoby. A jeśli chcesz wyszkolić chatbota AI na podstawie własnych dokumentów, mamy dla Ciebie gotowy szczegółowy przewodnik. Na koniec, jeśli napotkasz jakiekolwiek problemy, daj nam znać w sekcji komentarzy poniżej.

Zostaw komentarz

W zeszłym roku firma MSI wprowadziła Titan GT77 z procesorem Intel Core i9-12900HX i kartą graficzną RTX 3080 Ti do laptopów, który był najpotężniejszym laptopem do gier na świecie. To był najcięższy z ciężkich hitów […]

Minęło kilka miesięcy od premiery serii iPhone 14 i dobrze wiadomo, że jest to rok modeli Pro. Ale jeśli zamierzasz wybrać plisowane Pro, kwota do wyrzucenia […]

Wondershare od kilku lat opracowuje jedne z najlepszych programów i narzędzi, które upraszczają nasze życie i twórcze wysiłki. W szczególności Wondershare Filmora otrzymał liczne wyróżnienia. Był laureatem nagrody Lidera Edycji Wideo […]