Ang Microsoft ay ilulunsad isang update sa ChatGPT-powered Bing chatbot nito na lumilikha ng mas kaunting mga pagtanggi at binabawasan ang paghiwalay.

Ang Microsoft Bing ay kasalukuyang tumatakbo sa GPT-4, na siyang pinakamakapangyarihang modelo ng wika na binuo ng OpenAI. Gayunpaman, minsan tumatanggi ang chatbot na sagutin ang mga partikular na tanong, na nakakadismaya sa mga user. Ang pinakabagong update ng Microsoft, na kilala bilang Bing Chat v98, ay gustong tugunan ang isyu.

Ayon kay Mikhail Parakhin, ang pinuno ng Advertising at Web Services ng Microsoft, ang pag-update ng Bing Chat v98 ay magkakabisa sa dalawang yugto. Binabawasan ng unang yugto ang bilang ng mga kaso kapag tumanggi si Bing na magbigay ng sagot para sa isang query, tulad ng pagsusulat ng code. Ang ikalawang yugto ay magbabawas din ng pagkakahiwalay.

Microsoft Ang Bing chatbot ay mayroon na ngayong mas kaunting mga pagtanggi at nabawasan ang pagtanggal

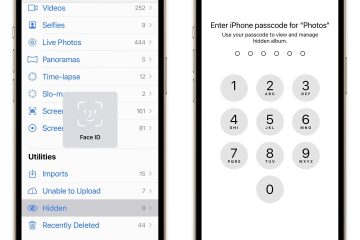

Minsan ang AI chatbots ay tumatangging tumulong dahil maaari nilang matukoy ang tanong bilang sensitibo. Maraming kaso ng racist, bias, o sekswal na sagot ng mga chatbot na ito. Nilalayon ng Bing Chat v98 na bawasan ang mga pagtanggi na ito habang tinitiyak na ang mga sagot ay hindi problema.

Layunin din ng Microsoft Bing chatbot na makipag-ugnayan nang higit pa sa mga user. Ang mga instance ng paghihiwalay ay hindi pa matutuklasan, ngunit maaaring tumukoy ang mga ito kapag naisip ng Bing chatbot na ang isang chat o gawain ay nakumpleto habang ito ay bukas pa.

Si Mikhail Parakhin ay tumutukoy din sa Bing Image Creator, na nagpapahintulot sa mga user upang lumikha ng likhang sining gamit ang AI. Bilang tugon sa isang user na tumawag sa feature na”napakahigpit.”Sinabi ni Parakhin na ang feature ay”mabilis na bumubuti,”at ito ay mas mahusay na ngayon kaysa sa mga unang araw nito. Naging kontrobersyal ang AI image creator para sa mga paglabag sa copyright at pagkopya sa gawa ng ibang artist.

Dagdag pa rito, tinugunan ng pinuno ng Advertising at Web Services ng Microsoft ang mga maling sagot na minsan ay ginagawa ng Bing Chat Creative Mode, na nagsasabing, “Sinusubukan namin para magkaroon ng mas mabilis na mga tugon: magkaroon ng dalawang pathway sa modelo, patakbuhin ang mabilis, tingnan kung maganda ang sagot, kung hindi – patakbuhin ang mas mabagal na pathway. Sa kasong ito, napagpasyahan nang hindi tama na ang karagdagang paghihintay ay hindi nararapat.”Nangako rin siya na malapit na ang pag-aayos.