Facebook prend plusieurs mesures, y compris la réduction de la distribution de contenu considéré comme un discours de haine, dans le cadre de ses efforts pour freiner la propagation de la désinformation lors des élections dans quatre États indiens. Facebook réduira également temporairement la distribution du contenu des comptes qui ont récemment violé à plusieurs reprises les politiques de l’entreprise, a déclaré mardi le géant des médias sociaux dans un article de blog.

“Nous reconnaissons qu’il existe certains types de contenu, tels que les discours de haine, qui pourraient entraîner des dommages imminents hors ligne… Pour réduire le risque que le contenu problématique devienne viral dans ces États et incite potentiellement à la violence avant ou pendant les élections, nous allons considérablement réduire la distribution du contenu que notre technologie de détection proactive identifie comme un discours de haine ou de violence et d’incitation à la haine », a-t-il ajouté. Ce contenu sera supprimé s’il est déterminé qu’il enfreint les politiques de Facebook , mais sa distribution restera réduite jusqu’à ce que cette décision soit prise , a noté le blog.

Facebook a été critiqué par le passé pour sa gestion de discours de haine sur la plate-forme dans le pays. L’Inde fait partie des plus grands marchés pour Facebook et ses sociétés du groupe, WhatsApp et Instagram. Selon les données du gouvernement, l’Inde compte 53 crores d’utilisateurs de WhatsApp, 41 crores de Facebook et 21 crores d’Instagram. La société basée aux États-Unis a déclaré avoir investi de manière significative dans une technologie de détection proactive pour aider à identifier plus rapidement le contenu non conforme.

Dans son blog , Facebook a déclaré sur la base des leçons tirées des élections passées en Inde et dans le monde , il prend des mesures pour renforcer l’engagement civique, lutter contre les discours de haine, limiter la désinformation et supprimer la suppression des électeurs pendant les élections au Tamil Nadu, au Bengale occidental, en Assam, au Kerala et à Pondichéry. «Nous continuons également de collaborer étroitement avec les autorités électorales, notamment pour mettre en place un canal hautement prioritaire pour supprimer le contenu qui enfreint nos règles ou est contraire à la loi locale après avoir reçu des ordres juridiques valides», a-t-il déclaré. Facebook a souligné qu’en vertu de ses standards communautaires existants, il supprime certains insultes qu’il considère comme des discours de haine.

“Pour compléter cet effort, nous pouvons déployer une technologie pour identifier de nouveaux mots et expressions associés au discours de haine, et soit supprimer les messages dans cette langue, soit réduire leur diffusion”, a-t-il ajouté. Décrivant les étapes, Facebook a déclaré que ses politiques interdisaient l’ingérence des électeurs, définie comme des déclarations objectivement vérifiables telles que la fausse déclaration des dates et des méthodes de vote (par exemple, le texte pour voter). «Nous supprimons également les offres d’achat ou de vente de votes avec de l’argent ou des cadeaux. De plus, nous supprimons également les allégations explicites selon lesquelles vous contracteriez le COVID-19 si vous votez », a-t-il expliqué.

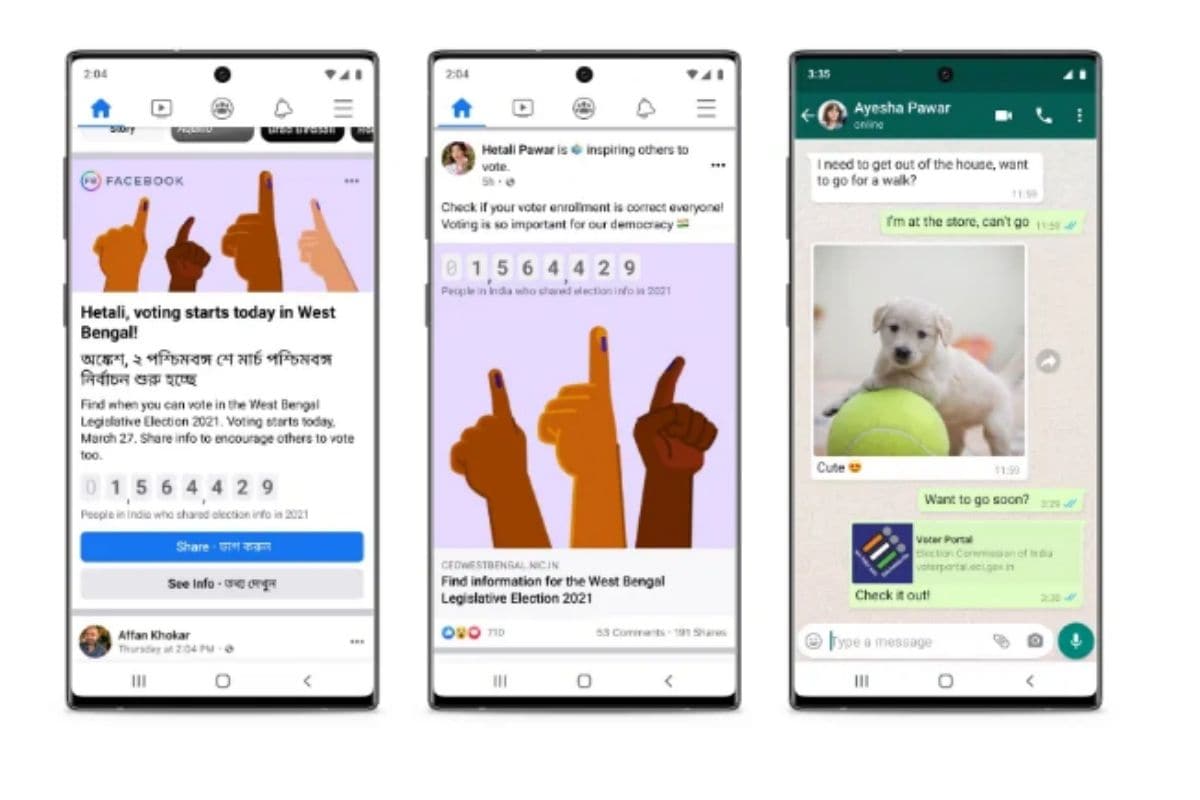

En 2019, dirigé par l’organisme industriel IAMAI, Facebook avait mis en place un canal hautement prioritaire avec la Commission électorale indienne (ECI) pour Facebook, Instagram et WhatsApp, afin de recevoir les escalades liées au contenu. Le code volontaire est également applicable pour cette élection, a déclaré le blog. «Nous pensons que Facebook a un rôle important à jouer dans la création d’une communauté informée et en aidant les gens à accéder à toutes les informations dont ils ont besoin pour participer au processus démocratique. Nous rappelons également aux gens d’exercer leur droit de vote démocratique », dit-il.

La société proposera des rappels le jour du scrutin pour donner aux électeurs des informations précises et les encourager à partager ces informations avec leurs amis sur Facebook et WhatsApp. «… WhatsApp déploie spécifiquement des campagnes d’éducation du public et des formations sur la littératie numérique pour sensibiliser le public au fait de ne pas transmettre de messages fréquemment transférés, activer les autorisations de groupe pour aider à décider des groupes à rejoindre, signaler ou bloquer un contact ou un numéro suspect, et interdire en masse ou automatisé messages », a déclaré le blog. La société travaille également avec des vérificateurs de faits tiers dans le monde entier, y compris huit partenaires en Inde, pour fournir aux gens un contexte supplémentaire sur le contenu qu’ils voient sur Facebook.

En plus de l’anglais, ces huit partenaires vérifient les faits dans 11 langues indiennes dont le bengali, le tamoul, le malayalam et l’assamais. Lorsqu’un vérificateur de faits évalue une histoire comme fausse, ce contenu est étiqueté et affiché plus bas dans le fil d’actualité, ce qui réduit considérablement sa distribution. Cela arrête sa propagation et réduit le nombre de personnes qui le voient, a déclaré Facebook.