Elérkezett a mesterséges intelligencia kora, és a Generatív AI kulcsszerepet játszik a mindennapi technológia példátlan fejlesztésében. Már számos ingyenes AI-eszköz létezik, amelyek segítségével néhány másodpercen belül hihetetlen képeket, szövegeket, zenét, videókat és még sok mást hozhat létre. Az Adobe mesterséges intelligencia generatív kitöltése a Photoshopban és a Midjourney csodálatos képességei valóban megdöbbentettek bennünket. De mi is pontosan a Generatív AI, és hogyan segíti elő az ilyen gyors innovációt? Ha többet szeretne megtudni, kövesse a Generatív AI részletes magyarázóját.

Tartalomjegyzék

Definíció: Mi az a Generatív AI?

Ahogy a neve is sugallja, a generatív AI olyan AI-technológiát jelent, amely képes új tartalmat generálni azokon az adatokon, amelyekre betanították. Szövegeket, képeket, hangot, videókat és szintetikus adatokat generálhat. A generatív mesterséges intelligencia a kimenetek széles skáláját képes előállítani a felhasználói bemenet vagy az általunk „kérések” alapján. A generatív AI alapvetően a gépi tanulás egy részterülete, amely új adatokat tud létrehozni egy adott adatkészletből.

Ha a modellt nagy mennyiségű szövegre oktatták, akkor a természetes hangzású szövegek új kombinációit hozhatja létre. Minél nagyobb az adat, annál jobb lesz a kimenet. Ha az adatkészletet a betanítás előtt megtisztították, akkor valószínűleg árnyalt választ fog kapni.

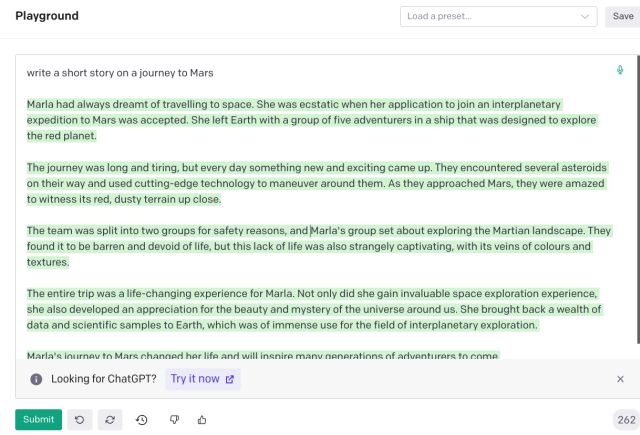

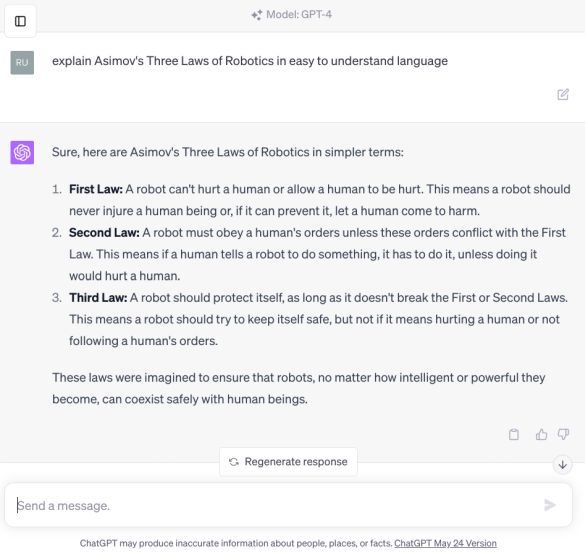

OpenAI Playground

OpenAI Playground

Ha egy modellt képcímkézéssel, feliratokkal és sok vizuális példával ellátott nagy képkorpusszal tanított be, az AI-modell tanulhat ezekből a példákból és végezze el a képosztályozást és-generálást. Ezt a kifinomult AI-rendszert, amely a példákból való tanulásra van programozva, neurális hálózatnak nevezik.

Egyébként különböző típusú generatív AI modellek léteznek. Ezek a Generative Adversarial Networks (GAN), a Variational Autoencoder (VAE), a Generative Pretraned Transformers (GPT), az Autoregresszív modellek és még sok más. Az alábbiakban röviden tárgyaljuk ezeket a generatív modelleket.

Jelenleg a GPT modellek a GPT-4/3.5 (ChatGPT), a PaLM 2 (Google) megjelenése után váltak népszerűvé. Bard), GPT-3 (DALL – E), LLaMA (Meta), Stable Diffusion és mások. Mindezek a felhasználóbarát AI interfészek a Transformer architektúrára épülnek. Tehát ebben a magyarázatban főként a Generatív AI-re és a GPT-re (Generative Pretraned Transformer) fogunk összpontosítani.

Melyek a generatív AI-modellek különböző típusai?

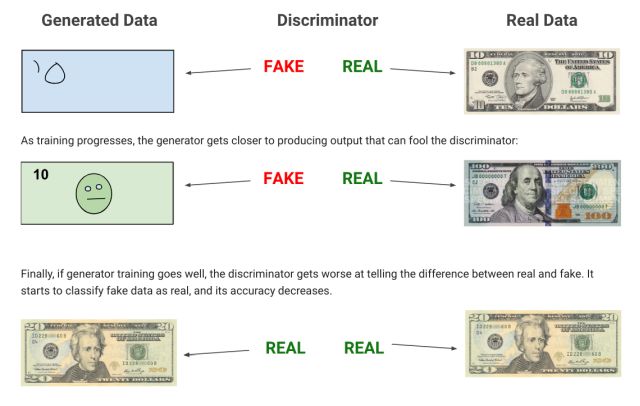

A generatív mesterségesintelligencia-modellek közül sokan a GPT-t kedvelik, de kezdjük a GAN-nal (Generative Adversarial Network) . Ebben az architektúrában két párhuzamos hálózatot képeznek, amelyek közül az egyik a tartalom generálására szolgál (generátor), a másik pedig kiértékeli a generált tartalmat (úgynevezett diszkriminátor).

Alapvetően az a cél, hogy két neurális hálózatot szembeállítsanak egymással, hogy valós adatokat tükröző eredményeket hozzanak létre. A GAN-alapú modelleket leginkább képgenerálási feladatokra használták.

GAN (Generative Adversarial Network)/Forrás: Google

GAN (Generative Adversarial Network)/Forrás: Google

Ezután megvan a Variational Autoencoder (VAE), amely magában foglalja a kódolás, a tanulás és a dekódolás folyamatát és tartalmat generál. Például, ha van egy képe egy kutyáról, az leírja a jelenetet, például színt, méretet, füleket és egyebeket, majd megtanulja, milyen tulajdonságokkal rendelkezik a kutya. Ezt követően a kulcspontok használatával újra létrehoz egy durva képet, amely egyszerűsített képet ad. Végül több változatosságot és árnyalatokat ad hozzá a végső képhez.

Az Autoregresszív modellekre áttérve közel áll a Transformer modellhez, de hiányzik belőle az önfigyelem. Leginkább szövegek generálására használják úgy, hogy egy sorozatot állítanak elő, majd az eddig generált sorozatok alapján megjósolják a következő részt. Ezután vannak normalizáló áramlások és energia alapú modellek is. De végül az alábbiakban részletesen fogunk beszélni a népszerű Transformer-alapú modellekről.

Mi az a Generatív Előképzett Transzformátor (GPT) Modell

Mielőtt megérkezett a Transformer architektúra, Recurrent A neurális hálózatokat (RNN) és a konvolúciós neurális hálózatokat (CNN), például a GAN-okat és a VAE-ket széles körben használták a generatív AI-hoz. 2017-ben a Google kutatói kiadtak egy alapanyagot „A figyelem minden, amire szüksége van” (Vaswani, Uszkoreit et al., 2017), hogy előremozdítsák a generatív AI területét, és valami nagy nyelvi modellhez (LLM) hasonlót készítsenek.

A Google ezt követően 2018-ban kiadta a BERT-modellt (Bidirectional Encoder Representations from Transformers) a Transformer architektúrát megvalósítva. Ezzel egy időben az OpenAI kiadta első Transformer architektúrán alapuló GPT-1 modelljét.

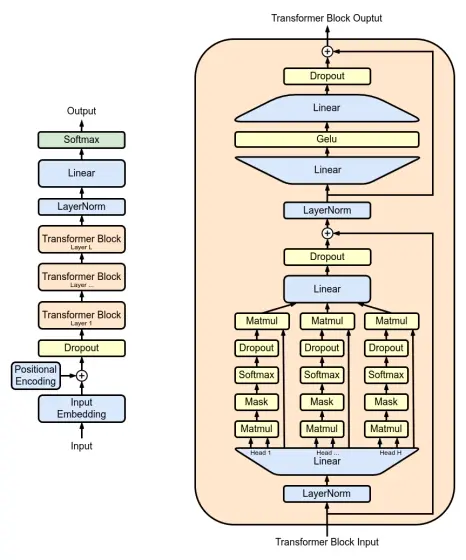

Forrás: Marxav/commons.wikimedia.org

Forrás: Marxav/commons.wikimedia.org

Szóval mi volt az a kulcsfontosságú összetevője a Transformer architektúrának, amely a Generative AI kedvencévé tette? Ahogy az írás jogosan el is nevezi,bevezette az önfigyelemt, ami hiányzott a korábbi neurális hálózati architektúrákból. Ez azt jelenti, hogy a Transformer nevű módszerrel alapvetően megjósolja a következő szót a mondatban. Nagy figyelmet fordít a szomszédos szavakra, hogy megértse a szövegkörnyezetet és kapcsolatot teremtsen a szavak között.

Ezen a folyamaton keresztül a Transformer ésszerű megértését fejleszti a nyelvről, és ezt a tudást felhasználja a következő szó megbízható előrejelzésére. Ezt az egész folyamatot figyelemmechanizmusnak nevezik. Ennek ellenére ne feledje, hogy az LLM-eket megvetően sztochasztikus papagájoknak nevezik. > (Bender, Gebru et al., 2021), mert a modell egyszerűen véletlenszerű szavakat utánoz a valószínűségi döntések és megtanult minták alapján. Nem logika alapján határozza meg a következő szót, és nem érti meg igazán a szöveget.

A GPT „előre betanított” kifejezéséhez érve ez azt jelenti, hogy a modellt már betanították hatalmas mennyiségű szöveges adatra, mielőtt még a figyelemmechanizmust alkalmazták volna. Az adatok előzetes betanításával megtanulja, mi a mondatszerkezet, minták, tények, kifejezések stb. Ez lehetővé teszi a modell számára, hogy jól megértse a nyelvi szintaxis működését.

Hogyan közelíti meg a Google és az OpenAI a generatív AI-t?

Mind a Google, mind az OpenAI Transformer-alapú modelleket használ a Google Bardban, illetve a ChatGPT-ben. Van azonbannéhány fontosságú különbség a megközelítésben. A Google legújabb PaLM 2 modellje kétirányú kódolót (önfigyelő mechanizmust és előrecsatolt neurális hálózatot) használ, ami azt jelenti, hogy minden környező szót figyelembe vesz. Lényegében megpróbálja megérteni a mondat kontextusát, majd egyszerre generálja az összes szót. A Google megközelítése lényegében megjósolja a hiányzó szavakat egy adott kontextusban.

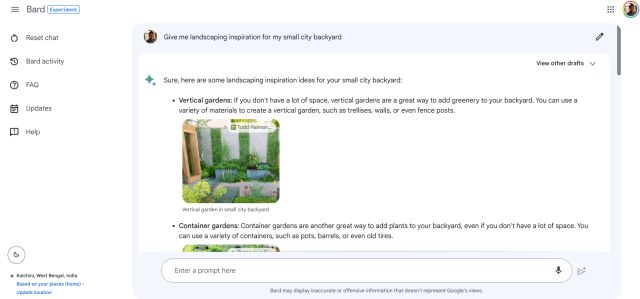

Google Bard

Google Bard

Ezzel szemben az OpenAI ChatGPT-je a Transformer architektúrát használja fel a sorozat következő szavának előrejelzésére – balról jobbra. Ez egy egyirányú modell, amelyet koherens mondatok generálására terveztek. Addig folytatja az előrejelzést, amíg egy teljes mondatot vagy bekezdést nem generál. Talán ez az oka annak, hogy a Google Bard sokkal gyorsabban képes szövegeket generálni, mint a ChatGPT. Mindazonáltal mindkét modell a Transformer architektúrára támaszkodik, hogy generatív mesterséges intelligencia felületeket kínáljon.

A generatív mesterséges intelligencia alkalmazásai

Mindannyian tudjuk, hogy a Generatív mesterséges intelligencia hatalmas alkalmazással rendelkezik nemcsak szövegek, hanem képek, videók, hanggenerálás és még sok más számára is. Az olyan AI chatbotok, mint a ChatGPT, a Google Bard, a Bing Chat stb., kihasználják a Generative AI-t. Használható még automatikus kiegészítésre, szövegösszegzésre, virtuális asszisztensre, fordításra stb. Zene generálására olyan példákat láttunk, mint a Google MusicLM és a közelmúltban kiadott MusicGen zenegeneráláshoz.

ChatGPT

ChatGPT

Ezen kívül a DALL-E 2-től a Stable Diffusion-ig mindegyik a Generatív mesterséges intelligencia használatával hoz létre valósághű képeket szöveges leírásokból. A videógenerálásban is a Runway Gen-1, StyleGAN 2 és BigGAN modelljei a Generative Adversarial Networks szolgáltatásra támaszkodnak élethű videók létrehozásához. Ezenkívül a Generative AI-nak vannak alkalmazásai a 3D modellgenerációkban, és néhány népszerű modell a DeepFashion és a ShapeNet.

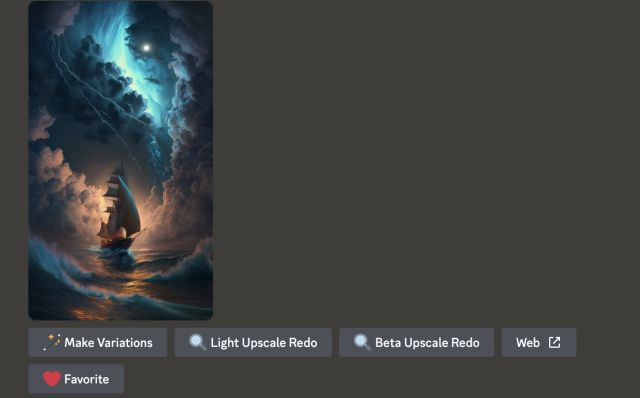

Kép létrehozva Írta: Midjourney

Kép létrehozva Írta: Midjourney

Nemcsak ez, a Generatív AI a kábítószer-felfedezésben is hatalmas segítséget jelenthet. Egy adott betegségre új gyógyszereket tud tervezni. Láttunk már olyan gyógyszerkutatási modelleket, mint az AlphaFold, amelyet a Google DeepMind fejlesztett ki. Végül a Generatív AI felhasználható prediktív modellezésre a jövőbeli pénzügyi és időjárási események előrejelzésére.

A generatív mesterségesintelligencia korlátai

Bár a generatív mesterségesintelligencia hatalmas képességekkel rendelkezik, nem mentes minden hibától. Először is nagy adathalmazra van szükséga modell betanításához. Előfordulhat, hogy sok kis induló vállalkozás esetében nem állnak rendelkezésre jó minőségű adatok. Láttunk már olyan cégeket, mint a Reddit, a Stack Overflow és a Twitter, akik lezárták az adataikhoz való hozzáférést, vagy magas díjat számítanak fel a hozzáférésért. A közelmúltban a The Internet Archive jelentették, hogy weboldala egy órára elérhetetlenné vált, mert néhány mesterséges intelligencia startup elkezdte kalapálni a webhelyét a képzési adatokért.

Ezen kívül a Generatív AI modelleket erősen kritizálták az ellenőrzés hiánya és az elfogultság miatt is. Az internetről származó ferde adatokra kiképzett AI-modellek felülreprezentálhatják a közösség egy részét. Láttuk, hogy az AI fotógenerátorok többnyire világosabb bőrtónusú képeket jelenítenek meg. Aztán van egy nagy probléma a mélyhamisított videók és a képalkotás generatív AI modelljei használatával. Amint azt korábban említettük, a generatív AI-modellek nem értik szavaik jelentését vagy hatását, és általában a betanított adatok alapján utánozzák a kimenetet.

Nagyon valószínű, hogy minden erőfeszítés és összehangolás, félretájékoztatás, mélyhamisítás, jailbreak és kifinomult adathalász kísérletek ellenére a meggyőző természetes nyelvi képességét használva a vállalatok nehezen fogják megszelídíteni a Generative-t. Az AI korlátai.

Hagyjon megjegyzést

Végre megérkezett az RTX 4060 Ti, amely az alap RTX 4060-zal érkezik, elég vonzó áron ahhoz, hogy a játékosok fontolóra vegyék a grafikus kártya frissítését. De kellene? Mélyre fogunk, és összehasonlítjuk az RTX 4060-at […]

Sok vita folyik az interneten az AR-ről (kiterjesztett valóság) és a VR-ről (virtuális valóság), ezért nem adok hozzá többet a tűz, de az egyik dolog, amit észrevettünk az Nreal Air használata során, hogy a VR […]

Van néhány megkérdőjelezhető tervezési választás a Redfallban, ami a félig sült híres Arkane formula összemosása. Imádom az Arkane Studios által készített játékokat, a Dishonored pedig olyan cím lett, amelyet időnként újra felkeresek az egyedi, feltörekvő játékmenet miatt. És […]