Ricordi quando Prisma era l’ultima app di editing di immagini”AI”in circolazione? Sì, abbiamo sicuramente fatto molta strada da allora. Con l’ascesa di generatori di immagini AI basati su prompt come DALL-E e Midjourney, la creazione di opere d’arte e deepfake è praticamente disponibile per tutti là fuori.

Ma ci sono dei limiti, vero? Dopo la novità iniziale di chiedere a Midjourney di immaginare vari suggerimenti e vedere cosa butta fuori, tutto diventa piuttosto noioso. O almeno lo ha fatto per me.

Energia narcisistica?

Guarda, sono un introverso, il che significa che non mi piace molto uscire. Ma sai cosa mi piace? Avere foto di me stesso in posti in cui probabilmente non andrei mai; diamine, anche posti in cui non posso andare.

Naturalmente, volevo chiedere agli strumenti di intelligenza artificiale di creare immagini di me in diverse situazioni e luoghi. Tuttavia, non volevo nemmeno caricare immagini di me stesso su siti Web casuali nella speranza che i risultati potessero essere buoni; ed è allora che ho letto di Dreambooth.

Che i giochi abbiano inizio…

Si scopre che persone davvero intelligenti hanno portato alle masse cose come Stable Diffusion. Inoltre, altri hanno collaborato con loro e hanno reso possibile letteralmente a chiunque abbia un po’di pazienza di creare i propri modelli Stable Diffusion e di eseguirli, completamente online.

Quindi, anche se ho un MacBook Air M1 che da nessun mezzo è destinato a essere utilizzato come macchina di addestramento per un modello di generazione di immagini di deep learning, posso eseguire un taccuino Google Colab e fare tutto questo sui server di Google, gratuitamente!

Tutto ciò di cui avevo davvero bisogno, quindi, erano un paio di mie foto, e basta.

Addestrare il mio generatore di immagini AI

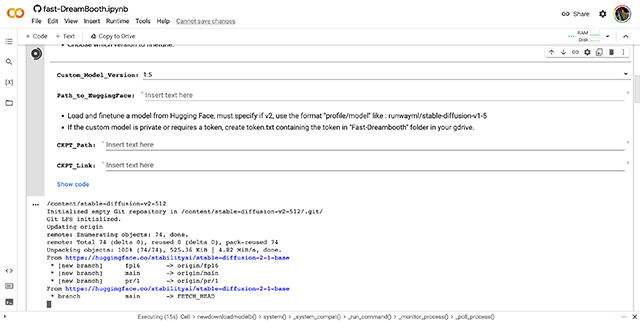

Addestrare il proprio generatore di immagini non è affatto difficile. Ci sono un certo numero di guide disponibili online se hai bisogno di aiuto, ed è praticamente tutto molto semplice. Devi solo aprire il taccuino Colab, caricare le tue foto e iniziare ad addestrare il modello. Tutto ciò accade abbastanza rapidamente.

Okay, siamo onesti, l’addestramento del codificatore di testo avviene abbastanza rapidamente, entro 5 minuti. Tuttavia, l’addestramento di UNet con i parametri impostati sui valori predefiniti richiede un tempo piuttosto lungo, circa 15-20 minuti. Tuttavia, considerando il fatto che stiamo effettivamente addestrando un modello di intelligenza artificiale a riconoscere ed essere in grado di disegnare la mia faccia, 20 minuti non sembrano troppi.

Durante l’addestramento, ci sono un sacco di modi in cui puoi personalizzare quanto vuoi addestrare il tuo modello, e quello che ho capito leggendo le esperienze di molte persone online, è che c’è nessuna vera strategia”taglia unica”qui. Tuttavia, per i casi d’uso di base, i valori predefiniti sembravano funzionare bene per la maggior parte delle persone e sono rimasto fedele anche a quelli. In parte perché non riuscivo davvero a capire cosa significasse la maggior parte delle cose, e in parte perché non potevo essere preso la briga di provare ad addestrare più modelli con diversi parametri di addestramento per vedere cosa produceva i risultati migliori.

Dopotutto, stavo semplicemente cercando un divertente generatore di immagini AI che potesse creare immagini di me decenti.

Supera le aspettative

Non sono un esperto di intelligenza artificiale con uno sforzo di immaginazione. Tuttavia, capisco che l’addestramento di un modello di diffusione stabile su un notebook Google Colab con 8 jpeg di me stesso ritagliati a 512 × 512 pixel non si tradurrà in qualcosa di straordinario.

Quanto mi sbagliavo.

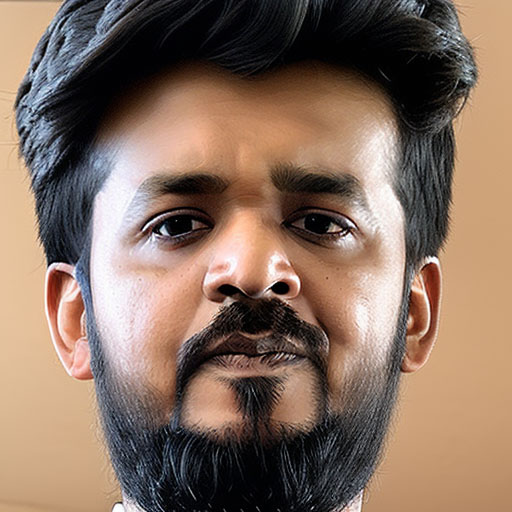

Nel mio primo tentativo di utilizzare il modello che ho addestrato, ho iniziato con un semplice prompt che diceva”akshay”. Quella che segue è l’immagine che è stata generata.

Non eccezionale, vero? Ma non è poi così male, vero?

Ma poi ho iniziato a giocare con alcuni dei parametri disponibili nell’interfaccia utente. Esistono diversi metodi di campionamento, fasi di campionamento, scala CFG, script e molto altro. È ora di impazzire sperimentando diversi suggerimenti e impostazioni per il modello.

Chiaramente, i risultati di queste immagini non sono perfetti, e chiunque mi abbia visto può probabilmente dire che queste non sono le”mie”immagini. Tuttavia, sono abbastanza vicini; e non ho nemmeno addestrato il modello con particolare cura.

Se dovessi seguire le innumerevoli guide su Reddit e altrove su Internet che parlano dei modi in cui puoi migliorare l’allenamento e ottenere risultati migliori da Dreambooth e Stable Diffusion, queste immagini potrebbero risultare ancora più realistiche (e probabilmente, più spaventoso).

Questo generatore di immagini AI è spaventosamente buono

Vedi, sono tutto per i miglioramenti nella tecnologia AI. In qualità di giornalista tecnologico, negli ultimi due anni ho seguito il campo in continua evoluzione e in miglioramento dell’IA rivolta al consumatore e, per la maggior parte, sono profondamente impressionato e ottimista.

Tuttavia, vedere qualcosa come Dreambooth in azione mi fa riflettere sui modi non etici in cui gli strumenti basati su intelligenza artificiale e ML sono prontamente disponibili praticamente a chiunque abbia accesso a un computer e a Internet.

Non c’è dubbio che ci siano molti cattivi attori nel mondo. Sebbene esistano sicuramente casi d’uso innocenti di tale tecnologia facilmente accessibile, se c’è una cosa che ho imparato nei miei anni di reportage sulla tecnologia, è che mettere un prodotto nelle mani di milioni di persone si tradurrà senza dubbio in molti risultati indesiderati. Nella migliore delle ipotesi, qualcosa di inaspettato e, nel peggiore, qualcosa di decisamente disgustoso.

Avere la possibilità di creare immagini deepfake praticamente di chiunque fintanto che puoi procurarti da 5 a 10 immagini del loro viso, è incredibilmente pericoloso se usato in modo errato. Pensa alla disinformazione, alla falsa rappresentazione e persino al revenge porn: i deepfake possono essere utilizzati in tutti questi modi problematici.

Protezioni? Quali salvaguardie?

Non è nemmeno solo Dreambooth. Di per sé, e usati bene, Dreambooth e Stable Diffusion sono strumenti incredibili che ci permettono di sperimentare ciò che l’IA può fare. Ma non ci sono vere salvaguardie per questa tecnologia da quello che ho sperimentato finora. Certo, non ti permetterà di generare nudità totale nelle immagini; almeno di default. Tuttavia, ci sono molte estensioni che ti permetteranno di aggirare anche quel filtro e creare praticamente qualsiasi cosa tu possa immaginare, in base all’identità di chiunque.

Anche senza tali estensioni, puoi facilmente ottenere strumenti come questo per creare un’ampia gamma di immagini di persone potenzialmente inquietanti e poco raccomandabili.

Inoltre, con un PC decentemente potente, è possibile addestrare i propri modelli di intelligenza artificiale senza alcuna protezione e in base ai dati di addestramento che si desidera utilizzare, il che significa che il modello addestrato creerà immagini che possono essere dannose e dannoso oltre ogni immaginazione.

I deepfake non sono una novità. In effetti, c’è un vasto tesoro di video e media deepfake online. Tuttavia, fino al recente passato, la creazione di deepfake era limitata a un numero relativamente piccolo (sebbene ancora elevato) di persone che esistevano nell’intersezione tra”persone con hardware capace”e”know-how tecnico”.

Ora, con l’accesso a unità di calcolo GPU gratuite (a uso limitato) su Google Colab e la disponibilità di strumenti come fast-dreambooth che ti consentono di addestrare e utilizzare modelli di intelligenza artificiale sui server di Google, quel numero di persone salire esponenzialmente. Probabilmente lo ha già fatto-questo è spaventoso per me, e dovrebbe esserlo anche per te.

Cosa possiamo fare?

Questa è la domanda che dovremmo porci a questo punto. Strumenti come DALL-E, Midjourney e, sì, Dreambooth e Stable Diffusion, sono certamente impressionanti se usati con la comune decenza umana. L’intelligenza artificiale sta migliorando a passi da gigante: probabilmente puoi dirlo osservando l’esplosione di notizie relative all’IA negli ultimi due mesi.

Questo è, quindi, un punto cruciale in cui dobbiamo capire come garantire che l’IA sia utilizzata in modo etico. Come possiamo farlo è una domanda a cui non sono sicuro di avere la risposta, ma so che avendo utilizzato il generatore di immagini AI fast-dreambooth e dopo aver visto le sue capacità, ho paura di quanto sia buono , senza nemmeno sforzarsi troppo.

3 commenti

L’anno scorso, MSI ha lanciato il Titan GT77 con l’Intel Core i9-12900HX e la GPU per laptop RTX 3080 Ti, ed è stato il laptop da gioco più potente sulla faccia del pianeta. È stato il più pesante dei battitori pesanti […]

Sono passati alcuni mesi dal lancio della serie iPhone 14 ed è stato ben stabilito che è l’anno dei modelli Pro. Ma se hai intenzione di puntare sui pro frivoli, l’importo da sborsare […]

Wondershare ha sviluppato alcuni dei migliori software e strumenti per semplificare la nostra vita e i nostri sforzi creativi negli ultimi anni. In particolare, Wondershare Filmora ha ricevuto numerosi riconoscimenti. Ha ricevuto il premio Video Editing Leader […]