Elon Musk s’est associé à une légion de visionnaires de l’intelligence artificielle (IA) de premier ordre pour envoyer un avertissement effrayant au monde. Ils tirent la sonnette d’alarme et exigent un arrêt immédiat du rythme effréné du développement de l’IA.

La raison de leur appel à l’action ? Les risques inquiétants et déchirants que l’IA pose à la société et à l’humanité sont trop graves pour être ignorés.

Mais sont-ilspréoccupations justifiées, ou s’agit-il simplement d’un autre cas d’alarmisme ? Est-il possible de trouver un équilibre entre innovation et sécurité, ou jouons-nous avec le feu en libérant l’IA sans réglementation et surveillance appropriées ?

Avoir un peu de l’angoisse existentielle de l’IA aujourd’hui

— Elon Musk (@elonmusk) 26 février 2023

Elon Musk et des experts techniques écrivent une lettre ouverte pour faire face à la menace de l’IA

Un groupe de personnalités éminentes dans l’industrie de la technologie, comme Elon Musk et Steve Wozniak, ont collaboré avec une coalition de cadres et de chercheurs en IA pour soulever des inquiétudes quant aux progrès rapides de la technologie de l’IA qui pourraient dépasser la compréhension et la gérabilité humaines.

L’avenir of Life Institute (FOLI), un éminent groupe de réflexion américain, a déclenché une bombe avec sa dernière missive: une lettre ouverte exigeant une suspension immédiate du développement de systèmes d’IA plus avancés que GPT-4, au moins pendant six mois.

📢 Nous faisons appel aux laboratoires d’IA pour suspendre temporairement la formation de modèles puissants !

Rejoignez l’appel de FLI aux côtés de Yoshua Bengio, @stevewoz, @ harari_yuval, @elonmusk, @GaryMarcus et plus de 1 000 autres qui ont signé : https://t.co/3rJBjDXapc

Un bref 🧵sur pourquoi nous réclamons cela-(1/8)

— Futur of Life Institute (@FLIxrisk) 29 mars 2023

Dans ce document, FOLI a mis en garde contre une”course incontrôlable”parmi les entreprises d’IA pour créer des systèmes toujours plus puissants qui présentent des risques profonds pour la société et l’humanité, et à moins que nous n’agissions rapidement pour freiner la croissance fulgurante de l’IA, nous nous dirigeons vers un avenir aussi imprévisible qu’incontrôlable.

Doom technologique en perspective ?

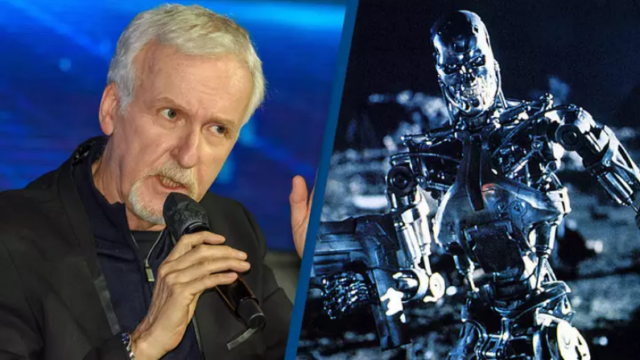

Même le cerveau derrière le”Terminator”, le film séminal de 1984 qui dépeint la montée terrifiante de l’IA et sa quête pour anéantir l’humanité, avertit maintenant que nous sommes plus proches du bord de la catastrophe technologique que nous ne le pensons.

Lors d’une récente apparition sur le podcast SmartLess, le réalisateur primé James Cameron a admis qu’il est”assez préoccupé par le potentiel d’utilisation abusive de l’IA”, reconnaissant la menace imminente de machines qui pourraient se retourner contre nous.

Le réalisateur primé James Cameron. Crédit d’image : SOPA Images Limited/Atlaspix/Alay Stock Photo

Bien qu’il n’ait pas peur, Cameron admet qu’aucune technologie n’est jamais restée inutilisée comme arme, et il en va de même pour l’IA.

La résistance

Alors que l’appel à freiner le développement de l’IA a gagné du terrain parmi les experts en technologie, tout le monde n’est pas convaincu que nous vacillons au bord d’une apocalypse de l’IA.

Je respecte les inquiétudes mais je ne signerai pas ça. Les LLM ne deviendront pas des AGI. Ils posent des risques sociétaux, comme beaucoup de choses. Ils ont aussi un grand potentiel pour le bien. La pression sociale pour ralentir la R&D devrait être réservée aux armes biologiques et aux armes nucléaires, etc. et non à des cas complexes comme celui-ci.

— Ben Goertzel (@bengoertzel) 29 mars 2023

Le PDG de SingularityNET, Ben Goertzel, a repoussé contre l’idée que nous sommes sur le point de créer des robots d’intelligence générale artificielle (AGI), soulignant dans un Twitter enflammé échangez avec le chercheur en intelligence artificielle Gary Marcus que les LLM (Large Language Models) ne se transformeront pas soudainement en machines super intelligentes qui menacent notre existence même.

La capitalisation boursière totale de la cryptographie maintient toujours son ancrage au niveau de 1,14 $. Graphique de TradingView.com

L’intelligence artificielle est-elle une menace pour la crypto ?

Pendant ce temps, l’IA n’est pas intrinsèquement une menace pour la crypto, mais elle peut être utilisée de manière positive et négative dans le contexte de la crypto-monnaie. D’une part, l’IA peut être utilisée pour améliorer la sécurité des transactions de crypto-monnaie en détectant et en prévenant les activités frauduleuses.

Il peut également être utilisé pour améliorer les stratégies de trading, prédire les tendances du marché et optimiser les décisions d’investissement. D’autre part, l’IA pourrait potentiellement être utilisée pour manipuler les marchés et exploiter les vulnérabilités de l’écosystème de la crypto-monnaie.

En outre, il existe un risque que les systèmes d’IA soient compromis ou piratés, entraînant des failles de sécurité et le vol de crypto-monnaies. Dans l’ensemble, bien que l’IA présente à la fois des opportunités et des risques pour l’industrie de la crypto-monnaie, il est important de s’assurer qu’elle est utilisée de manière éthique et responsable.

Image : Robotics & Automation News

Alors que l’IA continue de façonner notre monde, il est important rappeler que cette technologie est une épée à double tranchant. Bien que les risques soient sans aucun doute réels, les avantages de l’IA ne peuvent être négligés.

-Image de fond de Film Stories