Image : NVIDIA

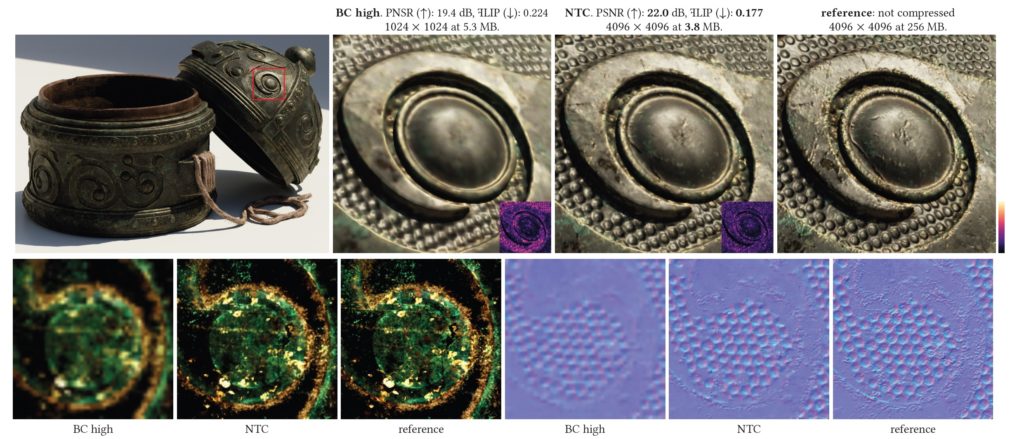

NVIDIA a développé une nouvelle technique de compression appelée”Neural Texture Compression”(NTC) qui offre un niveau de qualité qui se rapproche de ce que l’on voit dans les actifs de référence non compressés, selon une nouvelle fonctionnalité de NVIDIA Research intitulée”Random-Accéder à la compression neurale des textures matérielles. » Selon une image de comparaison partagée par les chercheurs de NVIDIA, NTC fournit une résolution 4 fois plus élevée par rapport à la méthode élevée BC (compression de blocs), ce qui est assez soigné en soi, mais ce qui est encore plus remarquable, c’est qu’il est capable d’accomplir cela tout en utilisant 30% moins de mémoire. D’autres comparaisons de la nouvelle méthode de compression, qui peuvent ou non être exclusives aux futurs GPU GeForce, sont disponibles ici.

Extrait d’un résumé de NVIDIA Research :

Les progrès continus du photoréalisme dans le rendu s’accompagnent d’une croissance des données de texture et, par conséquent, d’une augmentation des demandes de stockage et de mémoire. Pour résoudre ce problème, nous proposons une nouvelle technique de compression neuronale spécifiquement conçue pour les textures matérielles. Nous débloquons deux niveaux de détail supplémentaires, c’est-à-dire 16 fois plus de texels, en utilisant une compression à faible débit, avec une qualité d’image meilleure que les techniques de compression d’image avancées, telles que AVIF et JPEG XL. Dans le même temps, notre méthode permet une décompression en temps réel à la demande avec un accès aléatoire similaire à la compression de texture de bloc sur les GPU, permettant la compression sur le disque et la mémoire.

L’idée clé derrière notre approche est compresser plusieurs textures de matériaux et leurs chaînes mipmap ensemble, et utiliser un petit réseau de neurones, optimisé pour chaque matériau, pour les décompresser. Enfin, nous utilisons une implémentation de formation personnalisée pour atteindre des vitesses de compression pratiques, dont les performances dépassent celles des frameworks généraux, comme PyTorch, d’un ordre de grandeur.

Image : NVIDIA

Image : NVIDIA

Rejoignez la discussion pour ce post sur nos forums…