Juste après que Samsung a annoncé de nouvelles fonctionnalités d’accessibilité pour les Galaxy Buds 2 Pro, Apple a annoncé certaines fonctionnalités d’accessibilité pour les iPhones. Juste avant la Journée mondiale de sensibilisation à l’accessibilité (18 mai 2023), Apple a annoncé des fonctionnalités pour améliorer l’accessibilité sur les iPhones, et il semble que ces fonctionnalités aient été inspirées par les fonctionnalités de Samsung.

L’accès assisté d’Apple est similaire au mode facile de Samsung, tandis que Live Speech est similaire à l’appel texte Bixby

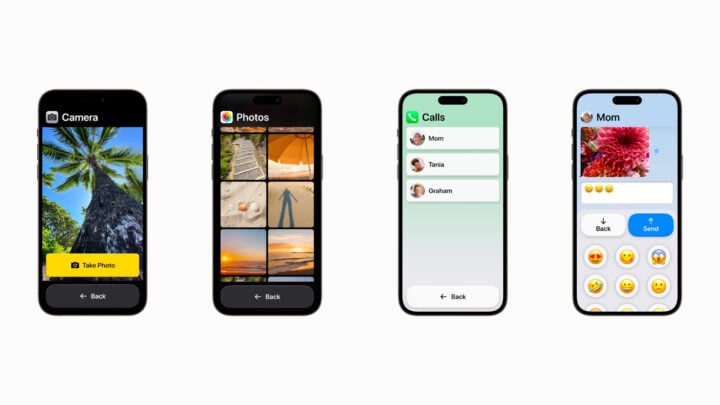

Apple révélé Assistive Access, Live Speech et Personal Voice. L’accès assisté est destiné aux personnes souffrant de troubles cognitifs et offre des éléments et des dispositions d’interface utilisateur plus grands afin que les utilisateurs puissent accéder facilement aux fonctionnalités essentielles. Cette fonctionnalité est similaire au mode facile de Samsung, qui rationalise l’interface utilisateur pour un accès plus facile qui aide les personnes âgées ou les personnes ayant des troubles cognitifs. La fonctionnalité d’Apple fonctionnera sur les iPhones et les iPads avec des applications essentielles telles que les appels, l’appareil photo, les messages, la musique et les photos, offrant des cibles tactiles et des éléments d’interface utilisateur plus importants. Cette fonctionnalité sera déployée plus tard cette année dans le cadre de la mise à jour iOS 17.

Avec Live Speech, les utilisateurs peuvent saisir ce qu’ils ont à dire pendant un appel vocal. Un iPhone, un iPad ou un Mac convertira ensuite ce texte en parole et le transmettra à l’autre côté de l’appel. Les utilisateurs peuvent également enregistrer des phrases rapides à utiliser pendant les appels. Cette fonctionnalité est similaire à la fonctionnalité Bixby Text Call de Samsung, qui transcrit les voix en texte et vice versa pendant les appels.

La fonctionnalité Personal Voice d’Apple est similaire à Bixby Custom Voice Creator de Samsung

La fonctionnalité d’accessibilité Personal Voice d’Apple est conçue pour les utilisateurs qui risquent de perdre la voix. Ils peuvent créer une voix qui leur ressemble en lisant un ensemble aléatoire d’invites de texte pour enregistrer 15 minutes d’audio sur un iPhone ou un iPad. Cette fonctionnalité semble inspirée par Bixby Custom Voice Creator, que Samsung a lancé plus tôt cette année.

En plus de toutes ces fonctionnalités, Apple a également annoncé le mode de détection dans la loupe que les utilisateurs d’iPhone malvoyants pourraient utiliser pour lire du texte à partir d’objets. Les utilisateurs peuvent simplement pointer l’appareil photo de l’iPhone vers un objet ou un texte qu’ils regardent, et le mode de détection lira ce texte et le dira à haute voix. Ceci est similaire à Détecteur de couleurs, identificateur d’objet, descripteur de scène et lecteur de texte de Bixby Vision de Samsung.

Les autres nouvelles fonctionnalités incluent la certification « Made for iPhone Hearing Devices » pour les aides auditives, des améliorations du contrôle vocal, davantage d’options de taille de texte dans les applications Mac essentielles, la mise en pause des images avec des éléments en mouvement (pour ceux qui sont sensibles aux animations rapides), et des voix plus naturelles pour Voice Over.