iPhoneのアクセシビリティページ(設定> アクセシビリティ)は障害を持つ人がデバイスを使用できるようにする機能とオプション。視力の弱い人は、iPhoneのテキストを大きくし、太字の印刷を使用してテキストをより適切に定義できます。難聴のユーザーは、このページにアクセスしてiPhone用の補聴器をペアリングするか、音声認識をオンにして、携帯電話で特定のノイズが聞こえたときに通知を受け取ることができます。

Appleはそれらを支援する新機能を追加します障害のある人

視力の弱い人は次のことができるようになります。領収書、チャート、グラフのデータを聞きながら、画像で見つけた人の説明を聞きます。領収書の写真は、テーブルヘッダーを含む行と列で読み取ることができます。この機能では、人の位置も説明します。画像内の他のオブジェクトと比較。

このアップデートでは、iPadOSでサードパーティの視力追跡デバイスのサポートも追加され、ユーザーは自分の目でiPadを制御できるようになります。人がiPad画面のどこを見ているかを追跡するiPhone(MFi)製品が利用可能になります。目の動きにより、ポインターがディスプレイをナビゲートできるようになり、長時間の目の接触によってタップなどのアクションが実行されます。

また、今年後半には、話すのが難しい人のためのアクセシビリティコントロールが登場します。スイッチコントロールのサウンドアクションでは、物理的なボタンとスイッチが、クリック音、ポップ音、「ee」音など、ユーザーの口から生成される音に置き換えられます。また、今年後半には、Appleは個々のアプリの表示とテキスト設定のカスタマイズをサポートし、酸素チューブ、人工内耳、ヘルメットを使用してMemojiを作成できるようにします。

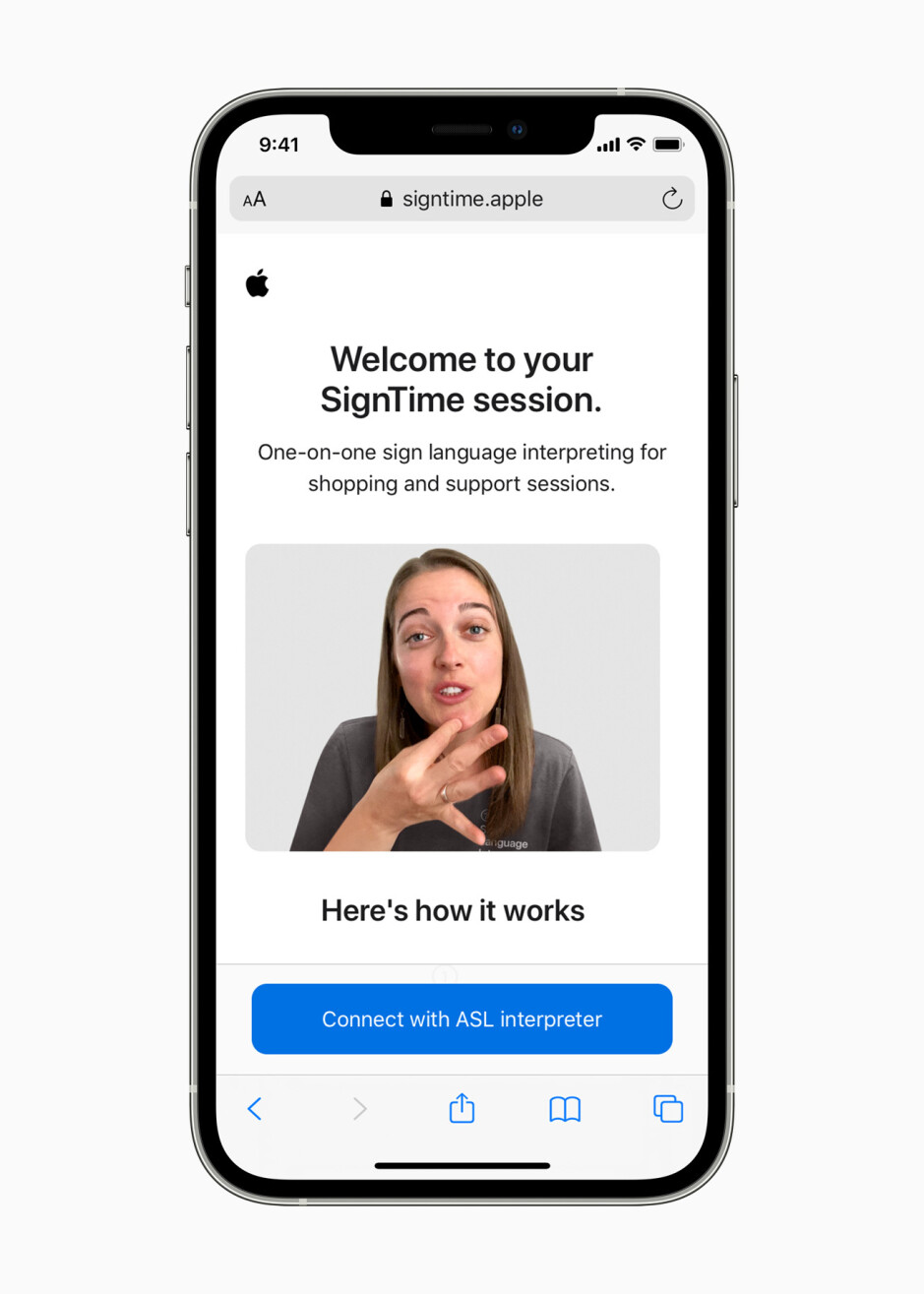

本日より、Appleは新しいSignTimeプログラムを開始します。これにより、顧客はさまざまなバージョンの手話を使用して、Webブラウザを介してAppleCareおよびRetail CustomerCareと通信できます。米国ではアメリカ手話(ASL)が使用され、英国では英国手話(BSL)で署名されます。フランスではフランス手話(LSF)が使用されます。 Appleは、将来、SignTimeを他の国に追加することを計画しています。