Samsung が Galaxy Buds 2 Pro の新しいアクセシビリティ機能を発表した直後、Apple は iPhone のいくつかのアクセシビリティ機能を発表しました。世界アクセシビリティ啓発デー (2023 年 5 月 18 日) の直前に、Apple は iPhone のアクセシビリティを向上させる機能を発表しましたが、それらの機能は Samsung の機能からインスピレーションを得たようです。

Apple の Assistive Access は Samsung の Easy Mode に似ており、Live Speech は Bixby Text Call に似ています

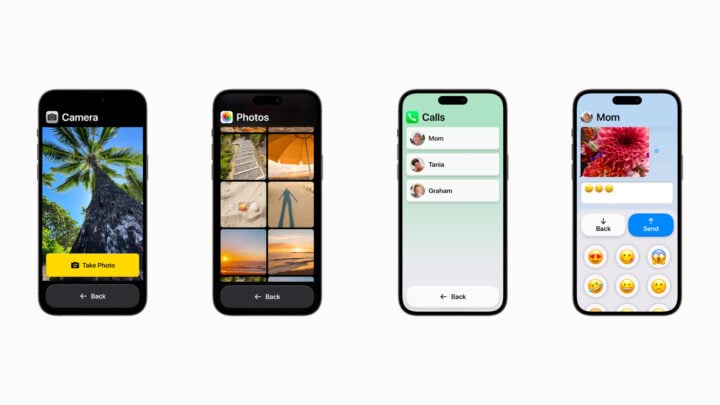

Apple 明らかに支援アクセス、ライブスピーチ、パーソナルボイス。 Assistive Access は、認知障害を持つユーザーを対象としており、重要な機能に簡単にアクセスできるように、より大きな UI 要素とレイアウトを提供します。この機能は Samsung のイージー モードに似ており、UI を合理化してアクセスしやすくし、高齢者や認知障害のある人を支援します。 Appleの機能は、通話、カメラ、メッセージ、音楽、写真などの重要なアプリを備えたiPhoneとiPadで動作し、より大きなタッチターゲットとUI要素を提供します。この機能は、iOS 17 アップデートの一部として今年後半に展開される予定です。

ライブスピーチを使用すると、ユーザーは音声通話中に言うべき内容を入力できます。 iPhone、iPad、または Mac はそのテキストを音声に変換し、通話の相手側に中継します。ユーザーは通話中に使用するクイックフレーズを保存することもできます。この機能は、通話中に音声をテキストに、またはその逆に文字に変換する、Samsung の Bixby Text Call 機能に似ています。

Apple の Personal Voice 機能は、Samsung の Bixby Custom Voice Creator に似ています

Apple の Personal Voice アクセシビリティ機能は、声を失う危険性があるユーザー向けに設計されています。ランダム化された一連のテキスト プロンプトを読み上げ、iPhone または iPad で 15 分間の音声を録音することで、自分に似た音声を作成できます。この機能は、サムスンが今年初めに発売した Bixby Custom Voice Creator からインスピレーションを得たものと思われます。

これらすべての機能とは別に、Apple は視力の弱い iPhone ユーザーが物体からテキストを読み取るために使用できる拡大鏡の検出モードも発表しました。ユーザーは、見ているオブジェクトまたはテキストに iPhone のカメラを向けるだけで、検出モードがそのテキストを読み上げて読み上げます。これは、Samsung の Bixby Vision のカラー検出器、オブジェクト識別子、シーン記述子、およびテキスト リーダー機能。

その他の新機能には、補聴器の「Made for iPhone Hearing Devices」認定、音声コントロールの改善、必須の Mac アプリでのテキスト サイズのオプションの増加、動きのある要素を含む画像の一時停止 (急速なアニメーションに敏感なユーザー向け)、ボイスオーバーではより自然な声を実現します。